IA na Política: Quando Vídeos Deepfake Desafiam a Verdade e a Democracia

A inteligência artificial (IA) tem revolucionado incontáveis setores, prometendo um futuro de inovações e eficiências sem precedentes. No entanto, como toda tecnologia poderosa, ela carrega consigo um lado sombrio, um potencial de abuso que pode minar os pilares da sociedade. Um dos exemplos mais perturbadores dessa dualidade é o surgimento e a proliferação dos chamados `vídeos deepfake`.

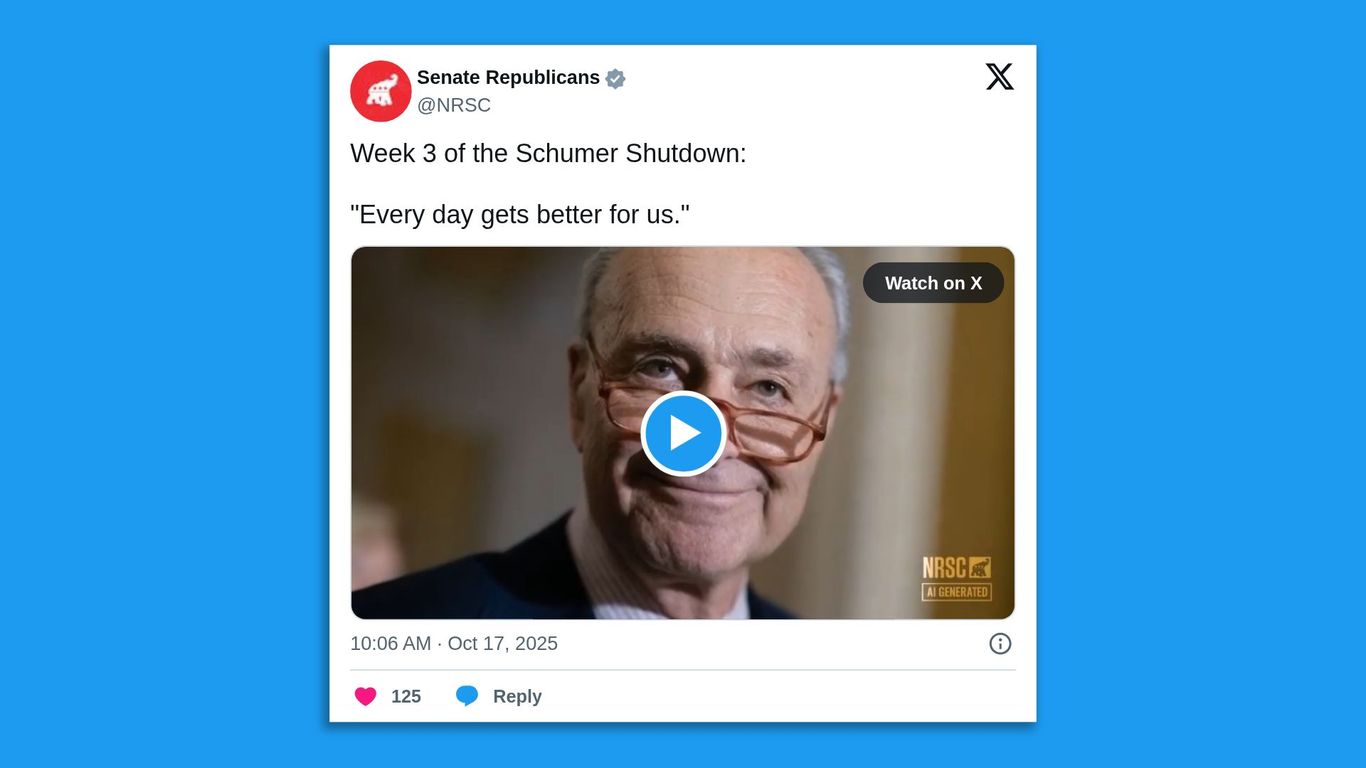

Imagine a cena: um vídeo de um político renomado, em um momento crucial, proferindo palavras que nunca foram ditas, ou agindo de formas que jamais aconteceram na realidade. As imagens são convincentes, a voz é idêntica, mas tudo não passa de uma elaborada falsificação criada por algoritmos. Essa não é uma visão distópica de um futuro distante; é uma realidade alarmante que já começa a moldar o cenário político global. O caso de um comitê republicano do Senado divulgando um vídeo, gerado por IA, do senador Chuck Schumer celebrando uma paralisação do governo, onde a citação era real, mas Schumer nunca a disse diante das câmeras, serve como um alerta claro. Ele ilustra o quão perto estamos de um ponto onde a distinção entre o real e o artificial se torna assustadoramente tênue, com implicações profundas para a verdade, a confiança e a própria democracia.

Neste artigo, vamos mergulhar no universo dos deepfakes, desvendando sua tecnologia, analisando seus impactos na política e na sociedade, e discutindo os desafios e as estratégias para combater essa nova fronteira da desinformação. Prepare-se para questionar o que você vê e ouve, pois a era da verdade flexível está apenas começando.

### Vídeos Deepfake: A Nova Fronteira da Desinformação Política

A ascensão da inteligência artificial generativa marcou uma virada de página na forma como interagimos com o conteúdo digital. Se antes a manipulação de imagens e áudios era um processo complexo, exigindo expertise e tempo considerável, hoje, com os avanços da IA, a criação de falsificações digitais hiper-realistas está mais acessível do que nunca. Os `vídeos deepfake` são o exemplo mais proeminente dessa capacidade. Eles combinam o poder da IA com a maleabilidade dos dados para produzir simulações de áudio e vídeo que são quase indistinguíveis do original. O resultado? Conteúdo fabricado que pode colocar palavras na boca de qualquer pessoa ou fazer com que pareçam realizar ações que nunca fizeram, com uma autenticidade assustadora.

O caso envolvendo o senador Schumer, mesmo que hipotético ou como um alerta para o futuro, é um exemplo perfeito da sutileza e do perigo dessa tecnologia. A citação atribuída a ele era real, ou seja, algo que ele poderia ter dito em outro contexto ou momento. No entanto, a IA foi usada para colocá-lo em uma situação específica – celebrando uma paralisação do governo – que talvez nunca tenha ocorrido da forma apresentada. Esse é o ponto crucial: não se trata de inventar algo do zero, mas de distorcer a realidade através da remontagem e do contexto manipulado. É a “meia-verdade” visual, que se espalha mais rápido e causa um impacto emocional muito maior do que um texto ou áudio isolado.

No cenário político, onde a percepção pública é moeda de troca e as eleições são decididas por margens estreitas, a capacidade de gerar `vídeos deepfake` representa uma arma formidável. Um vídeo falso de um candidato envolvido em um escândalo fictício, ou um rival proferindo declarações extremistas, pode virar o jogo em questão de horas. A velocidade de disseminação nas redes sociais, aliada à dificuldade de verificar a autenticidade em tempo real, cria um ambiente fértil para a desinformação. O impacto não se restringe apenas aos candidatos; a polarização social pode ser intensificada, minorias podem ser atacadas e a confiança nas instituições democráticas pode ser corroída de forma irreversível.

### A Tecnologia por Trás da Ilusão: Como os Deepfakes São Criados

Para entender o perigo dos `vídeos deepfake`, é essencial compreender como eles são construídos. No coração da maioria dessas criações estão as Redes Generativas Adversariais (GANs), embora modelos de difusão e outras arquiteturas de IA generativa também sejam cada vez mais utilizados. Simplificando, uma GAN opera com dois componentes principais que trabalham em um sistema de “gato e rato”: um gerador e um discriminador.

O **gerador** é treinado para criar novas imagens ou sequências de vídeo. Ele recebe um conjunto de dados (muitas fotos e vídeos de uma pessoa, por exemplo) e aprende a replicar suas características, expressões e padrões de fala. Ele tenta criar algo que pareça real.

O **discriminador**, por sua vez, atua como um crítico. Ele é treinado com imagens reais e imagens geradas pelo gerador. Sua tarefa é distinguir entre o que é real e o que é falso. À medida que o discriminador se torna melhor em identificar falsificações, o gerador é forçado a criar `vídeos deepfake` cada vez mais convincentes para enganar o discriminador. Esse ciclo iterativo de aprimoramento mútuo leva à criação de conteúdos sintéticos de uma qualidade espantosa.

Para criar um deepfake de alta qualidade, os algoritmos precisam de uma quantidade significativa de dados de treinamento do indivíduo que será falsificado. Isso inclui fotos em diferentes ângulos, expressões e iluminações, bem como amostras de áudio da voz. Com o vasto acúmulo de dados pessoais disponíveis online – desde fotos em redes sociais até aparições públicas em vídeos – o material para treinar esses modelos é abundante. Além disso, a democratização das ferramentas de IA tem tornado o processo mais acessível. Antigamente, apenas laboratórios de pesquisa ou estúdios com recursos avançados poderiam criar tais manipulações. Hoje, softwares e plataformas online simplificam o processo, permitindo que usuários com pouca ou nenhuma experiência em IA gerem seus próprios `vídeos deepfake` com relativa facilidade. Essa democratização é uma faca de dois gumes, pois, ao mesmo tempo que abre portas para a criatividade, também reduz a barreira para a manipulação e a desinformação em massa.

### As Consequências Democráticas: Quando a Realidade se Torna Flexível

O impacto dos `vídeos deepfake` na política e na democracia é multifacetado e profundamente preocupante. Em primeiro lugar, eles representam uma ameaça direta à integridade eleitoral. Em campanhas acirradas, um vídeo falso divulgado nos dias que antecedem a votação pode ser suficiente para mudar a opinião pública e influenciar o resultado, sem que haja tempo hábil para a desmentida e a comprovação da fraude. As consequências são a anulação do voto consciente e a eleição de figuras baseadas em narrativas falsas.

Em segundo lugar, a proliferação de `vídeos deepfake` pode levar a uma erosão generalizada da confiança. Se as pessoas não conseguem mais distinguir o que é real do que é fabricado, a confiança nos meios de comunicação, nos políticos e até mesmo em suas próprias percepções visuais e auditivas se desintegra. Isso gera um ambiente de cinismo e desengajamento, onde qualquer evidência, por mais legítima que seja, pode ser sumariamente descartada como “fake” ou um deepfake. Esse fenômeno é conhecido como o “dividendo do mentiroso”, onde os verdadeiros culpados podem usar a existência de deepfakes como uma desculpa para negar a autenticidade de vídeos e áudios genuínos que os incriminam.

Além disso, os `vídeos deepfake` têm o potencial de intensificar a polarização social e política. Ao criar narrativas falsas que reforçam preconceitos existentes ou ao demonizar grupos específicos, eles podem inflamar tensões, incitar a violência e minar o tecido social. Em um mundo já fragmentado por bolhas de informação e algoritmos de recomendação que reforçam vieses, a IA adiciona uma camada de complexidade e perigo a essa dinâmica. A capacidade de criar incidentes diplomáticos falsos ou propagar desinformação estratégica também tem sérias implicações para a segurança nacional e as relações internacionais, podendo escalar tensões entre países ou justificar ações militares com base em falsidades.

### Detectando o Engano: O Desafio e as Soluções em Desenvolvimento

Diante da crescente sofisticação dos `vídeos deepfake`, a detecção se tornou um campo de batalha constante, uma corrida armamentista entre criadores e detectores. Pesquisadores e empresas de tecnologia estão desenvolvendo ferramentas e algoritmos avançados para identificar sinais de manipulação, mas a tarefa é hercúlea, pois os métodos de criação estão sempre evoluindo.

Os métodos de detecção técnica geralmente se concentram em identificar artefatos digitais, inconsistências e padrões sutis que são difíceis para as IAs generativas replicarem perfeitamente. Isso pode incluir:

* **Análise de Fluxo Sanguíneo (Pletismografia Remota):** O sangue que flui sob a pele causa pequenas mudanças na cor do rosto. Deepfakes muitas vezes falham em replicar esses padrões de micro-pulsação, tornando a pele artificialmente estática.

* **Frequência de Piscadelas:** Pessoas piscam a uma taxa regular. Muitos `vídeos deepfake` iniciais mostravam indivíduos piscando com pouca frequência ou de forma não natural, embora os modelos mais recentes estejam superando essa limitação.

* **Anomalias no Olhar e na Direção do Rosto:** Pequenas inconsistências na forma como os olhos se movem ou a direção para a qual o rosto está voltado podem ser indicadores.

* **Voz e Sincronização Labial:** Descompassos entre o áudio e os movimentos labiais, ou a presença de sons artificiais ou inconsistências tonais na voz, podem ser detectados.

* **Análise de Metadados e Erros de Compressão:** A ausência de metadados de câmera ou padrões de compressão incomuns pode levantar suspeitas.

No entanto, a dependência apenas da detecção técnica é insuficiente. À medida que os modelos de IA melhoram, eles aprendam a superar essas detecções, tornando os `vídeos deepfake` ainda mais convincentes. Por isso, uma abordagem multifacetada é essencial. A educação em mídia é um pilar fundamental. Ensinar os cidadãos a serem céticos, a questionar a fonte da informação, a buscar múltiplas perspectivas e a verificar os fatos antes de compartilhar é crucial. Organizações de checagem de fatos desempenham um papel vital, embora muitas vezes operem em um ritmo mais lento do que a propagação da desinformação. Além disso, empresas de tecnologia e plataformas de redes sociais têm a responsabilidade de implementar políticas rigorosas contra deepfakes maliciosos, investir em ferramentas de detecção e rotular explicitamente o conteúdo gerado por IA.

Propostas como o uso de marcas d’água digitais invisíveis ou assinaturas criptográficas para autenticar a origem de mídias genuínas também estão em discussão, visando criar um sistema onde o conteúdo confiável possa ser distinguido do fabricado. Contudo, a implementação de tais sistemas em escala global apresenta desafios técnicos, éticos e regulatórios consideráveis.

### Regulamentação e o Futuro Incerto da Informação

A velocidade com que a tecnologia de IA avança supera em muito a capacidade dos legisladores de criar e implementar leis eficazes. Atualmente, muitos países carecem de legislação específica para lidar com os `vídeos deepfake`, o que permite que os malfeitores operem em uma zona cinzenta legal. Leis existentes, como as de difamação ou calúnia, podem ser aplicadas, mas nem sempre são adequadas para a complexidade e o alcance da desinformação via IA. Há um debate global sobre a necessidade de novas regulamentações que definam o que constitui um deepfake ilegal, estabeleçam responsabilidades para as plataformas e criadores, e prevejam sanções proporcionais. A União Europeia, por exemplo, está na vanguarda da regulamentação da IA com seu AI Act, que visa categorizar e impor regras a diferentes níveis de risco da IA, incluindo deepfakes.

O desafio é equilibrar a proteção contra a desinformação com a garantia da liberdade de expressão e a promoção da inovação. Proibir totalmente a tecnologia deepfake não é uma solução viável nem desejável, visto que ela também possui aplicações legítimas e criativas em campos como entretenimento, educação e pesquisa histórica. A chave reside em estabelecer diretrizes claras sobre o uso ético e responsável, exigindo transparência – como a rotulagem obrigatória de conteúdo gerado por IA – e penalizando severamente o uso malicioso. A cooperação internacional também é fundamental, pois os `vídeos deepfake` não respeitam fronteiras nacionais, exigindo uma resposta coordenada para combater essa ameaça transnacional.

Em suma, a luta contra a desinformação na era da IA é uma batalha contínua. Não há uma solução única, mas uma combinação de avanços tecnológicos, educação pública, vigilância de fact-checkers e regulamentação progressiva será crucial para salvaguardar a verdade e a integridade de nossas sociedades. O futuro da informação e da democracia depende da nossa capacidade coletiva de nos adaptarmos e respondermos a esses desafios sem precedentes.

**Conclusão**

Os `vídeos deepfake` representam um dos maiores desafios da era digital, especialmente no contexto político. A capacidade de criar e disseminar conteúdo visual e auditivo falsificado com tamanha autenticidade ameaça minar a confiança pública, manipular eleições e desestabilizar sociedades. O caso do senador Schumer serve como um lembrete contundente de que estamos à beira de um precipício onde a linha entre a realidade e a ilusão pode se dissolver completamente, exigindo vigilância e ação imediatas.

A responsabilidade de combater essa ameaça é compartilhada. Governos devem buscar legislações ágeis e eficazes; empresas de tecnologia devem desenvolver e implementar salvaguardas robustas; e, acima de tudo, cada indivíduo deve cultivar uma mentalidade crítica e ser um consumidor de informação consciente. Somente através de um esforço conjunto e contínuo poderemos navegar por essa nova paisagem informacional complexa e proteger os valores fundamentais de nossa democracia na era da inteligência artificial.

Share this content:

Publicar comentário