Nvidia e Google: A Batalha dos Chips que Define o Futuro da Inteligência Artificial

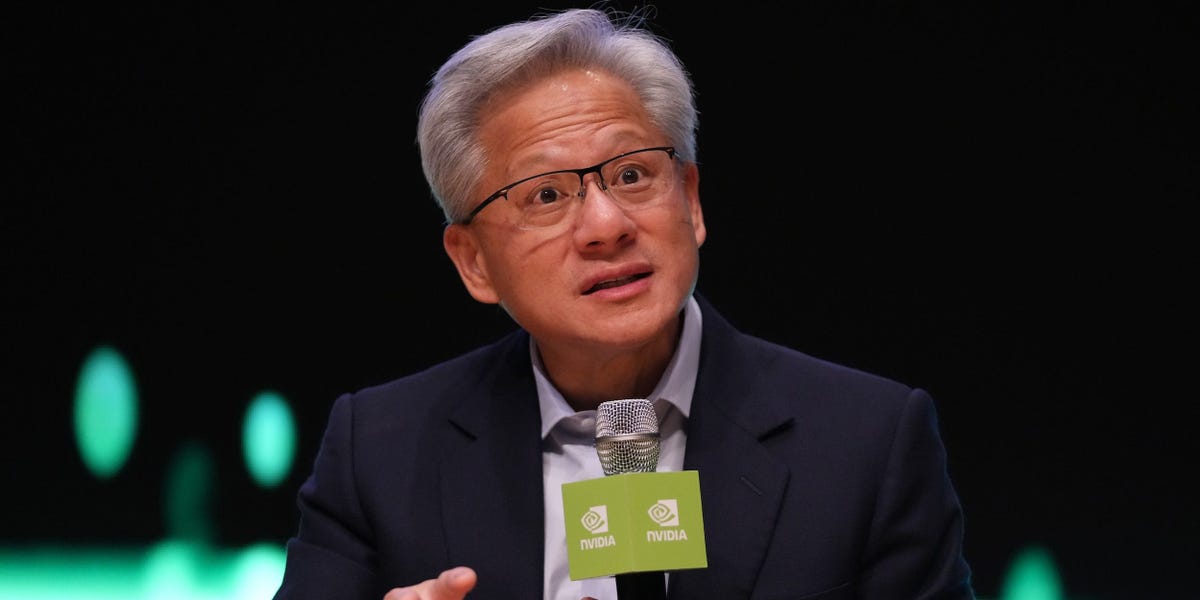

No dinâmico universo da tecnologia, poucas áreas evoluem tão rapidamente quanto a Inteligência Artificial. E no coração dessa revolução, pulsando com a energia do processamento de dados, está a guerra silenciosa – mas cada vez mais ruidosa – pelos chips que a alimentam. Recentemente, um relatório fez as ações da Nvidia balançarem, alimentando preocupações de que a Google estaria avançando em seu território, o lucrativo negócio de semicondutores para IA. A Nvidia, por sua vez, mantém a postura de que está “encantada com o sucesso da Google”, mas reafirma categoricamente que está “uma geração à frente da indústria”.

Essa declaração audaciosa não é apenas marketing; ela reflete a intensa competição e as apostas bilionárias em jogo. Enquanto a Nvidia consolidou sua posição como líder incontestável no fornecimento de hardware para IA com suas GPUs (Unidades de Processamento Gráfico), gigantes como a Google estão investindo pesado na criação de silício personalizado. A questão que paira é: será que a vantagem da Nvidia é sustentável ou estamos testemunhando o prelúdio de uma mudança de guarda no cenário da computação de alta performance? Este artigo explora essa rivalidade fascinante, mergulhando nas tecnologias, estratégias e nas profundas implicações dessa disputa para o futuro da IA.

### **A Liderança da Nvidia em Inteligência Artificial: Uma Geração de Vantagem?**

A história da **Nvidia em Inteligência Artificial** é um verdadeiro case de sucesso, um exemplo de visão estratégica e adaptação. Originalmente, a empresa se destacou no mercado de placas de vídeo para jogos, fornecendo gráficos de alta qualidade para os entusiastas de videogames. No entanto, o que a diferenciou foi a percepção precoce de que a arquitetura paralela de suas GPUs – projetadas para renderizar milhões de pixels simultaneamente – era perfeitamente adequada para as demandas computacionais dos modelos de aprendizado de máquina. A capacidade de executar inúmeras operações matemáticas em paralelo, característica intrínseca das GPUs, tornou-as ideais para treinar redes neurais complexas, que exigem exatamente esse tipo de processamento massivo.

O grande divisor de águas foi a plataforma CUDA (Compute Unified Device Architecture). Lançada em 2006, o CUDA não era apenas um hardware, mas um ambiente de desenvolvimento completo que permitia aos programadores acessar diretamente o poder de processamento paralelo das GPUs Nvidia. Essa plataforma se tornou o padrão-ouro para a computação de alto desempenho e, crucialmente, para o desenvolvimento de IA. Pesquisadores e desenvolvedores de todo o mundo abraçaram o CUDA, criando uma vasta biblioteca de algoritmos e frameworks otimizados para as GPUs Nvidia. Essa simbiose entre hardware potente e um ecossistema de software robusto cimentou a dominância da Nvidia.

Hoje, a Nvidia é sinônimo de hardware de IA, com suas GPUs H100 e a vindoura Blackwell B200 sendo as escolhas preferenciais para datacenters, empresas e instituições de pesquisa que buscam o máximo em performance para treinar e implantar modelos de IA. A empresa não apenas vende chips; ela oferece uma solução completa, desde o hardware e o software até serviços e uma comunidade de desenvolvedores engajada. Essa abordagem integrada, que abrange desde a arquitetura de chips até bibliotecas de software otimizadas (como cuDNN e TensorRT) e até mesmo supercomputadores pré-fabricados (como o DGX), é o que confere à Nvidia sua autoproclamada “vantagem de uma geração”. Não se trata apenas de um chip mais rápido, mas de um ecossistema completo que dificulta a migração para soluções concorrentes.

### **O Desafio da Google: Gigantes em Busca de Silício Próprio**

Se a Nvidia construiu um império com suas GPUs, a Google não ficou parada. Como uma das maiores consumidoras de poder computacional do planeta, especialmente para suas próprias operações de IA – pense em busca, tradução, reconhecimento de voz e visão computacional – a gigante de Mountain View percebeu a necessidade de otimizar seu hardware internamente. Em 2016, a Google revelou sua resposta: as TPUs (Tensor Processing Units). Diferentemente das GPUs de propósito geral da Nvidia, as TPUs são aceleradores de IA feitos sob medida, projetados especificamente para as cargas de trabalho de aprendizado de máquina do Google.

A estratégia por trás das TPUs é multifacetada. Primeiramente, a otimização. Ao projetar chips especificamente para redes neurais, a Google pode atingir eficiências energéticas e de desempenho que seriam difíceis de replicar com hardware de propósito geral. Isso se traduz em custos operacionais mais baixos para suas vastas operações de IA. Em segundo lugar, a independência. Desenvolver seu próprio silício reduz a dependência de fornecedores externos, concedendo à Google maior controle sobre sua cadeia de suprimentos, custos e roadmap tecnológico. Isso é crucial para uma empresa que escala suas operações de IA a níveis sem precedentes.

Desde sua primeira geração, as TPUs evoluíram significativamente, com a Google lançando versões mais poderosas e eficientes, como as TPUs v4 e v5e, que são o coração da infraestrutura de IA do Google Cloud. Essas unidades não apenas impulsionam serviços internos, mas também estão disponíveis para clientes da nuvem, oferecendo uma alternativa robusta aos aceleradores baseados em GPU. Mais recentemente, a Google expandiu sua estratégia de silício personalizado com o anúncio dos chips Axion, suas próprias CPUs baseadas em ARM, projetadas para datacenters. Embora as CPUs Axion não sejam aceleradores de IA no mesmo sentido que as TPUs ou GPUs, elas complementam a estratégia, oferecendo um controle ainda maior sobre a infraestrutura de computação geral e potencialmente melhorando a sinergia com os aceleradores de IA da Google. A ambição é clara: dominar a pilha de hardware do datacenter, desde o processamento geral até a aceleração de IA, garantindo eficiência, performance e controle total sobre seu destino digital.

### **Decifrando a “Geração à Frente”: Tecnologia e Ecossistema da Nvidia**

Quando a Nvidia afirma estar “uma geração à frente”, não se trata apenas de velocidade de clock ou de transistores por centímetro quadrado – embora ela também se destaque nesses quesitos. A essência da sua liderança reside em uma combinação intrincada de inovações em hardware, uma arquitetura de software unificada e um ecossistema de desenvolvedores inigualável. Tomemos como exemplo suas arquiteturas de chips mais recentes. A geração Hopper, com o GPU H100, introduziu o Transformer Engine, otimizado para os modelos de linguagem grandes (LLMs) que estão impulsionando a revolução da IA generativa. Este motor é capaz de alternar dinamicamente entre diferentes formatos de precisão, acelerando o treinamento e a inferência de LLMs com uma eficiência sem precedentes. E o futuro promete ainda mais com a arquitetura Blackwell, que promete um salto ainda maior em desempenho e eficiência, com chips como o B200 e o superchip GB200, que integram GPUs e CPUs em uma única unidade de alto desempenho.

Mas o hardware é apenas parte da equação. A verdadeira força da Nvidia está em seu software. O CUDA, como mencionado, é o alicerce, mas sobre ele foi construída uma vasta pilha de software que inclui bibliotecas como cuDNN (para redes neurais profundas), TensorRT (para otimização de inferência), e ecossistemas inteiros como o Nvidia AI Enterprise, que oferece um conjunto de ferramentas e frameworks para implantação de IA em escala empresarial. Essa abordagem de “pilha completa” significa que a Nvidia não apenas fornece o componente mais rápido, mas também todas as ferramentas necessárias para que os desenvolvedores extraiam o máximo desse componente, acelerando o tempo de lançamento no mercado e a produtividade. Isso cria um “efeito de rede” poderoso: quanto mais desenvolvedores usam o CUDA e o ecossistema Nvidia, mais ferramentas são criadas para ele, e mais atraente ele se torna para novos usuários. É um ciclo virtuoso de inovação e adoção.

Além disso, a Nvidia investe pesado em interconexão. Tecnologias como NVLink, que permite que múltiplas GPUs se comuniquem em velocidades altíssimas, e a arquitetura Grace Hopper Superchip, que combina uma CPU Grace baseada em ARM com uma GPU Hopper, são exemplos de como a empresa está pensando além do chip individual para criar soluções de sistema completas. Essas inovações abordam os gargalos de comunicação e memória que surgem ao escalar modelos de IA gigantescos, garantindo que o poder de processamento bruto seja efetivamente utilizado. É essa combinação de vanguarda em hardware, um ecossistema de software maduro e amplamente adotado, e soluções de sistema integradas que reforça a confiança da Nvidia em sua liderança de “uma geração”.

### **O Cenário Competitivo e os Riscos da Batalha dos Chips de IA**

O campo de batalha dos chips de IA não é exclusivo de Nvidia e Google. Outros gigantes e inúmeras startups estão correndo para abocanhar uma fatia desse mercado em ebulição. A AMD, por exemplo, tem feito progressos notáveis com suas GPUs Instinct, e a Intel, apesar de alguns percalços, está investindo pesadamente em suas GPUs Gaudi e em outras soluções de IA. Além disso, outros hyperscalers, como a Amazon (com seus chips Trainium e Inferentia) e a Microsoft, também estão desenvolvendo silício personalizado para suas próprias nuvens, seguindo a mesma lógica da Google: otimização, custo e controle. Esse cenário, embora desafiador, é extremamente benéfico para o avanço da IA como um todo, impulsionando a inovação e a competição.

Para a Nvidia, a ascensão do silício personalizado dos hyperscalers representa um risco estratégico significativo. Se os maiores clientes da Nvidia – as empresas de nuvem – começarem a usar cada vez mais seus próprios chips, isso poderia impactar as vendas e a dominância da empresa. A Nvidia precisa continuar a inovar em um ritmo acelerado para garantir que suas soluções genéricas de GPU e seu ecossistema continuem sendo superiores em performance e custo-benefício, mesmo contra chips otimizados para propósitos específicos. Outro risco é a chamada “bloqueio de fornecedor” (vendor lock-in) associada ao CUDA. Embora seja uma vantagem hoje, no futuro, a indústria pode buscar alternativas mais abertas e flexíveis, caso a Nvidia não continue a oferecer valor superior.

Por outro lado, a Google também enfrenta desafios. O desenvolvimento de chips é um empreendimento extremamente caro e complexo, exigindo investimentos maciços em P&D, fabricação e talentos. Manter a competitividade com o ritmo de inovação de uma empresa dedicada exclusivamente a GPUs como a Nvidia é uma tarefa hercúlea. Além disso, o ecossistema de software em torno das TPUs não é tão vasto e maduro quanto o CUDA, o que pode limitar sua adoção fora do ambiente do Google Cloud. A batalha não é apenas sobre o chip mais rápido, mas sobre qual ecossistema – hardware, software, ferramentas e comunidade – pode oferecer a melhor solução completa para a miríade de aplicações de IA que surgem a cada dia. Essa corrida impulsionará avanços notáveis, democratizando o acesso a um poder de processamento cada vez maior e mais eficiente, e, em última instância, acelerando o progresso da própria Inteligência Artificial.

**Conclusão**

A rivalidade entre Nvidia e Google no campo dos chips de IA é um reflexo vibrante da importância estratégica da Inteligência Artificial no mundo contemporâneo. A Nvidia, com sua infraestrutura robusta, seu ecossistema CUDA consolidado e a promessa de arquiteturas inovadoras como a Blackwell, tem um argumento forte para sua liderança. No entanto, a Google, com sua capacidade de engenharia massiva e a aposta em silício personalizado como as TPUs e os chips Axion, está posicionada para desafiar essa dominância, otimizando seus próprios recursos e oferecendo alternativas poderosas no cenário da computação em nuvem.

Independentemente de qual gigante prevalecerá em qual segmento, uma coisa é certa: essa competição feroz é um motor inesgotável para a inovação. Ela forçará ambas as empresas, e o mercado como um todo, a empurrar os limites do que é possível em termos de desempenho, eficiência e acessibilidade para a **Nvidia em Inteligência Artificial**. No final, quem mais ganha somos nós, consumidores e desenvolvedores, com acesso a ferramentas cada vez mais potentes e versáteis que continuarão a moldar o futuro de uma era impulsionada pela IA. A batalha dos chips está apenas começando, e promete ser um espetáculo fascinante de engenharia e estratégia.

Share this content:

Publicar comentário