O Labirinto da Governança: Por Que a Regulação da Inteligência Artificial Exige Mais Que Decretos Simples

A Inteligência Artificial (IA) não é mais um conceito de ficção científica, mas uma força transformadora que redefine indústrias, governos e a própria vida cotidiana. De algoritmos que personalizam nossas redes sociais a sistemas complexos que auxiliam diagnósticos médicos ou otimizam cadeias de suprimentos, a IA está em todo lugar. Essa revolução tecnológica, porém, traz consigo uma série de desafios éticos, sociais e econômicos que clamam por uma governança séria e bem articulada. A grande questão que paira sobre legisladores, tecnólogos e cidadãos é: como regulamos algo tão dinâmico, ubíquo e poderoso? Seria um simples decreto executivo ou um “livro de regras” único suficiente para guiar essa nova era?

Como entusiasta e especialista em IA, acompanho de perto o debate global sobre como frear os riscos e potencializar os benefícios dessa tecnologia. A ideia de que uma única canetada ou um conjunto simplificado de diretrizes possa dar conta da vastidão e complexidade da IA é, no mínimo, ingênua. Na verdade, é um desserviço à inovação responsável e à proteção da sociedade. Precisamos ir muito além de soluções superficiais, buscando um arcabouço legal que seja robusto, adaptável e, acima de tudo, humano. Este artigo mergulha nas razões pelas quais a simplicidade na governança da IA pode ser perigosa e o que realmente precisamos construir para um futuro inteligente e seguro.

Regulação da Inteligência Artificial: Mais do que um ‘Livro de Regras’ Único

A premissa de que podemos enquadrar toda a vastidão da IA em um único “livro de regras” é sedutora em sua simplicidade, mas profundamente equivocada em sua aplicação. A **regulação da inteligência artificial** não pode se dar ao luxo de ser simplista, justamente pela natureza multifacetada da tecnologia que busca governar. Imagine tentar regulamentar todos os tipos de veículos – desde um patinete elétrico até um caminhão de carga, passando por aviões e foguetes – com um único conjunto de normas. Parece absurdo, não é? A IA é ainda mais complexa.

Primeiramente, a IA se manifesta em uma miríade de aplicações, cada uma com seu próprio perfil de risco e impacto. Um algoritmo de recomendação de filmes, por exemplo, embora possa apresentar viés cultural, tem um potencial de dano muito menor do que um sistema de IA usado para decidir sobre a concessão de crédito, sentenças judiciais ou controle de tráfego aéreo. Regulamentar um sistema de diagnóstico médico por IA, que pode afetar diretamente a vida e a saúde de um paciente, exige um nível de escrutínio, transparência e responsabilidade que não se compara à governança de um chatbot de atendimento ao cliente. Um decreto executivo genérico ou uma “regra única” falharia em distinguir e abordar essas nuances críticas, criando brechas perigosas onde deveria haver proteção, ou sufocando inovações seguras onde deveria haver incentivo.

Além disso, a distinção entre sistemas de “alto risco” e “baixo risco” é fundamental para qualquer legislação de IA eficaz. A União Europeia, por exemplo, em seu Ato de IA, adota uma abordagem baseada em risco, impondo requisitos mais rigorosos para aplicações que podem ter consequências negativas significativas para a saúde, segurança ou direitos fundamentais das pessoas. Essa granularidade permite que a inovação floresça em áreas de menor risco, enquanto as aplicações mais críticas são submetidas a testes rigorosos, auditorias e supervisão humana. Um enfoque de “um só livro de regras” ignoraria essa gradação, impondo um peso desnecessário sobre tecnologias benignas ou, o que é pior, falhando em proteger a sociedade de usos potencialmente maliciosos ou danosos da IA.

A tecnologia de IA também não é estática. Ela evolui em uma velocidade vertiginosa, com novas descobertas e aplicações surgindo constantemente. Uma regulamentação rígida e inflexível, baseada em um conjunto de regras monolíticas, rapidamente se tornaria obsoleta. Precisamos de um arcabouço regulatório que seja ágil, capaz de se adaptar às mudanças tecnológicas sem a necessidade de reescrever toda a legislação a cada nova geração de modelos de linguagem ou algoritmos de aprendizado de máquina. A busca por um “livro de regras” único, nesse sentido, representa uma tentativa de congelar o tempo em um campo que está em constante movimento, condenando a eficácia da regulação antes mesmo de sua plena implementação.

Os Desafios Inerentes à Governança da IA em um Mundo Dinâmico

A tarefa de criar uma estrutura regulatória para a IA é um dos maiores desafios jurídicos e políticos da nossa era, transcendendo fronteiras e ideologias. Os obstáculos são múltiplos e interligados, tornando qualquer tentativa de simplificação perigosa.

Um dos maiores desafios é o ritmo acelerado da inovação. Diferente de indústrias tradicionais, a IA evolui de forma exponencial. Leis e regulamentos, por sua natureza, são lentos para serem criados e implementados. Quando uma nova lei de IA é finalmente aprovada, a tecnologia que ela pretende governar já pode ter avançado significativamente, tornando partes da legislação irrelevantes ou insuficientes. Isso exige abordagens mais flexíveis, como regulamentações baseadas em princípios, caixas de areia regulatórias (sandboxes) e a capacidade de atualizar rapidamente as diretrizes.

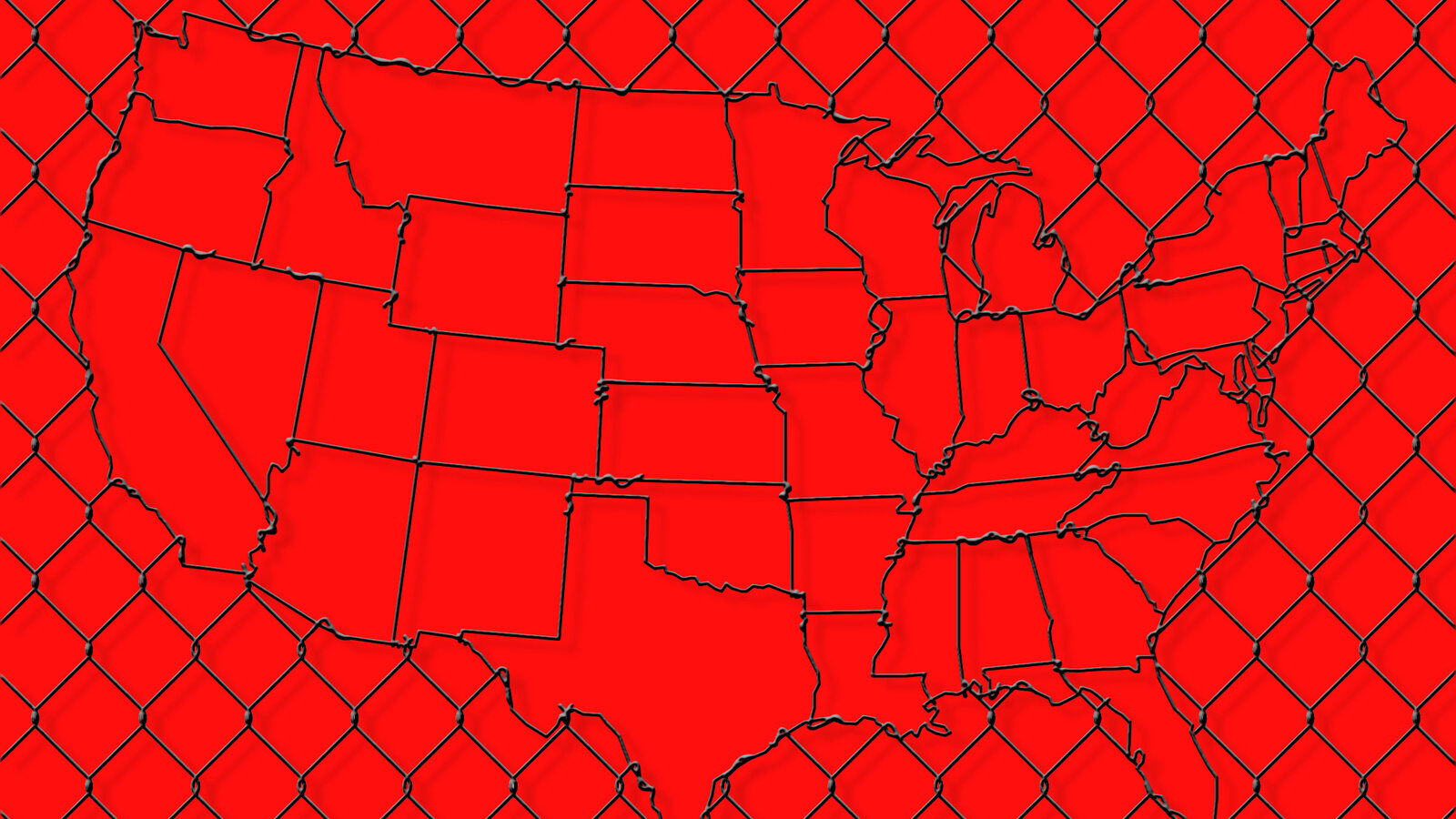

Outra complexidade reside na natureza global da IA. Os modelos de IA são desenvolvidos por empresas em um país, treinados com dados de outro e implementados globalmente. Isso levanta questões sobre jurisdição, aplicação de leis e harmonização internacional. Um decreto executivo unilateral de um único país, por mais poderoso que seja, terá limitações significativas no que diz respeito à sua aplicação fora de suas fronteiras, potencialmente criando um mosaico de regulamentações conflitantes que podem sufocar a inovação global ou, inversamente, permitir que atores mal-intencionados explorem as lacunas.

As questões éticas e sociais são o cerne de muitos debates sobre IA. Preocupações com viés algorítmico, privacidade de dados, segurança, accountability (quem é responsável quando a IA erra?), transparência (o problema da “caixa preta” ou black box, onde não entendemos como a IA toma decisões) e o impacto no emprego são apenas a ponta do iceberg. Cada uma dessas áreas exige considerações cuidadosas e, muitas vezes, soluções específicas que dificilmente seriam contempladas por uma abordagem simplificada. Por exemplo, garantir a equidade em algoritmos de contratação exige auditorias específicas e testes de viés, algo muito diferente de garantir a segurança de um sistema de IA em um veículo autônomo.

Ainda temos a lacuna de conhecimento técnico entre formuladores de políticas e especialistas em IA. Muitos legisladores não possuem o entendimento profundo da tecnologia necessário para criar leis eficazes e informadas. Essa desconexão pode levar a regulamentações mal concebidas que ou são impraticáveis ou falham em abordar os verdadeiros riscos, ao mesmo tempo em que ignoram o potencial da IA. É vital que haja um diálogo contínuo e uma colaboração entre o setor público, a academia, a indústria e a sociedade civil para preencher essa lacuna.

Construindo um Futuro Robusto: Abordagens Abrangentes e Colaborativas

Diante da complexidade e dos desafios, fica claro que a **regulação da inteligência artificial** requer uma abordagem multifacetada, colaborativa e adaptável. Em vez de buscar um “livro de regras” único, devemos aspirar a um arcabouço jurídico e ético que combine princípios gerais com normas específicas, sempre com foco na proteção dos cidadãos e na promoção da inovação responsável.

A experiência global nos oferece modelos promissores. O Ato de IA da União Europeia, por exemplo, é um marco por sua abordagem baseada em risco, classificando os sistemas de IA em categorias que vão do risco inaceitável (como sistemas de pontuação social) ao risco mínimo, com requisitos proporcionais para cada um. Essa metodologia reconhece a diversidade da IA e permite que a inovação continue em áreas de baixo risco, enquanto impõe obrigações rigorosas onde o potencial de dano é maior.

Para o Brasil, é essencial seguir um caminho semelhante, adaptado às nossas realidades e prioridades. Já temos discussões avançadas no Congresso Nacional, com projetos de lei como o PL 2338/2023, que busca estabelecer um marco legal para o desenvolvimento e uso da IA. Esse projeto, em constante aprimoramento, reflete a necessidade de um debate amplo, envolvendo diversos setores da sociedade. Ele propõe princípios como respeito aos direitos humanos, não discriminação, transparência, segurança, responsabilidade e o desenvolvimento sustentável. Tais princípios servem como uma bússola, orientando a aplicação da IA em diferentes contextos, e são muito mais eficazes do que uma lista rígida de proibições ou permissões.

Um pilar fundamental para uma governança eficaz é a colaboração multi-stakeholder. Governos não podem e não devem legislar sobre IA isoladamente. É imperativo envolver especialistas da indústria (que compreendem a tecnologia e suas aplicações práticas), acadêmicos (que trazem a pesquisa e a perspectiva crítica), a sociedade civil (que representa os interesses dos cidadãos e os impactos sociais) e até mesmo os próprios desenvolvedores de IA. Essa sinergia garante que as leis sejam tecnicamente viáveis, eticamente sólidas e socialmente aceitáveis. Fóruns de discussão, audiências públicas e grupos de trabalho técnicos são ferramentas cruciais nesse processo.

Além disso, a educação e a alfabetização digital são componentes vitais. Cidadãos informados são capazes de participar do debate, entender os riscos e benefícios da IA e fazer escolhas conscientes. Para os formuladores de políticas, investir em capacitação técnica e na consulta a especialistas é fundamental para evitar a criação de leis baseadas em desinformação ou falta de compreensão. A capacidade de auditar e fiscalizar sistemas de IA também requer novas habilidades e infraestrutura por parte dos órgãos reguladores.

A cooperação internacional é outro elemento insubstituível. Como a IA é uma tecnologia global, soluções puramente nacionais terão um alcance limitado. A harmonização de padrões, a troca de informações e a coordenação de esforços regulatórios entre países são essenciais para evitar a criação de “refúgios regulatórios” e para lidar com desafios transfronteiriços, como a disseminação de desinformação por IA ou ataques cibernéticos sofisticados.

Por fim, qualquer arcabouço de governança deve prever mecanismos de revisão e adaptação contínuos. A legislação deve ser pensada como um organismo vivo, capaz de ser atualizado e ajustado à medida que a tecnologia de IA avança e novas compreensões sobre seus impactos emergem. Isso pode incluir cláusulas de revisão periódica, a criação de órgãos consultivos especializados em IA e a flexibilidade para a criação de regulamentos complementares conforme a necessidade.

Em suma, a tarefa de governar a IA é uma maratona, não um sprint. Exige paciência, expertise, abertura ao diálogo e uma visão de longo prazo. Reduzir essa complexidade a um mero decreto ou a um “livro de regras” único seria um atalho perigoso, com o potencial de comprometer a segurança, a ética e a própria inovação que buscamos fomentar.

Conclusão

A promessa da Inteligência Artificial é imensa, capaz de nos impulsionar para um futuro de avanços sem precedentes na medicina, na ciência e em nossa qualidade de vida. No entanto, o caminho para concretizar esse potencial sem tropeçar nos perigos inerentes à tecnologia exige uma abordagem regulatória que seja tão sofisticada quanto a própria IA. A ideia de que um simples decreto executivo ou um “livro de regras” único possa dar conta dessa complexidade é uma ilusão que ignora a diversidade de aplicações, o ritmo vertiginoso da inovação e as profundas implicações éticas e sociais da IA. Precisamos de leis que respirem, que se adaptem, que sejam informadas por especialistas e que priorizem o bem-estar humano, a equidade e a inovação responsável.

O Brasil, assim como outras nações, tem a oportunidade de ser um protagonista na construção de um futuro digital responsável. Isso significa investir em um processo legislativo robusto, que promova o diálogo entre governo, indústria, academia e sociedade civil. Significa adotar modelos baseados em risco, princípios éticos claros e mecanismos de revisão contínua. É um esforço monumental, sem dúvida, mas absolutamente necessário. Somente assim poderemos desvendar o labirinto da governança da IA e garantir que essa tecnologia poderosa sirva verdadeiramente à humanidade, impulsionando o progresso de forma segura e justa para todos.

Share this content:

Publicar comentário