Revolução Térmica: Como os Chips de IA da Nvidia Estão Reconfigurando a Refrigeração de Data Centers

A inteligência artificial (IA) não é apenas a força motriz por trás das inovações mais emocionantes da década; ela também é uma catalisadora de mudanças profundas e, por vezes, inesperadas em indústrias adjacentes. No epicentro dessa revolução, a Nvidia, gigante da tecnologia e líder incontestável no fornecimento de hardware para IA, está novamente agitando o mercado. Recentemente, comentários do CEO da empresa sugeriram que seus novos chips podem tornar “desnecessários” alguns sistemas de resfriamento em data centers. Essa afirmação, embora possa parecer técnica demais à primeira vista, levanta uma série de questões cruciais sobre o futuro da infraestrutura que sustenta a IA, a sustentabilidade e os investimentos em tecnologias de resfriamento. Será que estamos presenciando o prenúncio de uma nova era para os data centers, onde a eficiência energética dos chips redefine completamente suas necessidades térmicas? Ou é um alerta sobre a volatilidade de um mercado em constante evolução, onde a inovação em uma área pode desestabilizar outra? Mergulhe conosco nesta análise para entender as complexidades por trás dessa declaração e o que ela significa para o ecossistema da inteligência artificial no Brasil e no mundo.

Refrigeração de Data Centers: O Novo Paradigma com Chips de IA de Alto Desempenho

Por décadas, a refrigeração de data centers tem sido um pilar fundamental da infraestrutura de TI. Servidores geram calor, e o calor excessivo é o inimigo número um da performance e da longevidade dos equipamentos. Historicamente, os data centers consumiam quantidades exorbitantes de energia elétrica não apenas para alimentar os servidores, mas também para resfriá-los. Sistemas complexos de ar condicionado (CRACs e CRAHs), chillers, torres de resfriamento e fluxos de ar otimizados são a espinha dorsal dessas instalações, garantindo que a temperatura ideal seja mantida para evitar falhas e maximizar a eficiência operacional. Estima-se que os sistemas de resfriamento possam ser responsáveis por até 40% do consumo total de energia de um data center, um número assombroso que destaca sua importância — e seu custo.

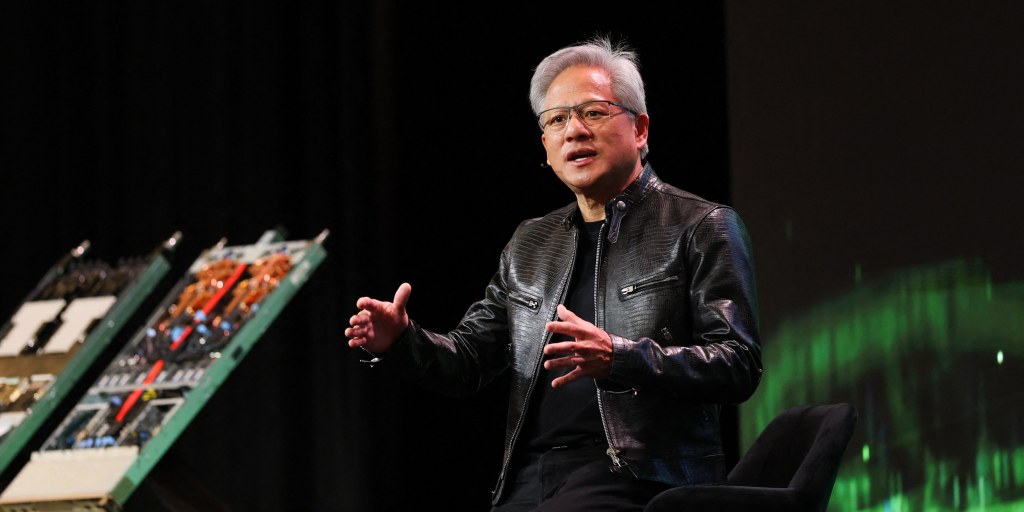

No entanto, a chegada dos novos chips de IA da Nvidia, como as arquiteturas Hopper, Blackwell e as futuras gerações, está começando a desafiar essa equação tradicional. O CEO da Nvidia, Jensen Huang, ao mencionar que esses chips poderiam tornar alguns sistemas de resfriamento “não necessários”, não estava apenas fazendo uma declaração audaciosa; ele estava apontando para uma mudança tecnológica fundamental. A inovação não reside apenas no poder de processamento sem precedentes que esses chips oferecem para treinar e executar modelos de IA, mas também em sua surpreendente eficiência energética. Esses processadores são projetados para realizar mais trabalho por watt de energia, o que significa menos calor gerado para a mesma quantidade de computação ou, em muitos casos, muito mais computação com um aumento de calor proporcionalmente menor do que o esperado.

Essa eficiência é fruto de avanços na arquitetura dos transistores, no design dos pacotes de chips e em métodos de interconexão que reduzem a resistência e, consequentemente, a dissipação de calor indesejada. Além disso, muitos desses chips de ponta são otimizados para resfriamento líquido direto-ao-chip. Em vez de tentar resfriar todo o ambiente do data center com ar condicionado, o resfriamento líquido atua diretamente nos componentes mais quentes, removendo o calor de forma muito mais eficiente e em um espaço menor. Isso pode reduzir significativamente a dependência de grandes e custosos sistemas de resfriamento a ar, que hoje ocupam vastas áreas dentro dos data centers e requerem uma manutenção intensiva.

A Dinâmica do Mercado e a Repercussão na Indústria de Cooling

A fala de Huang, ao levantar a possibilidade de que “alguns” sistemas de resfriamento se tornem “não necessários”, não sugere o fim total da indústria de refrigeração de data centers. Em vez disso, aponta para uma reconfiguração. Empresas que se especializam em soluções de resfriamento a ar tradicionais, como grandes CRACs, chillers complexos e sistemas de gerenciamento de fluxo de ar de corredor quente/frio, podem enfrentar uma demanda reduzida ou, no mínimo, uma mudança radical nas especificações exigidas. O foco se desloca de sistemas de resfriamento de infraestrutura ampla para soluções mais localizadas e de alta densidade.

Por outro lado, essa transição abre vastas oportunidades para empresas inovadoras focadas em resfriamento líquido, imersão e outras tecnologias de gerenciamento térmico de ponta. O resfriamento por imersão, por exemplo, onde os servidores são totalmente submersos em um fluido dielétrico não condutor, é extremamente eficiente e permite densidades de rack muito maiores, com menor consumo de energia para resfriamento. Essas tecnologias, antes consideradas nicho ou experimentais, estão rapidamente ganhando tração à medida que os requisitos de energia dos servidores de IA disparam.

O mercado de data centers está avaliado em trilhões de dólares globalmente, com a parcela de infraestrutura de resfriamento representando bilhões desse total. Uma mudança sísmica como a sugerida pela Nvidia pode levar a uma reavaliação dos modelos de negócios e estratégias de investimento de muitas empresas do setor. Os fabricantes de equipamentos precisarão se adaptar rapidamente, desenvolvendo produtos que atendam às novas demandas de resfriamento direto e de alta densidade, em vez de se focar exclusivamente em soluções de resfriamento de ar ambiente. Investimentos em pesquisa e desenvolvimento nessas novas fronteiras serão cruciais para a sobrevivência e o crescimento nesse cenário em transformação. Essa adaptação não é apenas uma questão tecnológica; é uma questão de agilidade empresarial e visão estratégica.

Sustentabilidade e o Futuro dos Data Centers na Era da IA

Além das implicações econômicas e tecnológicas, a discussão sobre a eficiência dos chips e a refrigeração de data centers tem um peso significativo no debate sobre sustentabilidade. A IA, embora transformadora, é também uma tecnologia faminta por energia. O treinamento de modelos de linguagem grandes (LLMs), por exemplo, pode consumir tanta energia quanto cidades pequenas, levantando preocupações sérias sobre a pegada de carbono da indústria de tecnologia.

Se os novos chips de IA puderem reduzir substancialmente a necessidade de resfriamento intensivo, o impacto ambiental será imenso. Menos energia para resfriamento significa menos emissões de gases de efeito estufa e um caminho mais viável para data centers neutros em carbono ou até mesmo positivos em carbono. Isso não é apenas bom para o planeta, mas também para os negócios, dado o aumento dos custos de energia e a pressão regulatória por práticas mais verdes. A União Europeia, por exemplo, já tem metas ambiciosas para a eficiência energética de data centers, e o Brasil, com seu crescente parque de data centers, também começa a se mover nessa direção.

O futuro dos data centers, impulsionado pela IA, não é apenas sobre processamento bruto; é sobre processamento inteligente, eficiente e, acima de tudo, sustentável. A otimização da refrigeração de data centers, ao lado da eficiência dos próprios chips, será um fator-chave para determinar a escalabilidade da IA e sua aceitação social a longo prazo. À medida que a demanda por IA continua a crescer exponencialmente, a capacidade de construir e operar data centers que possam suportar essa demanda sem esgotar os recursos ou sobrecarregar as redes elétricas se tornará uma prioridade máxima. Este é um convite para inovação em todas as frentes, desde o design do chip até a arquitetura do prédio do data center, passando pela escolha do local e as fontes de energia renovável. A sinergia entre o hardware de IA e a infraestrutura de apoio é mais crítica do que nunca, moldando um futuro onde a tecnologia avançada e a responsabilidade ambiental podem coexistir harmoniosamente.

A declaração da Nvidia sobre o impacto de seus chips na refrigeração de data centers não é apenas uma nota de rodapé no noticiário financeiro; é um sinal de uma transformação em curso. A inovação em IA está redefinindo as regras do jogo para a infraestrutura digital, empurrando os limites da eficiência e da sustentabilidade. À medida que avançamos, a capacidade de adaptação e a busca por soluções inovadoras em todos os elos da cadeia de valor da IA serão diferenciais cruciais. Estamos no limiar de uma nova era, onde a inteligência artificial não apenas otimiza o mundo, mas também otimiza a si mesma, começando por sua própria casa digital.

O futuro dos data centers é líquido, eficiente e profundamente interconectado com os avanços mais recentes em IA. Aqueles que entenderem e abraçarem essa mudança estarão à frente, construindo a base para a próxima geração de tecnologias que moldarão nosso amanhã. Este cenário não é apenas sobre o que a IA pode fazer, mas como ela pode ser feita de forma mais inteligente e responsável.

Share this content:

Publicar comentário