A Nova Fronteira da Verdade: Como Imagens de IA Alimentam a Desinformação Online

Em um mundo cada vez mais conectado, onde a informação viaja na velocidade da luz, a linha entre o real e o fabricado se tornou alarmantemente tênue. A ascensão da inteligência artificial generativa, embora carregada de promessas e inovações, também abriu as portas para um novo e perigoso desafio: a proliferação da desinformação em uma escala sem precedentes. Imagens, vídeos e até textos criados por algoritmos sofisticados podem agora enganar até mesmo os observadores mais atentos, colocando em xeque nossa capacidade de discernir a verdade. Este cenário não é uma projeção futurista distante; é uma realidade palpável que já se manifesta em eventos cotidianos, confundindo o público e distorcendo a percepção de fatos cruciais. A era da **desinformação por IA** não é apenas um tema de debate, mas uma urgência a ser compreendida e combatida por todos que navegam na internet.

### Como a desinformação por IA ganha força em meio a eventos críticos

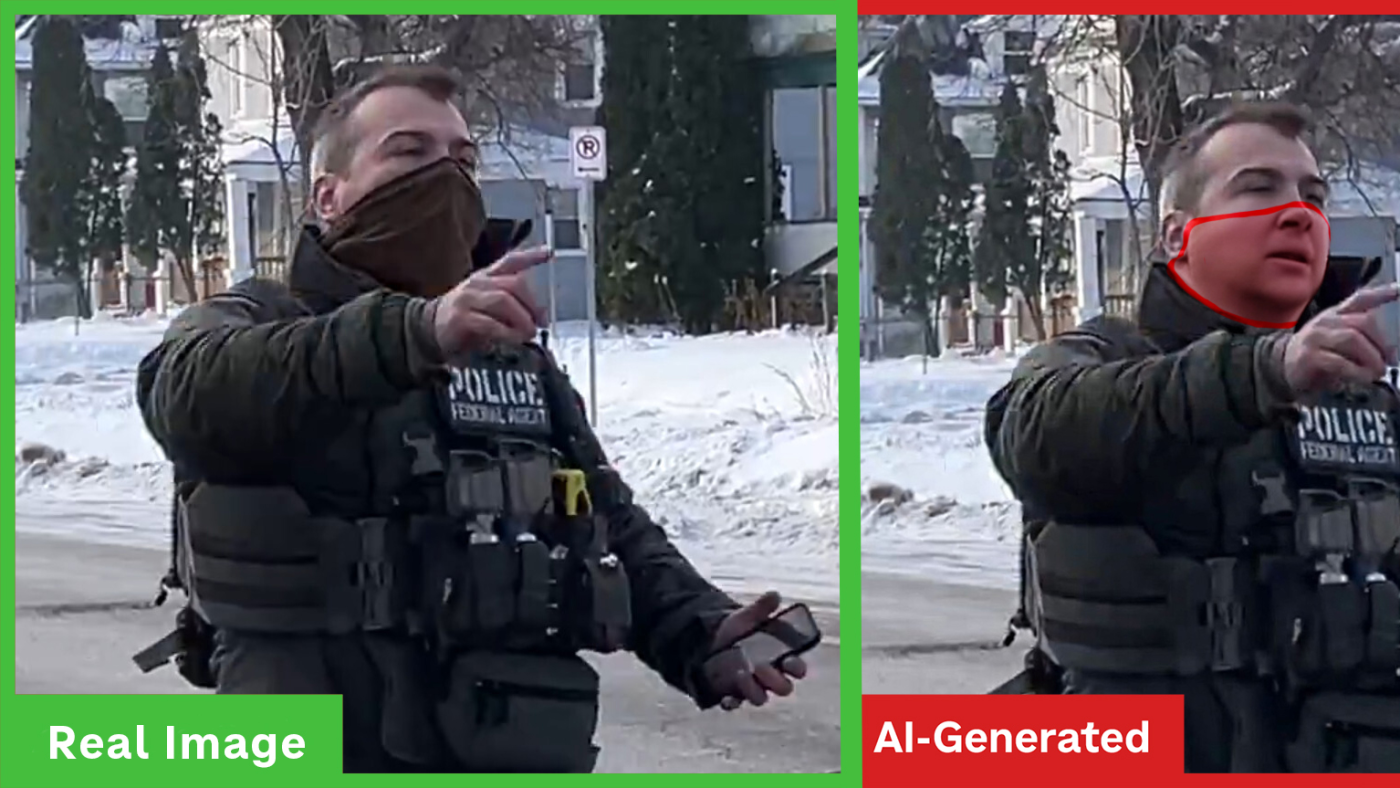

Recentemente, um incidente envolvendo um agente da Imigração e Alfândega dos EUA (ICE) ilustrou de forma contundente o poder e a periculosidade das imagens geradas por inteligência artificial. Durante um evento que capturou a atenção do público e da mídia, o agente em questão utilizava uma máscara, como demonstravam os vídeos gravados no local. No entanto, em um piscar de olhos digital, diversas publicações nas redes sociais começaram a circular uma imagem do mesmo agente, supostamente sem máscara. A discrepância era gritante e, para muitos, perturbadora. O que parecia ser uma revelação ou uma falha de segurança, na verdade, era uma criação artificial. Análises posteriores indicaram que essa imagem aparentemente autêntica havia sido gerada pelo Grok, o chatbot de IA generativa da xAI, empresa fundada por Elon Musk. Este episódio específico serviu como um poderoso lembrete de quão facilmente nossa percepção da realidade pode ser alterada quando a tecnologia de IA é utilizada para fins maliciosos ou, simplesmente, para criar conteúdo que confunde.

O caso do agente do ICE é emblemático por várias razões. Primeiro, ele demonstra a sofisticação atual das ferramentas de IA generativa. O Grok, assim como outros modelos similares, é capaz de criar imagens tão realistas que a olho nu são quase indistinguíveis de fotografias genuínas. A textura da pele, a iluminação, os detalhes faciais – tudo é replicado com uma precisão assustadora. Segundo, a rapidez com que essas imagens falsas podem se espalhar pelas redes sociais é alarmante. Em questão de minutos, uma imagem artificial pode ser compartilhada por milhares ou milhões de usuários, atingindo um público vasto antes mesmo que qualquer verificação de fatos possa ser realizada. Terceiro, o contexto da notícia – um agente de segurança pública envolvido em um evento potencialmente sensível – amplifica o impacto da desinformação. Rumores e imagens falsas podem alimentar teorias da conspiração, erodir a confiança nas instituições e até mesmo incitar a violência. A manipulação visual, especialmente em situações de alta tensão, tem um potencial imenso para desestabilizar e confundir.

### A Anatomia da Manipulação Digital: De Deepfakes a Rumores Persistentes

A inteligência artificial generativa vai muito além da criação de imagens estáticas. Termos como ‘deepfakes’ já fazem parte do nosso vocabulário, referindo-se a vídeos ou áudios manipulados onde rostos e vozes de pessoas são substituídos ou alterados de forma convincente. Elon Musk, ao lançar o Grok, prometeu um chatbot com um toque de humor e uma perspectiva um tanto rebelde, mas o incidente com a imagem do agente do ICE ressalta uma dimensão mais sombria de tais tecnologias: seu uso em contextos de desinformação. O Grok, como um modelo de linguagem grande (LLM), pode gerar não apenas imagens, mas também textos que parecem humanos, contribuindo para a disseminação de narrativas falsas ou enganosas. Essa capacidade de produzir conteúdo multimídia falso com baixo custo e alta velocidade é o que torna a **desinformação por IA** um desafio tão complexo.

Historicamente, a manipulação de imagens não é novidade. Desde os primórdios da fotografia, técnicas de retoque e montagem têm sido usadas para alterar a realidade. No entanto, a IA generativa representa um salto quântico nessa capacidade. Antigamente, criar uma imagem falsa convincente exigia habilidades e softwares complexos, acessíveis a poucos. Hoje, com ferramentas como o Midjourney, DALL-E, Stable Diffusion e, como vimos, o Grok, qualquer pessoa com acesso à internet e algumas instruções simples pode gerar conteúdo visual fotorrealista. Essa democratização da manipulação digital é uma faca de dois gumes: por um lado, abre portas para a criatividade e inovação; por outro, potencializa a disseminação de mentiras. Pense em um cenário eleitoral, por exemplo. Um vídeo ‘deepfake’ de um candidato fazendo declarações chocantes pode se espalhar viralmente poucas horas antes da votação, influenciando o resultado de forma irreversível antes que a verdade venha à tona. No Brasil, onde as discussões políticas são acaloradas e a conectividade digital é massiva, o risco de interferência por meio de **desinformação por IA** é particularmente elevado.

A psicologia humana também desempenha um papel crucial nessa equação. Somos mais propensos a acreditar em informações que confirmam nossas crenças pré-existentes (viés de confirmação) e a compartilhar conteúdo que evoca emoções fortes, sejam elas raiva, medo ou surpresa. As imagens de IA, habilmente construídas para provocar essas reações, exploram essa vulnerabilidade. Além disso, a simples repetição de uma mentira, mesmo que obviamente falsa, pode gradualmente levá-la a ser percebida como verdadeira, um fenômeno conhecido como ‘efeito da ilusão da verdade’. Com a velocidade e o volume de conteúdo gerado por IA, a repetição e a disseminação de falsidades se tornam ainda mais eficientes, minando a confiança nas fontes de informação tradicionais e na própria capacidade de distinguir o fato da ficção.

### Navegando na Neblina Digital: Estratégias para um Futuro Mais Cético e Informado

Diante da crescente onda de **desinformação por IA**, é fundamental desenvolver estratégias multifacetadas para proteger a integridade do espaço informacional. Não há uma solução única, mas sim um conjunto de abordagens que envolvem tecnologia, educação, regulamentação e responsabilidade individual e coletiva.

Uma das defesas mais importantes é a **literacia midiática** e o **pensamento crítico**. Em vez de aceitar o que vemos ou lemos online como verdade incontestável, precisamos cultivar um ceticismo saudável. Perguntas como: “Qual é a fonte desta informação?”, “Quem se beneficia com a disseminação desta notícia?”, “Existem outras fontes verificadas que confirmam esta informação?” devem se tornar um hábito. Ensinar crianças e adultos a questionar e a verificar informações é tão crucial quanto ensinar a ler e escrever na era digital. Organizações de verificação de fatos, como a Agência Lupa e o Aos Fatos no Brasil, desempenham um papel vital, mas a capacidade de identificar sinais de manipulação deve ser democratizada.

Do ponto de vista tecnológico, a luta contra a desinformação é uma corrida armamentista. Enquanto os desenvolvedores de IA criam ferramentas para gerar conteúdo, outros pesquisadores trabalham em **ferramentas de detecção de IA**. Algoritmos podem analisar padrões e anomalias em imagens e vídeos para identificar se foram gerados por IA. A iniciativa C2PA (Coalition for Content Provenance and Authenticity), por exemplo, busca criar padrões de rastreabilidade para o conteúdo digital, permitindo que os criadores anexem metadados que comprovem a origem e as alterações de uma imagem ou vídeo. Isso funcionaria como uma espécie de ‘passaporte digital’ para o conteúdo, ajudando os usuários a confiar na sua autenticidade. O uso de marcas d’água invisíveis ou visíveis, embora possa ser contornável, também é uma estratégia em desenvolvimento para sinalizar conteúdo gerado por IA.

As **plataformas de redes sociais** carregam uma responsabilidade imensa. Elas são os principais veículos para a disseminação de desinformação e, portanto, precisam investir mais em moderação de conteúdo, algoritmos que priorizem informações confiáveis e sistemas para alertar os usuários sobre conteúdo potencialmente falso. A rotulagem explícita de conteúdo gerado por IA é um passo essencial. Se uma imagem ou vídeo é identificado como sendo produto de IA, as plataformas deveriam sinalizá-lo claramente para os usuários, permitindo que estes façam um julgamento informado. Além disso, a transparência dos modelos de IA e a responsabilização dos desenvolvedores por usos indevidos de suas tecnologias são questões éticas e regulatórias prementes.

Governos e órgãos reguladores também têm um papel a desempenhar. Leis que combatam a disseminação deliberada de desinformação, especialmente em contextos eleitorais ou de saúde pública, podem ser necessárias, embora sempre com o cuidado de não cercear a liberdade de expressão. A colaboração internacional é fundamental, pois a desinformação não respeita fronteiras geográficas. A criação de conselhos consultivos de IA, formados por especialistas de diversas áreas, pode ajudar a guiar o desenvolvimento ético e o uso responsável dessas tecnologias.

A **desinformação por IA** é um desafio complexo, com implicações profundas para a nossa sociedade. A capacidade de máquinas gerarem conteúdo indistinguível do real exige que repensemos fundamentalmente a forma como consumimos e compartilhamos informações. O incidente envolvendo o agente do ICE e as imagens geradas pelo Grok são apenas um vislumbre do que está por vir, servindo como um alerta para a urgência de agir. A batalha pela verdade no ambiente digital não é apenas sobre tecnologia, mas sobre nossa resiliência coletiva e compromisso com um futuro onde a informação confiável prevaleça.

Para navegar com segurança nessa nova paisagem digital, cada um de nós deve se tornar um guardião da verdade, exercendo o ceticismo digital e buscando ativamente fontes de informação verificadas. A era da **desinformação por IA** nos desafia a ser mais críticos, mais informados e mais responsáveis. Somente através de um esforço conjunto – entre desenvolvedores de tecnologia, plataformas online, governos, educadores e, crucialmente, o público em geral – poderemos construir um ecossistema informacional mais robusto e menos vulnerável às manipulações. O futuro da verdade depende de nossa capacidade de adaptação e de nossa determinação em distinguir o fato da ficção em um mundo onde as máquinas aprendem a mentir com maestria.

Share this content:

Publicar comentário