A Visão Pioneira de John Carmack: Cache de Fibra Óptica para Redefinir a Memória da IA

No universo da tecnologia, poucos nomes brilham com a intensidade de John Carmack. O lendário programador, co-criador de clássicos como Doom e Quake, e um dos pioneiros da realidade virtual, é conhecido por sua mente brilhante e sua capacidade de desafiar os limites do possível. Não é surpresa, portanto, que ele esteja mais uma vez à frente do pensamento inovador, desta vez ao contemplar uma solução radical para um dos maiores gargalos da inteligência artificial moderna: a memória.

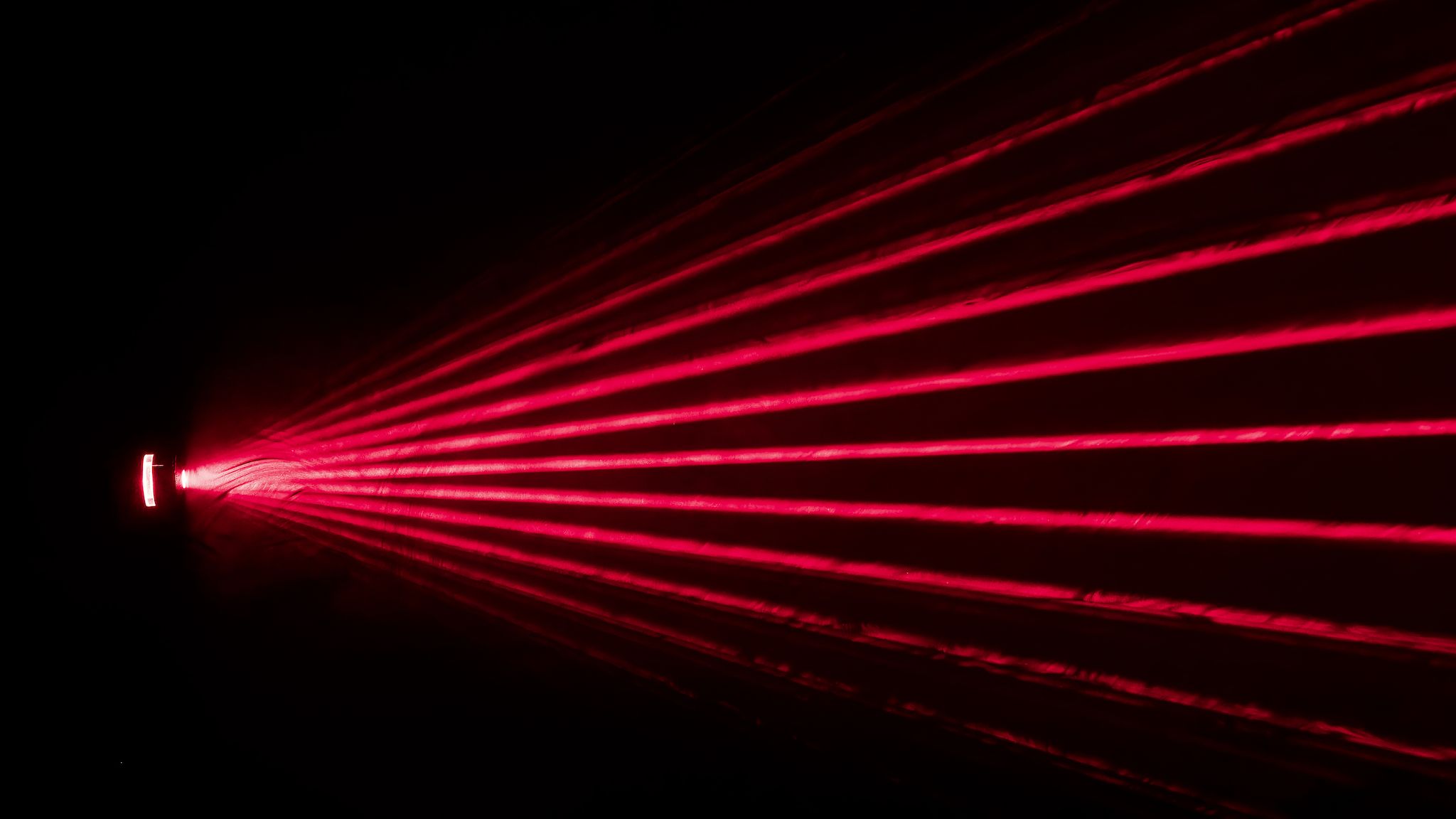

A computação, especialmente no campo da IA, está em constante evolução, exigindo cada vez mais poder de processamento e, crucially, formas mais eficientes de lidar com volumes massivos de dados. A ideia de Carmack? Utilizar uma linha longa de fibra óptica como um tipo de cache de nível 2 (L2) para o streaming de dados de IA, propondo uma alternativa ousada à tradicional DRAM (Dynamic Random-Access Memory). Parece ficção científica? Talvez, mas é uma ideia que merece ser explorada em profundidade, pois toca na essência dos desafios que a IA enfrenta hoje e nas soluções que podem moldar seu amanhã.

### Cache de Fibra Óptica: A Solução Inovadora de John Carmack para a Memória da IA

A proposta de John Carmack gira em torno de uma reinterpretação moderna de um conceito de computação mais antigo: a memória de linha de atraso. Imagine dados não como informações estáticas armazenadas em células, mas como pulsos de luz viajando por um tubo longo. Em vez de acessar uma posição específica em uma matriz de chips de silício, você estaria “capturando” dados à medida que eles passam por um circuito óptico, mantendo-os em trânsito e prontos para uso sequencial. Isso não é apenas uma ideia, é uma visão de como a física da luz pode ser empregada para otimizar o fluxo de informações, especialmente em cenários de streaming intensivo de dados, como os encontrados em aplicações avançadas de IA.

Para entender a relevância do **cache de fibra óptica**, precisamos primeiro contextualizar os desafios atuais da memória. Os sistemas de IA, especialmente aqueles que operam com modelos de linguagem grandes (LLMs), redes neurais profundas e processamento de dados em tempo real, exigem uma largura de banda de memória colossal. A DRAM, embora seja a espinha dorsal de nossos computadores modernos, está começando a mostrar seus limites. Ela consome muita energia, é limitada em sua velocidade de acesso e apresenta latência significativa quando se trata de mover grandes blocos de dados entre a memória principal e as unidades de processamento (GPUs, TPUs). Essa lacuna entre a capacidade de processamento e a capacidade de fornecer dados rapidamente é o que chamamos de “gargalo da memória” ou “wall of memory”. Carmack, com sua experiência de décadas otimizando cada byte e cada ciclo de clock, enxerga nesse gargalo uma oportunidade para uma abordagem radicalmente diferente.

### O Desafio da Memória na Era da Inteligência Artificial

A inteligência artificial moderna está sedenta por dados. Modelos de aprendizado de máquina, como as arquiteturas de transformadores que impulsionam os LLMs, podem ter bilhões ou até trilhões de parâmetros. Cada inferência ou etapa de treinamento envolve a leitura e gravação constantes desses parâmetros, além dos dados de entrada e saída. A velocidade com que esses dados podem ser acessados e transferidos impacta diretamente o desempenho e a eficiência energética dos sistemas de IA. É aqui que a memória DRAM, por mais avançada que seja, encontra seus obstáculos.

Os chips de DRAM operam em paralelo, mas sua arquitetura fundamental ainda implica em um tempo de acesso finito e um custo energético considerável para cada operação de leitura/escrita. Além disso, a capacidade de empacotar mais largura de banda em um chip de silício tradicional está se tornando cada vez mais difícil devido a leis da física e custos de fabricação. Isso leva a um cenário onde as unidades de processamento (GPUs, por exemplo) ficam esperando pelos dados, desperdiçando ciclos de clock valiosos e energia. Para aplicações de IA que processam fluxos contínuos de informações – pense em visão computacional em tempo real, processamento de linguagem natural ou jogos complexos – a capacidade de ter um “buffer” de dados de alta velocidade e baixa latência é crucial.

A ideia de um **cache de fibra óptica** é particularmente atraente para esses cenários de streaming. Em vez de depender de acessos aleatórios rápidos a uma vasta quantidade de dados em DRAM, que pode ser ineficiente para padrões sequenciais, a fibra óptica poderia manter um fluxo contínuo de dados “quentes” (frequentemente acessados) em movimento. Isso simula uma memória com acesso quase instantâneo para o próximo item na sequência, pois o dado já estaria “a caminho” e disponível quando necessário. É uma mudança de paradigma de armazenamento estático para um fluxo dinâmico, otimizado para as exigências específicas da IA moderna, onde a previsibilidade do fluxo de dados é, em muitos casos, tão importante quanto a capacidade total de armazenamento.

### Como o Conceito de Memória de Linha de Atraso se Reimagina com Lasers

A memória de linha de atraso não é um conceito novo. Na verdade, suas raízes remontam aos primórdios da computação, na década de 1940 e 1950, com o uso de tubos cheios de mercúrio ou fios de níquel. Nesses sistemas, pulsos de som ou elétricos eram enviados por um meio e se propagavam a uma velocidade conhecida, sendo lidos na outra extremidade e realimentados para a entrada para manter o “loop”. A duração do atraso era equivalente à capacidade de armazenamento. Era uma forma engenhosa de armazenar bits em série antes que a memória de acesso aleatório (RAM) se tornasse prática e acessível.

A ideia de Carmack, embora conceitualmente semelhante, eleva a memória de linha de atraso a um novo patamar utilizando a tecnologia moderna: lasers e fibras ópticas. Em vez de pulsos elétricos ou sonoros, teríamos pulsos de luz viajando por uma fibra. A luz, é claro, viaja a uma velocidade incrivelmente alta (embora um pouco mais lenta na fibra do que no vácuo). Uma longa linha de fibra atuaria como um laço, onde os dados seriam continuamente injetados, propagados e, eventualmente, detectados e consumidos pelos processadores de IA. A beleza disso reside na capacidade da fibra de transmitir informações com perdas mínimas e em altíssimas taxas de bits, potencialmente superando as limitações elétricas dos fios de cobre.

Um **cache de fibra óptica** operaria com base em princípios fotônicos, transformando sinais elétricos em luz na entrada e convertendo-os de volta em sinais elétricos na saída. Embora essa conversão E/O e O/E introduza uma certa latência e complexidade, a vantagem potencial na largura de banda e na distância de transmissão poderia compensar. Imagine um anel de fibra com quilômetros de comprimento enrolado em um pequeno volume, onde os dados de IA seriam mantidos em um “balé” contínuo de luz, sempre acessíveis para o processador quando chegassem ao ponto de leitura. Essa abordagem poderia aliviar a pressão sobre a DRAM, que ficaria encarregada apenas de dados que exigem acesso verdadeiramente aleatório e de baixa latência, enquanto a fibra cuidaria dos grandes fluxos sequenciais. Este conceito representa uma fusão fascinante de princípios de engenharia clássicos com as tecnologias de ponta em fotônica, uma área que está ganhando cada vez mais destaque na busca por soluções computacionais mais rápidas e eficientes.

### Implicações e o Futuro da Computação Óptica

A visão de John Carmack de um **cache de fibra óptica** não é apenas uma curiosidade tecnológica; ela aponta para uma tendência maior em hardware de IA e computação de alto desempenho: a crescente importância da fotônica e da computação óptica. À medida que os limites da eletrônica se aproximam, a luz oferece um novo meio para transmitir e, eventualmente, processar informações com velocidades e eficiências energéticas sem precedentes. A computação óptica promete revolucionar a forma como construímos computadores, desde interconexões ultrarrápidas entre chips até processadores que operam inteiramente com luz.

A implementação de um sistema como o que Carmack imagina enfrentaria desafios significativos. A conversão de elétrico para óptico e vice-versa, como mencionado, adiciona latência e consome energia, algo que precisaria ser otimizado para que a solução fosse viável. A integração dessa arquitetura com os designs de processadores existentes, seja em CPUs ou GPUs, exigiria uma reengenharia substancial. Além disso, a gestão do calor gerado pelos lasers e a complexidade de fabricar e manter esses sistemas seriam obstáculos a serem superados. No entanto, o histórico de Carmack nos mostra que ele não se intimida com desafios complexos; pelo contrário, ele os abraça.

Esta ideia pode não substituir a DRAM completamente, mas poderia funcionar como um complemento de alta capacidade e largura de banda para cenários específicos de IA, onde o streaming de dados é preponderante. Seria um novo nível na hierarquia de memória, otimizado para o “fluxo” em vez do “armazenamento estático”. Isso nos leva a pensar em arquiteturas de memória heterogêneas, onde diferentes tipos de memória são usados para diferentes propósitos, maximizando a eficiência de todo o sistema. A busca por soluções inovadoras para os desafios de memória e largura de banda é uma das frentes mais importantes na pesquisa em hardware de IA, e a contribuição de mentes como a de John Carmack é vital para empurrar essa fronteira.

A beleza da proposta de Carmack reside em sua simplicidade conceitual e na forma como ela aborda um problema fundamental de maneira não convencional. Não se trata apenas de tornar os chips de DRAM mais rápidos, mas de reimaginar completamente como os dados podem ser mantidos “vivos” e acessíveis para os processadores de IA. À medida que a IA se torna cada vez mais complexa e onipresente, a capacidade de inovar na arquitetura de hardware será tão crucial quanto os avanços nos algoritmos. É essa fusão de hardware e software, tão cara a Carmack, que pavimentará o caminho para a próxima geração de inteligência artificial.

### Conclusão: Um Olhar para o Futuro Impulsionado pela Inovação

A visão de John Carmack de utilizar um **cache de fibra óptica** para o streaming de dados em IA é um lembrete contundente de que, mesmo nos campos mais estabelecidos da computação, ainda há espaço para a inovação disruptiva. Em um momento em que a inteligência artificial exige cada vez mais dos nossos sistemas de hardware, pensar fora da caixa, ou melhor, fora do chip de silício tradicional, é essencial. A memória de linha de atraso, um conceito quase esquecido, ressuscita com uma roupagem fotônica, oferecendo uma solução potencial para os desafios de largura de banda e latência que a DRAM convencional luta para superar.

Embora a transição da ideia para a implementação prática envolva inúmeros obstáculos técnicos e econômicos, a simples provocação de uma mente como a de Carmack já serve como um catalisador. Ela nos força a questionar os paradigmas atuais e a explorar as possibilidades que a computação óptica e a engenharia de materiais avançada podem oferecer. O futuro da IA não residirá apenas em algoritmos mais inteligentes, mas também em arquiteturas de hardware que consigam alimentar esses algoritmos com dados na velocidade da luz. A jornada para construir a próxima geração de inteligência artificial será pavimentada por essas ideias ousadas, e John Carmack, como sempre, está na vanguarda, iluminando o caminho com um feixe de luz.

Share this content:

Publicar comentário