O Acordo Bilionário Meta-Nvidia: Desvendando a Corrida pelos Chips de IA na Era da Inteligência Artificial

A Inteligência Artificial (IA) deixou de ser um conceito futurista para se tornar a espinha dorsal de muitas das tecnologias que usamos diariamente. De algoritmos de recomendação a carros autônomos e assistentes virtuais, a IA está redefinindo o nosso mundo. No coração dessa revolução, reside uma batalha feroz e bilionária pelo hardware que a sustenta: os **chips de IA**. Recentemente, um acordo de múltiplos bilhões de dólares entre gigantes como Meta e Nvidia veio à tona, evidenciando não apenas a demanda explosiva por esses semicondutores avançados, mas também a complexa dinâmica de um mercado em constante efervescência. Este pacto, no qual o grupo de mídias sociais adquirirá milhões de chips da Nvidia, mesmo enquanto intensifica seus próprios esforços para desenvolver hardware de IA, é um espelho das ambições e desafios que moldam o futuro da inteligência artificial.

Para o público brasileiro, essa notícia não é apenas um burburinho distante do Vale do Silício. Ela ressoa diretamente na forma como interagimos com nossas redes sociais, como consumimos conteúdo e até mesmo como as empresas locais podem, no futuro, implementar soluções de IA. Compreender a lógica por trás de investimentos tão maciços e a estratégia de empresas como a Meta é fundamental para desmistificar a IA e entender seu impacto real em nosso cotidiano. Prepare-se para mergulhar em um cenário de inovação, competição acirrada e a incessante busca pelo poder computacional que impulsiona a próxima fronteira tecnológica.

A Revolução dos Chips de IA: Por Que a Nvidia Continua na Vanguarda?

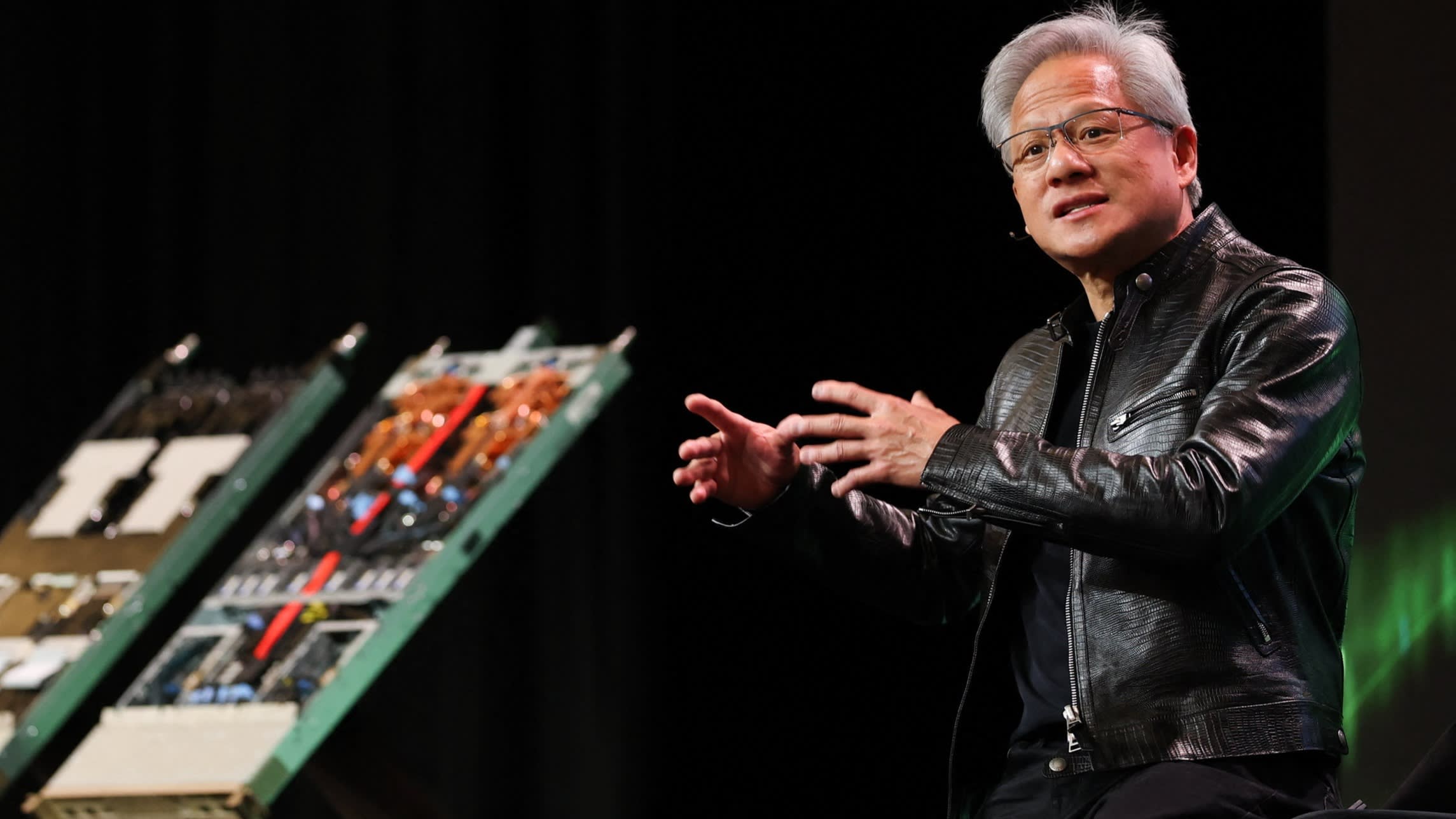

Quando falamos em chips de IA, é quase impossível não mencionar a Nvidia. A empresa, liderada por Jensen Huang, consolidou-se como a rainha indiscutível do hardware de inteligência artificial. Mas qual é o segredo desse reinado? A resposta reside em uma combinação de visão estratégica, inovação contínua e, claro, um ecossistema robusto. Nos anos 2000, enquanto outras fabricantes focavam em chips para computação de uso geral, a Nvidia investiu pesado em Unidades de Processamento Gráfico (GPUs), percebendo seu potencial para processamento paralelo, essencial para gráficos 3D. Mal sabiam que essa mesma arquitetura seria perfeitamente adequada para as demandas dos modelos de redes neurais, que são a base da IA moderna.

O verdadeiro divisor de águas foi o desenvolvimento da plataforma CUDA (Compute Unified Device Architecture). Lançada em 2007, a CUDA é uma plataforma de computação paralela e um modelo de programação que permite aos desenvolvedores usar as GPUs da Nvidia para computação de propósito geral, não apenas para gráficos. Isso transformou as GPUs em ‘cérebros’ programáveis para IA. Cientistas e pesquisadores logo descobriram que as GPUs da Nvidia podiam acelerar exponencialmente o treinamento de modelos de deep learning, reduzindo semanas de computação para dias ou até horas. Desde então, a empresa tem lançado gerações de GPUs otimizadas para IA, como as linhas A100 e, mais recentemente, a H100 (baseada na arquitetura Hopper) e a futura Blackwell, que prometem saltos gigantescos em performance e eficiência energética.

A demanda por esses processadores é insaciável. Grandes empresas de tecnologia, universidades e startups de IA competem fervorosamente por cada unidade. A capacidade da Nvidia de inovar rapidamente e de manter um ecossistema de software maduro e amplamente adotado, que inclui bibliotecas como cuDNN e ferramentas de desenvolvimento, criou uma barreira de entrada significativa para seus concorrentes. Para empresas como a Meta, que operam em escala global e dependem fundamentalmente da IA para aprimorar a experiência do usuário, moderar conteúdo e desenvolver novas fronteiras como o metaverso, ter acesso a esses **chips de IA** de ponta é uma necessidade estratégica, justificando investimentos que chegam à casa dos bilhões de dólares.

Meta e a Dupla Estratégia: Comprar e Construir no Universo da Inteligência Artificial

O acordo multimilionário da Meta com a Nvidia não é apenas um testemunho da dominância da Nvidia; é também um reflexo da complexa e multifacetada estratégia de IA da Meta. Por um lado, a empresa de Mark Zuckerberg é um dos maiores consumidores de poder computacional do planeta. Suas plataformas – Facebook, Instagram, WhatsApp, Threads – dependem de algoritmos de IA para tudo: desde a personalização do feed de notícias e a recomendação de amigos e produtos, até a detecção e remoção de conteúdo prejudicial e a otimização de anúncios. Cada curtida, cada compartilhamento, cada interação gera dados que alimentam modelos de IA massivos, como o Llama, seu Large Language Model de código aberto, que exige uma capacidade de treinamento e inferência colossal.

Para suportar essa demanda imediata e crescente, a Meta não pode se dar ao luxo de esperar. Ela precisa dos melhores e mais poderosos **chips de IA** disponíveis agora, e a Nvidia é a fornecedora comprovada. Comprar milhões de GPUs H100, por exemplo, é uma forma de garantir que sua infraestrutura de IA permaneça na vanguarda, permitindo que seus engenheiros continuem a inovar e aprimorar os serviços que bilhões de pessoas usam diariamente. É uma aposta pragmática na excelência e na confiabilidade.

No entanto, a estratégia da Meta vai além da simples compra. A empresa está investindo pesadamente no desenvolvimento de seu próprio hardware de IA, como o MTIA (Meta Training and Inference Accelerator). Há várias razões convincentes para essa abordagem de “comprar e construir”. Primeiramente, a personalização. Chips desenvolvidos internamente podem ser otimizados especificamente para as cargas de trabalho de IA da Meta, garantindo maior eficiência e performance para seus algoritmos exclusivos. Em segundo lugar, a independência estratégica. A dependência de um único fornecedor, por mais competente que seja, acarreta riscos, incluindo flutuações de preço, interrupções na cadeia de suprimentos e até mesmo a exposição a estratégias de produto que podem não se alinhar perfeitamente com os objetivos da Meta.

Além disso, a economia de escala é um fator crucial. À medida que o uso de IA cresce exponencialmente, o custo de adquirir milhões de chips de terceiros se torna proibitivo. Desenvolver um chip próprio, uma vez que o investimento inicial em P&D é superado, pode levar a uma significativa redução de custos a longo prazo e a um maior controle sobre a inovação e o design. Essa dualidade – comprar para atender às necessidades urgentes e construir para garantir a autonomia e a otimização futura – é uma tendência que vemos em outras grandes empresas de tecnologia, como Google com seus TPUs (Tensor Processing Units) e Amazon com suas Inferentia e Trainium. É um jogo de alto risco e alta recompensa, mas essencial para quem busca liderar a próxima era da inteligência artificial.

A Guerra dos Chips: Outros Gigantes no Ringue e o Futuro do Hardware de IA

Embora a Nvidia ocupe a pole position, a corrida pelos **chips de IA** está longe de ser um monopólio. O mercado é um campo de batalha intenso, com outros gigantes da tecnologia e startups inovadoras buscando abocanhar uma fatia crescente desse setor vital. A AMD, rival histórica da Nvidia no mercado de GPUs, tem intensificado seus esforços com a linha Instinct de aceleradores de IA, projetados para competir diretamente com as ofertas da Nvidia. A empresa está investindo em sua própria plataforma de software, ROCm, para tentar romper a dominância do CUDA, embora seja um desafio considerável dada a ampla adoção e maturidade do ecossistema da Nvidia.

A Intel, por sua vez, também está determinada a ser um player significativo. Com a aquisição da Habana Labs e seus aceleradores Gaudi, a Intel busca oferecer alternativas competitivas para treinamento e inferência de IA. Além disso, a Intel tem o benefício de ser uma fabricante de semicondutores integrada, com suas próprias fábricas (fabs), o que lhe confere um certo controle sobre a produção, um ativo valioso em tempos de escassez global de chips. No entanto, sua jornada tem sido marcada por desafios e a necessidade de recuperar terreno.

Os próprios gigantes da nuvem também estão na linha de frente. Google com seus TPUs, que já estão em sua quinta geração, são amplamente utilizados internamente para impulsionar seus próprios serviços de IA e são oferecidos como parte de sua plataforma Google Cloud. A Amazon Web Services (AWS) desenvolveu os chips Inferentia para inferência de IA e Trainium para treinamento de modelos, permitindo que seus clientes executem cargas de trabalho de IA de forma mais eficiente e econômica em sua infraestrutura de nuvem. Essas iniciativas de hardware personalizado demonstram a percepção de que o controle sobre o silício é uma vantagem estratégica crucial para oferecer serviços de IA diferenciados e otimizados.

O futuro do hardware de IA é dinâmico e multifacetado. Espera-se uma contínua evolução das arquiteturas, com foco não apenas no aumento da performance bruta, mas também na eficiência energética, crucial para data centers que consomem quantidades crescentes de eletricidade para alimentar modelos de IA cada vez maiores. A modularidade, a escalabilidade e a capacidade de lidar com diferentes tipos de modelos de IA – de redes neurais convolucionais a transformadores complexos – serão aspectos chave. Além disso, a computação quântica e a computação neuromórfica (inspirada no cérebro humano) representam horizontes de pesquisa que podem, no longo prazo, redefinir completamente a forma como processamos a inteligência artificial, abrindo portas para novas classes de **chips de IA** e paradigmas computacionais.

Nesse cenário de inovação constante, a colaboração e a competição coexistirão. Empresas como a Meta continuarão a buscar o que há de melhor no mercado enquanto investem em soluções personalizadas, impulsionando tanto a Nvidia quanto seus próprios times de engenharia a novos patamares. O acesso a uma infraestrutura de IA robusta e flexível não é apenas uma questão tecnológica, mas uma vantagem competitiva fundamental na era digital. Quem tiver os melhores chips e souber como utilizá-los de forma mais eficaz, terá uma posição privilegiada na construção do futuro da Inteligência Artificial.

Em suma, o acordo bilionário entre Meta e Nvidia é muito mais do que uma transação comercial; é um termômetro da febre da Inteligência Artificial e da corrida global para dominar seu hardware subjacente. Ele sublinha a importância crítica dos chips de IA como os novos ‘minerais preciosos’ da economia digital, essenciais para alimentar os avanços que moldam nossa experiência online e além. A estratégia da Meta, de comprar milhões de chips da Nvidia enquanto desenvolve seu próprio silício, ilustra perfeitamente a complexidade e a urgência de se manter competitivo neste cenário em rápida evolução. Estamos testemunhando o nascimento de uma nova era, onde o poder do silício e a engenhosidade do software se unem para desvendar o potencial ilimitado da inteligência artificial.

Para o Brasil e para o mundo, essa corrida por chips de IA significa que estamos em uma trajetória acelerada de inovação. Novas aplicações de IA surgirão, redefinindo setores inteiros, da saúde ao agronegócio, da educação ao entretenimento. Estar atento a esses desenvolvimentos não é apenas acompanhar as notícias, mas sim entender as fundações sobre as quais o nosso futuro digital está sendo construído. É um convite para refletir sobre como podemos participar ativamente dessa transformação, seja como desenvolvedores, empreendedores ou usuários conscientes, garantindo que os benefícios dessa tecnologia sejam amplos e inclusivos.

Share this content:

Publicar comentário