A Verdade por Trás da OpenAI: O Que Elon Musk Deixou de Contar

A inteligência artificial (IA) é, sem dúvida, um dos temas mais quentes e impactantes da nossa era. De assistentes virtuais a sistemas complexos de reconhecimento de padrões, a IA está redefinindo o que é possível. No centro dessa revolução, a OpenAI, a empresa por trás do ChatGPT e DALL-E, emergiu como um gigante. Mas a sua história, especialmente a sua gênese e evolução, é mais complexa do que muitos imaginam, e as recentes disputas legais trouxeram à tona narrativas conflitantes.

Recentemente, Elon Musk, uma figura proeminente no cenário tecnológico e um dos cofundadores da OpenAI, entrou com um processo contra a empresa, alegando que ela se desviou de sua missão original sem fins lucrativos. No entanto, a “verdade” em qualquer disputa raramente é unilateral, e os documentos e e-mails que vieram à tona em resposta ao processo de Musk pintam um quadro mais matizado – revelando aspectos que, convenientemente, foram deixados de fora de sua petição judicial. Vamos mergulhar na história e desvendar A Verdade sobre a OpenAI, desde seus ideais altruístas até os desafios pragmáticos de construir o futuro da IA.

A Verdade sobre a OpenAI: A Gênese Idealista e a Missão Altruísta

Em 2015, a fundação da OpenAI foi um marco ambicioso. Nomes como Elon Musk, Sam Altman, Greg Brockman, Ilya Sutskever, Wojciech Zaremba e John Schulman uniram forças com um objetivo singular, e audacioso: desenvolver a inteligência artificial geral (AGI) de forma segura e para o benefício de toda a humanidade, não apenas de alguns. Naquela época, havia uma crescente preocupação de que gigantes da tecnologia, como Google e Facebook, pudessem monopolizar o desenvolvimento da IA, criando sistemas poderosos sem a devida supervisão ou consideração pelos riscos sociais. A OpenAI nasceu como um contrapeso, uma força para democratizar o acesso à IA avançada e garantir que seu poder fosse distribuído de forma equitativa.

A visão original era utópica em sua essência. A organização foi estabelecida como uma entidade sem fins lucrativos, com a promessa de que suas pesquisas e tecnologias seriam “abertas” – daí o nome “OpenAI” – para que a comunidade global pudesse inspecionar, aprender e contribuir para o seu desenvolvimento. O objetivo era prevenir cenários distópicos onde a IA pudesse ser usada para ganho privado ou, pior ainda, para controle. Elon Musk, um dos principais doadores e o primeiro CEO, investiu dezenas de milhões de dólares e trouxe sua reputação de visionário, com uma convicção expressa de que a AGI era poderosa demais para ser controlada por uma única entidade com fins lucrativos. Ele acreditava firmemente que a IA deveria ser uma ferramenta para elevar a civilização, não para enriquecer corporações.

Os primeiros anos da OpenAI foram marcados por um espírito de colaboração e pesquisa pura. Cientistas e engenheiros renomados foram atraídos pela missão, trabalhando em projetos inovadores que impulsionariam a fronteira da IA. A comunidade esperava que a organização estabeleceria um precedente para o desenvolvimento ético e transparente da tecnologia mais transformadora da história. No entanto, a realidade do custo astronômico de pesquisa e desenvolvimento em IA logo começaria a desafiar essa visão idealista.

A Reviravolta Lucrativa: Do Idealismo ao Pragmatismo com a Microsoft

A medida que a pesquisa em inteligência artificial avançava, especialmente no campo do aprendizado de máquina e redes neurais profundas, os custos envolvidos escalaram exponencialmente. Treinar modelos de IA de ponta exige uma quantidade colossal de poder computacional, o que se traduz em milhões de dólares em hardware e eletricidade. Além disso, para atrair e reter os melhores talentos em um mercado competitivo dominado por empresas como Google e Meta, a OpenAI precisava de recursos que uma estrutura puramente sem fins lucrativos não conseguia sustentar. Os salários dos principais pesquisadores em IA podem facilmente chegar a sete dígitos anuais, e a batalha por esses profissionais é acirrada.

Foi nesse contexto que, em 2018, Elon Musk deixou o conselho da OpenAI. Em documentos subsequentes, a OpenAI alegou que Musk havia proposto que a empresa se tornasse uma entidade com fins lucrativos sob seu controle majoritário, algo que não se alinhava com a visão dos outros fundadores de uma organização mais distribuída e focada na missão. Com a saída de Musk e a crescente necessidade de capital, a liderança da OpenAI, incluindo Sam Altman, tomou uma decisão pragmática e controversa em 2019: criar uma nova entidade, a OpenAI LP, com uma estrutura de “lucro limitado” (capped-profit). Essa estrutura permitia que a empresa levantasse bilhões de dólares em investimentos, mas com um limite nos retornos que os investidores poderiam receber, mantendo parte do espírito original de que o lucro não seria o objetivo final e ilimitado.

Essa mudança foi crucial e abriu as portas para uma parceria estratégica com a Microsoft. A Microsoft investiu bilhões de dólares na OpenAI, fornecendo não apenas capital, mas também acesso a seus vastos recursos de computação em nuvem (Azure), que se tornaram a espinha dorsal para o treinamento de modelos massivos como o GPT-3 e, posteriormente, o ChatGPT. Essa colaboração permitiu que a OpenAI alcançasse feitos que seriam impossíveis como uma pequena organização sem fins lucrativos. O ChatGPT, lançado em 2022, não só demonstrou o poder transformador da IA generativa para milhões de pessoas, mas também validou o modelo de negócios híbrido da OpenAI, provando que o investimento em pesquisa de ponta pode levar a produtos de sucesso que impactam o mundo.

A parceria com a Microsoft, embora vital para o crescimento da OpenAI, também se tornou um dos pontos centrais da disputa de Elon Musk. Ele argumenta que essa parceria transformou a OpenAI em uma “subsidiária de fato” da Microsoft, traindo sua missão original de ser uma organização independente sem fins lucrativos. No entanto, a OpenAI defende que essa colaboração foi uma necessidade estratégica para cumprir sua missão de forma eficaz, dadas as realidades financeiras e tecnológicas do desenvolvimento da AGI.

O Processo de Elon Musk e os Desafios da AGI Segura

O processo legal movido por Elon Musk em março de 2024 contra a OpenAI, Sam Altman e Greg Brockman é um capítulo intrigante na saga da empresa. Musk alega uma “violação de contrato” e uma “traição à missão fundacional”, afirmando que a OpenAI abandonou seu compromisso de desenvolver a AGI para o benefício da humanidade, priorizando o lucro e a colaboração com a Microsoft. Ele argumenta que o modelo de “código fechado” adotado para muitos dos avanços da OpenAI é antitético à sua promessa de ser “aberta”.

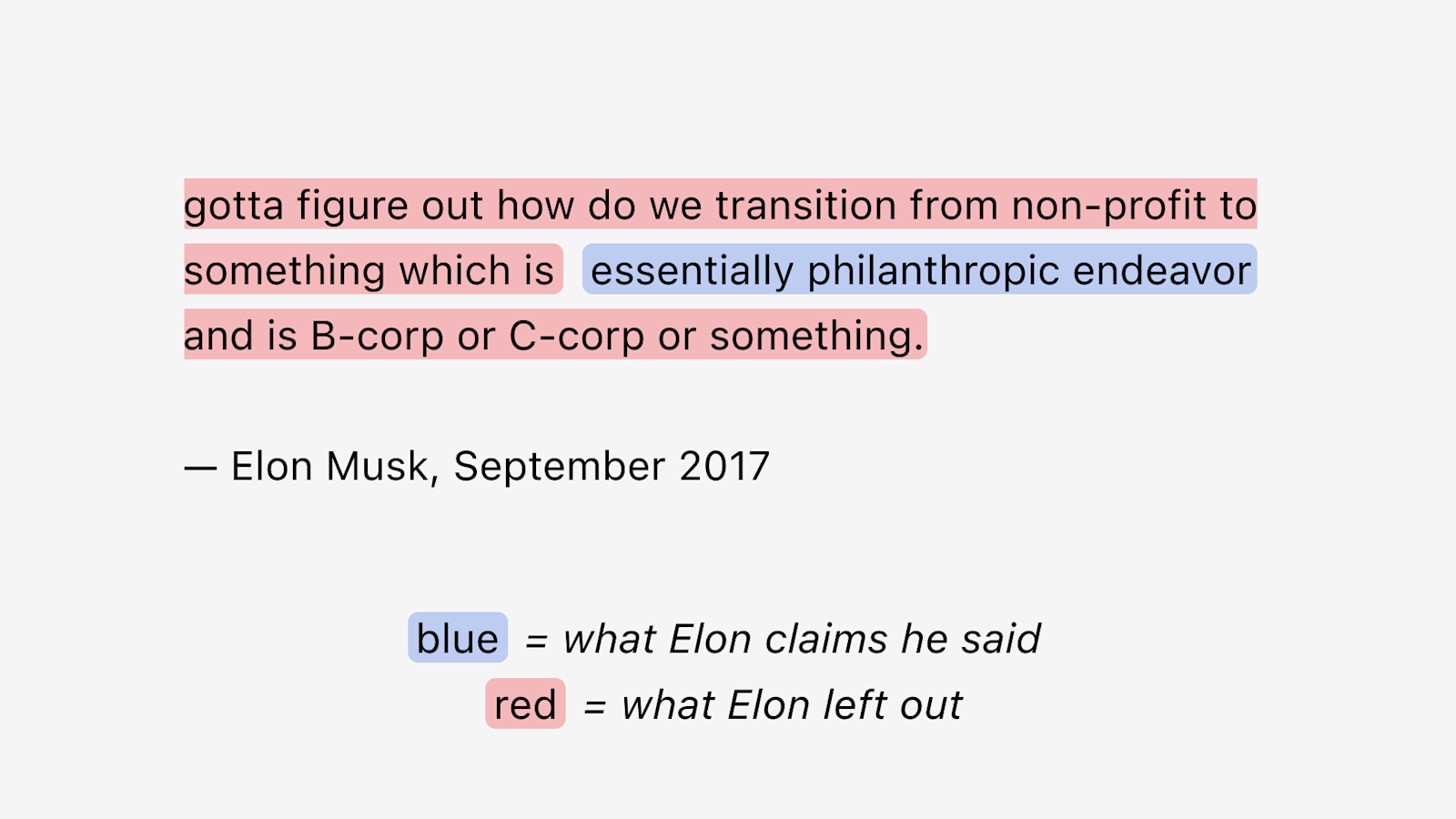

No entanto, a resposta da OpenAI trouxe à tona e-mails e conversas que sugerem que as próprias visões de Musk sobre a estrutura e o financiamento da organização eram fluidas e, por vezes, contraditórias ao seu discurso atual. A OpenAI divulgou comunicações internas que indicam que Musk, em vários momentos, propôs a fusão da OpenAI com a Tesla, a obtenção de uma participação majoritária na OpenAI, e até mesmo a criação de uma entidade com fins lucrativos muito antes da formação da OpenAI LP em 2019. Essas revelações são o cerne da “verdade que Elon deixou de fora” – uma narrativa que sugere que o desejo de comercialização e o reconhecimento dos desafios financeiros não eram estranhos ao próprio Musk.

Este embate legal não é apenas sobre dinheiro ou controle; ele toca em questões fundamentais sobre o futuro da inteligência artificial. Como podemos garantir que a AGI, uma vez alcançada, seja desenvolvida e utilizada de forma ética e segura? Quem deve ter o controle sobre essa tecnologia transformadora? A tensão entre o desenvolvimento “aberto” versus “fechado” é central. Embora a OpenAI tenha mantido algumas de suas pesquisas abertas, a natureza competitiva e os riscos de uso indevido de modelos superinteligentes levaram a uma abordagem mais cautelosa em relação à abertura total de alguns de seus sistemas mais avançados.

A preocupação com a segurança da IA é um tema legítimo e amplamente discutido na comunidade. A ideia de que a AGI deve ser desenvolvida com extrema cautela, com mecanismos de segurança robustos e princípios éticos claros, é compartilhada por muitos, incluindo a própria OpenAI e até mesmo Musk. O desafio é como equilibrar essa cautela com a pressão incessante por inovação e o custo proibitivo de pesquisa em grande escala. O caso Musk vs. OpenAI serve como um lembrete contundente das complexidades envolvidas na governança da IA e na busca por um equilíbrio entre idealismo, pragmatismo e responsabilidade.

O Futuro da Inteligência Artificial: Entre o Lucro e o Propósito

A disputa entre Elon Musk e a OpenAI transcende as questões legais e financeiras, colocando em evidência um debate maior sobre o futuro da inteligência artificial. O que significa desenvolver a AGI “para o benefício da humanidade” em um mundo movido por interesses comerciais e pressões competitivas? A ascensão da IA generativa, exemplificada pelo sucesso do ChatGPT, demonstra o imenso potencial da tecnologia para revolucionar indústrias, aprimorar a educação e até mesmo democratizar o acesso ao conhecimento. No entanto, também levanta sérias preocupações sobre desinformação, vieses algorítmicos e o impacto no mercado de trabalho.

Empresas como a OpenAI, o Google DeepMind e a Anthropic estão na vanguarda dessa corrida tecnológica. Cada uma delas enfrenta o dilema de como financiar a pesquisa intensiva em IA enquanto adere a princípios éticos e de segurança. A abordagem de “lucro limitado” da OpenAI foi uma tentativa de navegar por esse terreno complexo, permitindo o investimento massivo necessário para a AGI sem ceder totalmente aos imperativos do lucro ilimitado. É uma experiência em andamento, e seu sucesso ou fracasso terá implicações duradouras para o modelo de desenvolvimento da IA.

O debate sobre a abertura da IA também é crucial. Enquanto Musk defende um desenvolvimento de código aberto, a OpenAI e outros argumentam que modelos extremamente poderosos podem representar riscos de segurança se forem totalmente abertos sem salvaguardas adequadas. A inteligência artificial, em sua forma mais avançada, pode ter capacidades imprevisíveis, e a responsabilidade de gerenciar seu desenvolvimento é colossal. A colaboração entre o setor privado, governos e a academia será essencial para estabelecer diretrizes e regulamentações que garantam que a IA seja desenvolvida de forma segura, transparente e em alinhamento com os valores humanos.

O episódio recente com Elon Musk sublinha que, para além da tecnologia em si, a governança e a filosofia por trás das organizações que a desenvolvem são tão importantes quanto os algoritmos. O público, os reguladores e os próprios desenvolvedores de IA têm um papel a desempenhar na moldagem desse futuro. A transparência sobre as intenções, os modelos de negócios e as abordagens de segurança será cada vez mais vital para construir a confiança e garantir que a IA sirva genuinamente ao propósito de melhorar a vida humana.

Conclusão: Um Olhar Abrangente sobre a IA e Seus Dilemas

A história da OpenAI é um microcosmo dos dilemas enfrentados por toda a indústria de inteligência artificial. Começando com uma visão nobre de desenvolver a AGI para o bem da humanidade, a organização teve que se adaptar às duras realidades financeiras e competitivas do setor. A transição para um modelo de “lucro limitado” e a parceria com a Microsoft, embora controversas, foram passos pragmáticos que permitiram à OpenAI atingir o nível de inovação que vemos hoje, com produtos como o ChatGPT transformando o cenário tecnológico global.

A “verdade que Elon deixou de fora” nos lembra que as narrativas são frequentemente mais complexas do que parecem. A evolução de uma empresa, especialmente uma tão ambiciosa quanto a OpenAI, é um caminho sinuoso, repleto de compromissos e decisões difíceis. O processo de Elon Musk, independentemente de seu resultado, já serve como um catalisador para uma discussão muito necessária sobre a ética, a governança e o propósito da inteligência artificial. É um lembrete de que, enquanto construímos o futuro com a IA, devemos estar vigilantes para garantir que os ideais iniciais de benefício humano não se percam em meio à busca por inovação e lucro. O debate sobre como a IA deve ser desenvolvida – aberta ou fechada, com fins lucrativos ou sem fins lucrativos – continuará a moldar o nosso futuro digital.

Share this content:

Publicar comentário