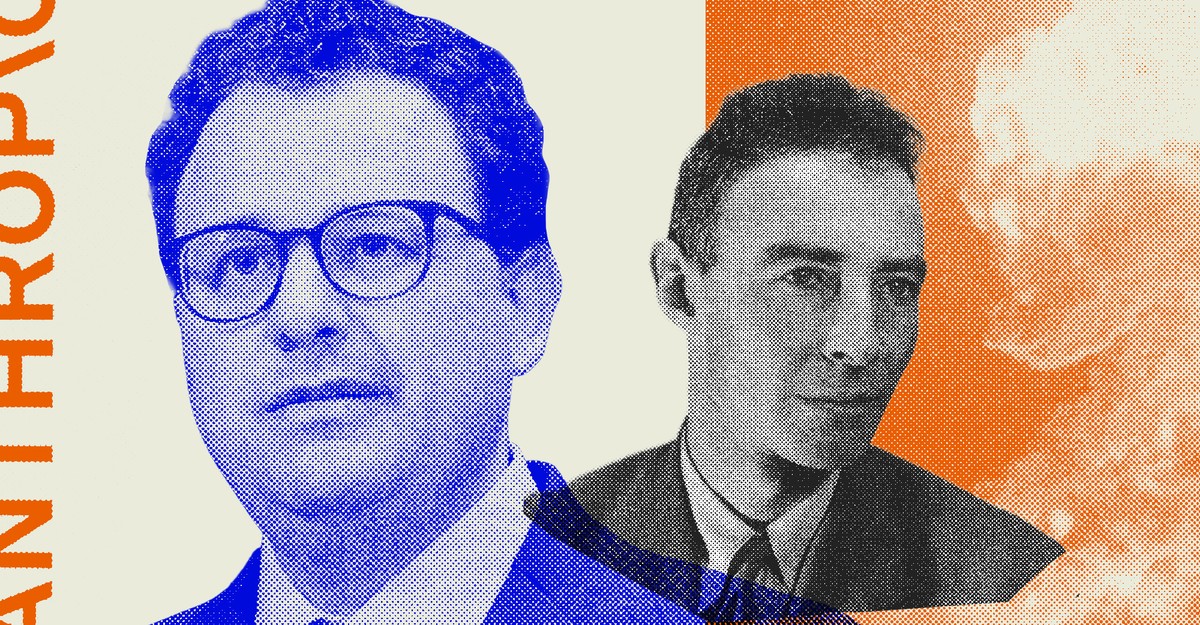

Dario Amodei e a Anthropic: A Dissonância entre o Ideal e a Realidade da IA

A Inteligência Artificial (IA) é, sem dúvida, a tecnologia definidora de nossa era. Com avanços que parecem surgir de um futuro que imaginávamos distante, somos constantemente confrontados com inovações que redefinem o que é possível. Nesse cenário de efervescência tecnológica, surgem empresas com missões grandiosas, e a Anthropic, cofundada pelo renomado Dario Amodei, é um desses nomes. Criada sob o estandarte da responsabilidade e do alinhamento da IA com os valores humanos, a Anthropic propõe um caminho mais seguro para o desenvolvimento da inteligência artificial geral (AGI).

No entanto, a realidade do progresso tecnológico muitas vezes impõe dilemas complexos. A frase “Chegou antes do esperado” ecoa como um lembrete vívido da velocidade estonteante com que a IA avança, muitas vezes superando as próprias expectativas dos especialistas mais otimistas. Essa aceleração cria uma tensão inerente entre os ideais de segurança e ética e as pressões do desenvolvimento, da concorrência e até mesmo de parcerias estratégicas. É essa dissonância, entre a visão utópica e as exigências pragmáticas do mundo real, que exploraremos ao mergulhar na jornada de Dario Amodei e da Anthropic.

Segurança da IA: A Missão Ambiciosa da Anthropic e o Desafio da Realidade

A história da Anthropic é intrinsecamente ligada à busca por uma IA mais segura. Fundada em 2021 por ex-membros da OpenAI, incluindo Dario Amodei, Daniela Amodei e outros, a empresa nasceu de uma preocupação genuína com os rumos da inteligência artificial. Enquanto a corrida para construir sistemas cada vez mais potentes ganhava tração, Amodei e sua equipe sentiam que a segurança e o alinhamento com a humanidade precisavam ser prioridade máxima, não um item secundário. A visão era criar uma IA que não apenas fosse inteligente, mas que também fosse benéfica, confiável e, acima de tudo, segura para a sociedade.

Para isso, a Anthropic desenvolveu abordagens inovadoras como a “Constitutional AI” (IA Constitucional). Diferente dos métodos tradicionais de treinamento que dependem de feedback humano extensivo para guiar o comportamento de um modelo (RLHF – Reinforcement Learning from Human Feedback), a IA Constitucional utiliza um conjunto de princípios e regras, ou uma “constituição”, para auto-supervisionar e corrigir o próprio modelo. Imagine um sistema que não apenas aprende com os dados, mas também com um conjunto de leis éticas predefinidas, evitando assim saídas prejudiciais, enviesadas ou perigosas. Essa metodologia visa infundir nos modelos de IA um senso intrínseco de responsabilidade e alinhamento, reduzindo a dependência de intervenções humanas constantes e escalonando a segurança em sistemas cada vez mais complexos.

O foco em métodos como o Red Teaming — que envolve equipes dedicadas a encontrar falhas e vulnerabilidades nos modelos de IA antes que sejam liberados ao público — demonstra o compromisso da Anthropic com a robustez e a resiliência de seus sistemas. Eles entendem que, com o poder crescente da IA, o potencial para usos indevidos ou consequências não intencionais também aumenta exponencialmente. Por isso, a empresa investe pesado em pesquisa de interpretabilidade, buscando entender como e por que os modelos tomam certas decisões, o que é crucial para garantir a confiança e o controle sobre essas tecnologias.

Contudo, por mais nobres que sejam esses princípios, a realidade do desenvolvimento de IA em escala global apresenta desafios monumentais. A necessidade de capital, a atração dos melhores talentos e a pressão para se manter competitivo em um campo que muda a cada dia são fatores que podem testar a resiliência de qualquer ideal. A busca por parceiros estratégicos, incluindo entidades governamentais ou militares, muitas vezes se torna uma necessidade para financiar e escalar as operações, gerando um debate sobre até que ponto essas colaborações podem se alinhar com a missão original de segurança da IA e uso ético.

O Ritmo Acelerado da Inovação: “Chegou Antes do Esperado”

A frase enigmática “Chegou antes do esperado” sintetiza um dos maiores dilemas da era da IA: a velocidade vertiginosa com que a tecnologia está avançando. Não é apenas a comunidade tecnológica que está surpresa, mas até mesmo os próprios arquitetos e visionários da IA, como Dario Amodei, reconhecem que o progresso está superando as previsões mais audaciosas. Modelos de linguagem se tornam mais proficientes em tarefas complexas, geradores de imagem criam obras de arte hiper-realistas e sistemas de IA começam a demonstrar habilidades de raciocínio e síntese que antes eram consideradas exclusivas da inteligência humana. Essa aceleração tem implicações profundas.

Primeiramente, ela encurta o tempo disponível para reflexão ética, formulação de políticas e implementação de salvaguardas. Enquanto legisladores e reguladores debatem sobre como governar a IA, a tecnologia já avançou para um novo patamar, tornando as regulamentações propostas potencialmente obsoletas antes mesmo de serem promulgadas. A complexidade dos novos modelos torna a auditoria e a explicação de seu funcionamento um desafio cada vez maior, levantando questões sobre responsabilidade e transparência. Como podemos garantir que uma IA está operando de forma justa e segura se nem mesmo seus criadores conseguem compreender totalmente todos os seus mecanismos internos?

Além disso, o rápido avanço intensifica a “corrida armamentista” da IA. Países e grandes empresas globais veem a IA não apenas como uma ferramenta de progresso econômico, mas também como um componente crucial de segurança nacional e poder geopolítico. Ninguém quer ficar para trás, e essa mentalidade competitiva pode, por vezes, priorizar a velocidade de desenvolvimento em detrimento de uma abordagem mais cautelosa e focada em segurança. O medo de perder a dianteira tecnológica pode levar a atalhos éticos e a uma minimização dos riscos potenciais, o que vai diretamente contra os princípios da Anthropic.

O impacto na sociedade também é imenso. Vemos a IA sendo integrada em diversos setores, desde a saúde e finanças até a educação e o entretenimento. Cada nova capacidade, como a geração de conteúdo convincente ou a personalização extrema de experiências, traz consigo tanto benefícios transformadores quanto riscos significativos, como a disseminação de desinformação, a automação de empregos e o aumento da polarização. A frase “Chegou antes do esperado” não é apenas uma constatação técnica; é um alerta social, que nos força a questionar se estamos preparados, como sociedade, para as mudanças que a IA já está nos impondo.

Entre a Ética e o Pragmatismo: O Papel da Anthropic no Cenário Geopolítico

A missão de desenvolver uma IA segura e benéfica, por mais nobre que seja, colide inevitavelmente com as realidades financeiras e geopolíticas. Construir e treinar modelos de IA de ponta exige recursos computacionais massivos, equipes de engenheiros e pesquisadores de alto nível e um investimento financeiro que pode chegar a centenas de milhões, senão bilhões, de dólares. Para uma empresa como a Anthropic, mesmo com uma visão clara, a obtenção desse capital é uma questão de sobrevivência e de capacidade de competir com gigantes como Google, Microsoft e OpenAI.

É nesse contexto que as parcerias estratégicas se tornam cruciais. A notícia (ainda que hipotética na data original do artigo referenciado de 2026) de uma possível colaboração entre a Anthropic e o Departamento de Defesa dos EUA, por exemplo, destaca a complexidade desse dilema. Por um lado, tal parceria poderia fornecer os recursos e a escala necessários para a pesquisa e o desenvolvimento de IA segura, além de potencialmente influenciar o uso responsável da IA em um setor tão crítico. Por outro lado, levanta questões éticas profundas para uma empresa nascida com a premissa de prevenir danos e garantir o alinhamento humano. Como conciliar a criação de uma IA para fins potencialmente militares com a visão de uma tecnologia que serve a toda a humanidade de forma benéfica?

Essa tensão reflete a natureza de “duplo uso” da tecnologia de IA. Uma mesma capacidade, como a visão computacional ou o processamento de linguagem natural, pode ser usada para diagnósticos médicos, educação, mas também para vigilância, armas autônomas ou operações de informação. Empresas como a Anthropic se veem na difícil posição de tentar guiar o uso de suas criações para o bem, enquanto o mundo ao seu redor busca aplicar essas tecnologias para diversos fins, incluindo aqueles que podem ir de encontro aos seus valores fundacionais. A pressão não vem apenas de governos; vem também do setor privado, de investidores que buscam retornos e de uma competição acirrada para ser o primeiro a alcançar certos marcos tecnológicos.

Dario Amodei e outros líderes da Anthropic estão, portanto, navegando em um campo minado ético e estratégico. Sua capacidade de manter a integridade de sua missão enquanto garantem a viabilidade e o crescimento da empresa é um teste crucial para o futuro da IA. As escolhas que fizerem – sobre parcerias, sobre a abertura de seus modelos, sobre as salvaguardas que implementam – não afetarão apenas a Anthropic, mas poderão moldar o panorama global da inteligência artificial para as próximas décadas, influenciando como a sociedade percebe e interage com essa força transformadora. A busca pela segurança da IA não é apenas tecnológica; é, antes de tudo, uma jornada ética e política.

O Futuro da Inteligência Artificial: Navegando pelas Águas Turbulentas da Responsabilidade

A jornada da Anthropic e de seu CEO, Dario Amodei, é um microcosmo dos desafios maiores que a humanidade enfrenta com o avanço acelerado da IA. A dissonância entre o ideal e a realidade não é um sinal de falha, mas sim uma característica intrínseca de uma revolução tecnológica tão profunda. As escolhas feitas hoje por líderes da indústria, por governos e pela sociedade civil determinarão se a IA se tornará uma ferramenta para o empoderamento humano e a resolução de problemas globais, ou uma fonte de novos riscos e desigualdades.

É imperativo que o debate sobre a segurança da IA seja contínuo, transparente e inclusivo. Precisamos de mais vozes na mesa, de diferentes disciplinas e culturas, para garantir que as tecnologias sejam desenvolvidas com uma perspectiva global e com o bem-estar da humanidade em seu cerne. A história da Anthropic nos lembra que mesmo as intenções mais nobres podem ser desafiadas pelas complexidades do mundo real, mas também que a persistência em nossos valores é mais importante do que nunca. A inteligência artificial chegou, e realmente, em muitos aspectos, antes do que imaginávamos. Agora, a responsabilidade de moldar seu futuro recai sobre todos nós.

Share this content:

Publicar comentário