IA e o Poder Central: Desvendando a Proposta de Regulação Nacional Única nos EUA

A Inteligência Artificial (IA) não é mais uma ficção científica distante; ela está intrinsecamente tecida no tecido da nossa sociedade, desde algoritmos que recomendam filmes até sistemas complexos que orientam carros autônomos e diagnosticam doenças. Com sua ascensão meteórica, surge uma questão fundamental: como devemos governar essa força transformadora? O debate sobre a regulação da Inteligência Artificial está aceso em todo o mundo, e nos Estados Unidos, essa discussão ganha contornos específicos com a histórica tensão entre o poder federal e a autonomia dos estados.

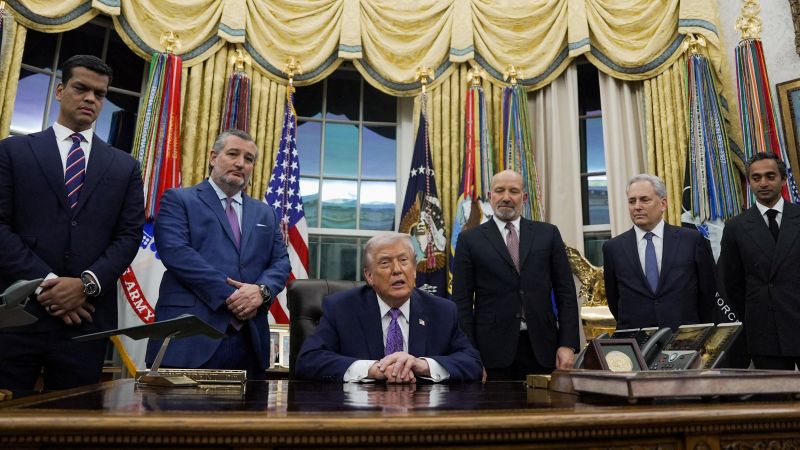

Imagine o cenário: em 11 de dezembro de 2025, um anúncio que reverberou pelos corredores do poder e pelos centros de inovação tecnológica. O então presidente Donald Trump assina uma ordem executiva que não apenas visava barrar os estados de implementarem suas próprias regulamentações sobre Inteligência Artificial, mas também tinha como objetivo criar um “quadro nacional único” para a IA em todo o país. Embora estejamos em um momento diferente, a proposta hipotética de 2025 nos oferece uma lente poderosa para examinar um dos dilemas mais prementes da era digital: quem deve ditar as regras para a tecnologia que molda nosso futuro?

Essa medida hipotética, em sua essência, busca centralizar a abordagem regulatória de uma tecnologia complexa e multifacetada. Por um lado, promete clareza e uniformidade; por outro, levanta questões críticas sobre a adaptabilidade, a especificidade regional e a própria essência da inovação. Neste artigo, vamos mergulhar nas profundezas dessa proposta, explorando o impacto potencial de um modelo de regulação da Inteligência Artificial nacional nos Estados Unidos, seus desafios, suas promessas e o que podemos aprender com essa discussão para o Brasil e o mundo.

Regulação da Inteligência Artificial: O Impasse Federal vs. Estadual

A ideia de uma ordem executiva federal para anular as regulamentações estaduais sobre IA não é apenas um movimento político audacioso; é um reflexo de um dilema inerente ao sistema federativo americano e um ponto de virada crucial na governança tecnológica. Historicamente, os estados americanos têm desempenhado um papel vital na experimentação e implementação de leis que respondem às necessidades locais e às preocupações dos cidadãos. Isso é evidente em áreas como privacidade de dados (com a Lei de Privacidade do Consumidor da Califórnia, CCPA, como um exemplo proeminente), segurança de dados e até mesmo em regulamentações sobre veículos autônomos.

A lógica por trás da autonomia estadual é que diferentes regiões podem ter diferentes prioridades, economias e sensibilidades culturais que exigem abordagens regulatórias distintas. Por exemplo, um estado com uma forte base agrícola pode ter preocupações diferentes sobre o uso de IA na agricultura do que um estado com um ecossistema tecnológico robusto focado em softwares e serviços. Essa diversidade permite que os estados atuem como “laboratórios de democracia”, testando novas abordagens antes que sejam potencialmente adotadas em nível nacional.

No entanto, a fragmentação regulatória tem seu calcanhar de Aquiles. Para empresas que operam em múltiplos estados – ou, de fato, em nível nacional –, navegar por um emaranhado de regras distintas pode ser um pesadelo logístico e financeiro. Imagine uma startup de IA desenvolvendo uma nova ferramenta de diagnóstico médico: ela teria que se adaptar a 50 conjuntos diferentes de diretrizes de privacidade, segurança, viés e responsabilidade, adicionando uma camada esmagadora de complexidade e custo. Essa é a principal argumentação a favor de um “quadro nacional único” para a regulação da Inteligência Artificial.

Os defensores da abordagem federal argumentam que uma estrutura única não apenas simplificaria a conformidade para as empresas, mas também impulsionaria a inovação, criaria um campo de jogo nivelado e garantiria que os EUA pudessem competir efetivamente no cenário global de IA. Ao evitar a criação de “ilhas regulatórias”, o país poderia consolidar seus recursos, estabelecer padrões nacionais de segurança e ética, e apresentar uma frente unificada em discussões internacionais sobre governança de IA. A questão central, então, não é se a IA precisa de regulação, mas sim qual nível de governo está mais apto a provê-la de forma eficaz e justa.

Os Desafios e Oportunidades de um Quadro Regulatório Nacional Único

A centralização da regulação da Inteligência Artificial por meio de um quadro nacional único apresenta tanto oportunidades quanto desafios significativos. Compreender ambos os lados é crucial para avaliar o impacto real de tal política.

Oportunidades de uma Abordagem Unificada:

1. **Clareza e Simplificação:** Para empresas, especialmente startups e Pequenas e Médias Empresas (PMEs), um conjunto único de regras significa menos complexidade, custos reduzidos de conformidade e maior previsibilidade jurídica. Isso pode liberar recursos que seriam gastos em burocracia para serem investidos em pesquisa, desenvolvimento e inovação.

2. **Competitividade Nacional e Global:** Um padrão regulatório unificado pode fortalecer a posição dos EUA como líder global em IA. Permite que as empresas escalem mais rapidamente, atrai investimentos estrangeiros e facilita a colaboração em projetos de grande porte que beneficiam a nação como um todo, como IA para defesa ou infraestrutura crítica.

3. **Segurança e Ética Coerentes:** Questões como vieses algorítmicos, privacidade de dados e segurança cibernética em sistemas de IA são universais. Um arcabouço federal pode estabelecer diretrizes robustas e consistentes para auditoria, testes e mitigação de riscos, protegendo os cidadãos de forma uniforme em todo o país. Além disso, pode acelerar o desenvolvimento de padrões técnicos, como os propostos pelo NIST (National Institute of Standards and Technology).

4. **Alocação de Recursos:** O governo federal tem a capacidade de mobilizar recursos significativamente maiores para pesquisa, desenvolvimento de políticas e fiscalização do que qualquer estado individualmente. Isso pode levar a uma implementação mais eficaz e a um monitoramento mais rigoroso da conformidade.

Desafios Inerentes à Centralização:

1. **Risco de “Tamanho Único”:** A IA é um campo vasto e diversificado. Uma regulamentação única pode não ser capaz de abordar as nuances de setores específicos (saúde, finanças, transporte, militar) ou as particularidades regionais. O que funciona para a IA em veículos autônomos pode ser inadequado para a IA em recrutamento de pessoal, por exemplo. Isso pode levar a uma regulamentação excessivamente branda em algumas áreas críticas ou excessivamente restritiva em outras, sufocando a inovação.

2. **Lentidão e Burocracia Federal:** O processo legislativo e regulatório em nível federal é notoriamente lento e sujeito a influências políticas. Em um campo tão dinâmico quanto a IA, onde as tecnologias evoluem a cada mês, uma estrutura regulatória rígida e demorada corre o risco de se tornar obsoleta antes mesmo de ser totalmente implementada. A agilidade dos estados permite respostas mais rápidas às inovações.

3. **Perda de Experimentação Estadual:** Ao bloquear as regulamentações estaduais, perde-se a valiosa oportunidade de testar diferentes abordagens regulatórias em menor escala. Os estados podem atuar como incubadoras de políticas, permitindo que o governo federal observe o que funciona e o que não funciona antes de implementar uma lei em todo o país.

4. **Concentração de Poder e Influência:** Uma estrutura regulatória federal única pode ser mais suscetível à influência de grandes empresas de tecnologia, que possuem os recursos para fazer lobby em Washington. Isso pode resultar em leis que favorecem os players estabelecidos em detrimento de startups e inovadores menores, que podem não ter voz na capital federal.

Em última análise, a criação de um quadro nacional para a regulação da Inteligência Artificial é um ato de equilíbrio delicado. Requer uma visão que seja robusta o suficiente para proteger os cidadãos e promover a confiança, mas flexível o suficiente para não sufocar a inovação e se adaptar a um futuro tecnológico em constante mudança.

Além das Fronteiras: A Governança da IA em um Cenário Global

A discussão sobre a regulação da Inteligência Artificial nos Estados Unidos não ocorre em um vácuo. Pelo contrário, ela se insere em um contexto global onde diferentes blocos econômicos e países estão adotando abordagens variadas para governar a IA. Compreender esses modelos internacionais é fundamental para contextualizar a proposta americana de um quadro nacional único e para entender as implicações no cenário mundial.

União Europeia: A Abordagem Baseada em Risco

A União Europeia está na vanguarda da regulamentação da IA com sua proposta de AI Act (Lei de IA). Este é um marco regulatório abrangente que adota uma abordagem baseada em risco, categorizando os sistemas de IA de acordo com o nível de risco que representam para os direitos fundamentais e a segurança dos cidadãos. Sistemas de IA de “alto risco” (como aqueles usados em recrutamento, aplicação da lei ou infraestrutura crítica) enfrentam requisitos rigorosos de avaliação de conformidade, transparência, supervisão humana e governança de dados. A UE busca estabelecer um padrão ouro global, promovendo uma IA confiável e centrada no ser humano, embora enfrente críticas sobre o potencial de sufocar a inovação devido à sua rigidez.

China: Controle Estatal e Desenvolvimento Impulsionado

Em contraste, a China adota uma abordagem mais pragmática e orientada para o controle estatal. Embora tenha implementado regulamentações para áreas específicas como algoritmos de recomendação, reconhecimento facial e deepfakes, o foco principal é aproveitar o poder da IA para a prosperidade econômica, a segurança nacional e a vigilância social. A regulação da Inteligência Artificial na China é frequentemente interpretada como um meio de manter o controle sobre a sociedade e impulsionar a liderança tecnológica global, com menor ênfase em liberdades individuais em comparação com as preocupações ocidentais.

O Cenário Global e a Necessidade de Cooperação

Essas abordagens díspares destacam a complexidade de estabelecer normas globais para a IA. A proposta americana de um quadro nacional único se alinha com o desejo de simplificação e promoção da inovação, ecoando em parte a preocupação da China com a competitividade, mas também a busca da UE por segurança e ética, ainda que com uma metodologia diferente.

No entanto, a IA é uma tecnologia sem fronteiras. Um modelo de IA treinado em um país pode ser facilmente implementado em outro. Dados de usuários podem transitar por diversas jurisdições. Isso sublinha a necessidade crítica de cooperação internacional. Organizações como a UNESCO, a OCDE e o G7/G20 estão ativamente envolvidas na elaboração de princípios éticos e diretrizes para a IA, buscando um terreno comum que possa harmonizar, em certa medida, as diferentes abordagens regulatórias. A falta de coordenação global pode levar a um “farrapo regulatório”, dificultando a inovação responsável e a proteção efetiva dos direitos humanos em escala global.

O Papel da Ética e da Transparência

Além das questões geográficas, a governança da IA é intrinsecamente ligada a imperativos éticos. O que significa uma IA justa? Como garantimos que os algoritmos sejam transparentes e explicáveis? Como lidamos com o viés algorítmico, que pode perpetuar ou amplificar preconceitos existentes na sociedade? E como responsabilizamos os desenvolvedores e usuários por sistemas de IA que causam danos?

Uma estrutura de regulação da Inteligência Artificial, seja ela federal ou regional, precisa incorporar princípios de responsabilidade, transparência, auditabilidade, justiça e segurança. Apenas assim poderemos construir a confiança pública necessária para a adoção generalizada e benéfica da IA, garantindo que o progresso tecnológico esteja alinhado com os valores humanos fundamentais.

Impacto no Ecossistema de Inovação e o Futuro da IA

Uma ordem executiva federal para a regulação da Inteligência Artificial teria um impacto profundo e multifacetado no vibrante ecossistema de inovação dos Estados Unidos. Para as grandes corporações de tecnologia, com seus exércitos de advogados e lobistas, um quadro regulatório federal pode ser até bem-vindo, pois oferece uma única “porta de entrada” para influenciar e navegar. Isso poderia, paradoxalmente, solidificar o poder de gigantes como Google, Microsoft, Amazon e Meta, que têm os recursos para se adaptar rapidamente e talvez até moldar as novas regras a seu favor, criando barreiras de entrada para concorrentes menores.

Para as startups, no entanto, o cenário é mais complexo. Embora a simplificação das regras possa parecer uma bênção, a rigidez de uma regulamentação federal única, se mal concebida, poderia sufocar a experimentação e a agilidade que são o oxigênio do setor de tecnologia. Pequenas empresas prosperam na capacidade de inovar rapidamente e iterar seus produtos. Um processo de conformidade demorado ou oneroso pode desviar recursos preciosos de P&D, dificultando o surgimento da próxima grande ideia em IA.

É vital que qualquer arcabouço regulatório nacional incorpore mecanismos de flexibilidade, como “sandboxes” regulatórias. Estes são ambientes controlados onde empresas podem testar inovações de IA sob supervisão, mas com menos restrições do que as regras gerais. Isso permitiria que novas tecnologias amadurecessem sem o peso total da conformidade inicial, ao mesmo tempo em que oferece aos reguladores insights valiosos sobre como a IA está evoluindo e quais regras são realmente necessárias.

Além disso, o debate sobre a regulação da Inteligência Artificial não se resume apenas a governos e empresas. A sociedade civil, acadêmicos e especialistas em ética de IA desempenham um papel crucial. A inclusão de diversas perspectivas no processo de elaboração de políticas é fundamental para garantir que as regulamentações sejam equilibradas, justas e representem os interesses de todos os cidadãos, não apenas os de grandes players da indústria.

O futuro da IA, tanto nos EUA quanto globalmente, dependerá muito de como essas complexas questões regulatórias são resolvidas. Precisamos de um equilíbrio delicado: regras que protejam os indivíduos, promovam a inovação responsável e garantam que a IA sirva ao bem maior. A lição de uma ordem executiva de 2025, hipotética ou não, é que a governança da IA é um campo de batalha para ideias e um desafio constante para a diplomacia e a sabedoria política.

Conclusão: Construindo Pontes em um Futuro Impulsionado pela IA

A discussão hipotética em torno de uma ordem executiva federal de 2025 para unificar a regulação da Inteligência Artificial nos Estados Unidos, barrando as leis estaduais, serve como um poderoso catalisador para um debate mais amplo e urgente. Ela nos força a confrontar a intrincada dança entre o avanço tecnológico e a necessidade de governança. Enquanto a promessa de um quadro nacional único oferece a sedução da simplicidade e da eficiência para impulsionar a inovação e a competitividade global, ela também levanta preocupações legítimas sobre a perda de flexibilidade, a especificidade regional e o risco de uma abordagem “tamanho único” em um campo tão diversificado e dinâmico.

O futuro da IA não será moldado por uma única nação ou por um único conjunto de regras, mas sim por um diálogo contínuo e adaptativo que transcende fronteiras geográficas e políticas. A experiência global nos mostra que não há uma solução única para a regulação da Inteligência Artificial; em vez disso, existem múltiplos caminhos, cada um com seus próprios méritos e desafios. Para o Brasil e outras nações, a lição é clara: ao desenvolver nossas próprias abordagens, devemos aprender com as experiências alheias, buscar o equilíbrio entre a proteção dos cidadãos e a promoção da inovação, e, acima de tudo, garantir que a IA seja uma força para o bem, guiada por princípios éticos e centrada no ser humano. O grande desafio agora é construir essas pontes de entendimento e colaboração para um futuro onde a inteligência artificial possa prosperar de forma responsável e equitativa.

Share this content:

Publicar comentário