Mega Acordo de US$ 100 Bilhões entre OpenAI e Nvidia Esfria: O Que Isso Significa para o Futuro da IA?

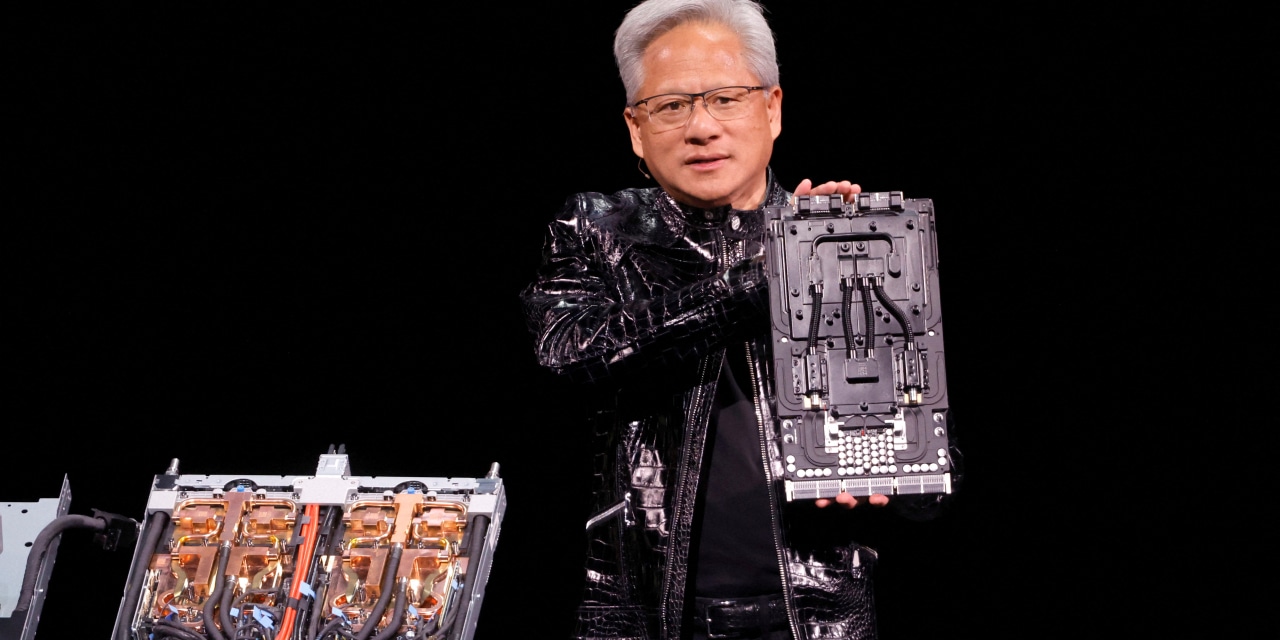

No universo dinâmico e eletrizante da inteligência artificial, cada movimento de gigantes como OpenAI e Nvidia ressoa por todo o ecossistema tecnológico. Recentemente, uma notícia de peso agitou o setor: o potencial mega acordo de US$ 100 bilhões entre a criadora do ChatGPT e a rainha dos chips de IA está, por ora, ‘em banho-maria’. O próprio CEO da Nvidia, Jensen Huang, teria minimizado, em particular, a probabilidade de que o acordo original seja finalizado, embora tenha reiterado que as duas empresas continuarão a manter uma colaboração próxima.

Mas o que significa exatamente esse “esfriamento” de um pacto tão ambicioso? E quais são as ramificações para o futuro da IA, um campo que devora poder computacional como nenhum outro? Prepare-se para mergulhar nos bastidores da corrida pela supremacia da inteligência artificial, onde chips são o novo ouro e a estratégia de hardware molda o amanhã.

### A colaboração OpenAI Nvidia e a demanda insaciável por poder computacional

A ascensão meteórica da Inteligência Artificial Generativa, impulsionada em grande parte por modelos como o GPT da OpenAI, revelou uma verdade inegável: a IA é uma força que exige uma quantidade colossal de poder computacional. Treinar um modelo de linguagem grande (LLM) como o GPT-4, por exemplo, custou dezenas de milhões de dólares e consumiu vastas quantidades de tempo de processamento em algumas das GPUs mais avançadas do mundo. E não é apenas o treinamento; a inferência – ou seja, a execução desses modelos para gerar respostas – também demanda uma infraestrutura robusta e constantemente escalável. É aqui que entra a Nvidia, uma empresa que se tornou, sem exagero, a espinha dorsal da revolução da IA.

Com uma fatia de mercado superior a 90% em chips para IA – as Unidades de Processamento Gráfico (GPUs) – a Nvidia não é apenas uma fornecedora, mas uma parceira estratégica indispensável para qualquer organização séria em IA. Seus aceleradores, como os renomados H100 e A100, são a joia da coroa da computação de IA, oferecendo uma capacidade de processamento paralelo inigualável, essencial para as complexas operações matriciais exigidas pelos algoritmos de deep learning. Mais do que o hardware em si, a Nvidia construiu um ecossistema completo com a plataforma CUDA, um ambiente de programação que facilitou enormemente o desenvolvimento e a otimização de aplicações de IA, tornando seus chips a escolha preferencial e, para muitos, a única viável no curto prazo.

Dado esse cenário, não é surpresa que a OpenAI, com sua ambição de construir a Inteligência Artificial Geral (AGI), estivesse em negociações para um acordo massivo, avaliado em impressionantes US$ 100 bilhões. Tal montante não se referiria apenas à compra de chips, mas provavelmente abrangeria uma parceria de longo prazo para fornecimento, desenvolvimento de infraestrutura, otimização de software e até mesmo colaboração em chips personalizados. Seria um investimento que compraria não apenas milhares de data centers e milhões de chips, mas também garantiria um fluxo constante de inovação e capacidade para as futuras gerações de modelos de IA da OpenAI. Para a Nvidia, seria a validação máxima de sua liderança e um contrato de receita monumental. A potencial colaboração OpenAI Nvidia neste nível seria um divisor de águas, estabelecendo um novo padrão para a indústria.

### Por Que um Acordo Bilionário Pode Ter Esfriado: Desafios e Estratégias por Trás da Megaparceria

Se a necessidade é tão clara e o alinhamento estratégico parece tão perfeito, por que um acordo de US$ 100 bilhões entre a OpenAI e a Nvidia estaria agora ‘em banho-maria’? A resposta reside na complexidade do mercado de IA, nas estratégias de negócios de ambas as empresas e nas dinâmicas de poder que moldam a vanguarda tecnológica. A declaração de Jensen Huang de que o “acordo original” não seria finalizado é particularmente reveladora. Isso sugere que, embora a colaboração continue, a estrutura ou a escala previamente imaginada não se concretizarão na forma esperada.

Do ponto de vista da Nvidia, a demanda por seus chips H100 e A100 é universal e avassaladora. Gigantes como Microsoft, Google, Amazon e Meta, além de inúmeras startups, estão desesperadamente buscando acesso à sua tecnologia. Em um cenário de escassez global de chips de IA, comprometer uma fatia tão grande de sua produção e recursos com um único cliente, mesmo que seja a OpenAI, poderia ser um risco estratégico. A Nvidia pode preferir manter sua flexibilidade, vendendo para uma gama diversificada de clientes e maximizando sua receita no curto e médio prazo, em vez de se amarrar a um único megacontrato que poderia, eventualmente, gerar preocupações antitruste ou limitar futuras oportunidades de mercado. A empresa de Huang tem um histórico de habilidade em equilibrar a demanda e otimizar a distribuição de seus recursos.

Já a OpenAI pode ter seus próprios motivos para repensar a natureza do acordo. Um dos desafios mais prementes para qualquer empresa de IA é o custo e a dependência de hardware de terceiros. A longo prazo, a soberania tecnológica sobre a infraestrutura de computação é um objetivo cobiçado. Rumores sobre o “Projeto Athena” da OpenAI – uma iniciativa para desenvolver seus próprios chips de IA – indicam um desejo claro de reduzir a dependência de fornecedores externos. Embora construir um chip do zero seja uma tarefa monumental e extremamente cara, a capacidade de personalizar o hardware para suas cargas de trabalho específicas pode gerar ganhos de eficiência e reduzir custos operacionais a longo prazo.

Além disso, não podemos ignorar a influência da Microsoft. Como principal investidora e parceira da OpenAI, a Microsoft já está investindo pesadamente em seus próprios chips de IA (como o Maia para inferência e o Cobalt para cargas de trabalho gerais), buscando otimizar os custos e o desempenho de seus próprios serviços de nuvem Azure, que hospedam a maior parte das operações da OpenAI. É possível que a Microsoft prefira que a OpenAI não se vincule tão rigidamente a um único fornecedor, buscando uma estratégia de diversificação de hardware que envolva tanto chips da Nvidia quanto os próprios chips desenvolvidos internamente, ou mesmo de outros fabricantes como a AMD. A complexidade logística e os enormes compromissos financeiros de um acordo de US$ 100 bilhões também poderiam ter levantado bandeiras vermelhas, levando a uma reavaliação das condições e da estrutura original.

### O Futuro da Infraestrutura de IA: Diversificação e a Busca por Soberania Tecnológica

O “esfriamento” do mega acordo entre OpenAI e Nvidia é um sintoma de uma tendência maior na indústria de IA: a busca por diversificação e soberania tecnológica em hardware. Embora a Nvidia continue sendo o rei indiscutível dos chips de IA, as grandes empresas estão cada vez mais investindo no desenvolvimento de suas próprias soluções personalizadas. Google, com seus Tensor Processing Units (TPUs), Amazon, com os chips Inferentia e Trainium, e agora a Microsoft, com Maia e Cobalt, são exemplos claros dessa estratégia. O objetivo é duplo: otimizar o desempenho para suas cargas de trabalho específicas e reduzir os custos operacionais que se tornam proibitivos à medida que a demanda por IA explode.

Essa tendência não significa que a Nvidia perderá sua relevância. Longe disso. Significa que o mercado está amadurecendo e se tornando mais competitivo. Outros players, como a AMD, estão investindo pesado em suas próprias GPUs de IA, como a série MI300X, buscando abocanhar uma fatia desse bolo crescente. A inovação não para; pesquisadores estão explorando novas arquiteturas de chips, como a computação óptica e os chips neuromórficos, que prometem revolucionar ainda mais a eficiência e a velocidade do processamento de IA. A colaboração OpenAI Nvidia pode, portanto, evoluir para um modelo mais flexível, onde a OpenAI continua a ser uma cliente importante da Nvidia, comprando milhares de GPUs para suas necessidades imediatas, enquanto simultaneamente investe em suas próprias capacidades de hardware e explora outras parcerias.

No longo prazo, a infraestrutura de IA será caracterizada por um mosaico de soluções: GPUs altamente otimizadas de empresas como a Nvidia, chips personalizados desenvolvidos internamente por gigantes da tecnologia e talvez até novas arquiteturas emergentes. Essa diversificação é saudável para o ecossistema, pois fomenta a inovação, reduz a dependência de um único fornecedor e, em última instância, pode levar a uma IA mais acessível e poderosa. O cenário não é de ruptura total, mas de redefinição de prioridades e estratégias para garantir a sustentabilidade e a escalabilidade da IA em um futuro onde as demandas computacionais só tendem a crescer.

### Conclusão: Uma Colaboração que se Adapta, um Futuro que se Acelera

O anúncio do “esfriamento” de um possível acordo de US$ 100 bilhões entre OpenAI e Nvidia não é o fim de uma relação, mas sim um indicativo de sua evolução em um mercado de IA em constante ebulição. A complexidade do desenvolvimento da inteligência artificial geral e a voracidade por poder computacional exigem que as empresas líderes reavaliem constantemente suas estratégias de hardware e parcerias. Enquanto a Nvidia mantém sua posição de destaque como fornecedora essencial, a OpenAI e outras gigantes buscam cada vez mais uma abordagem híbrida, combinando o melhor do hardware comercial com o desenvolvimento de soluções internas personalizadas.

O que emerge dessa notícia é um vislumbre do futuro da infraestrutura de IA: um ecossistema mais diversificado, resiliente e focado na otimização de custos e desempenho. A colaboração OpenAI Nvidia continuará, sem dúvida, mas provavelmente sob um novo modelo que reflete as crescentes ambições e as complexas dinâmicas do setor. A corrida pela AGI está longe de terminar, e a forma como o hardware é projetado, adquirido e implantado será, mais do que nunca, o motor dessa incessante busca por inteligência.

Share this content:

Publicar comentário