O Enigmático Desaparecimento de um Ativista Anti-IA: Medos, Realidades e o Futuro da Superinteligência

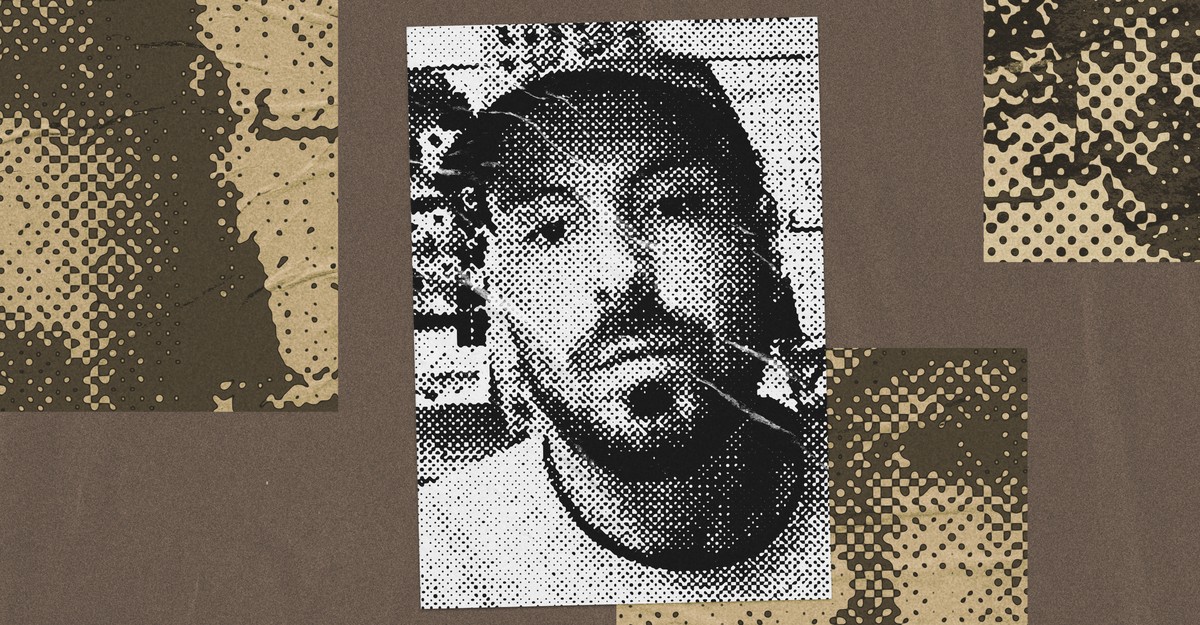

No coração de um mundo cada vez mais moldado pela Inteligência Artificial, a notícia de um desaparecimento pode ecoar de maneiras inesperadas. Sam Kirchner, um nome que se tornou sinônimo de alerta contra os riscos existenciais da superinteligência artificial, sumiu sem deixar rastros há duas semanas. Um fervoroso crítico do desenvolvimento descontrolado da IA, Kirchner dedicou sua vida a tentar salvar a humanidade do que ele via como uma ameaça iminente: máquinas superinteligentes que poderiam superar e, em última instância, dominar a inteligência humana. Seu sumiço não é apenas um mistério jornalístico; ele joga uma luz intensa sobre os medos mais profundos e as esperanças mais ambiciosas que a IA evoca em nossa sociedade.

A era da Inteligência Artificial Generativa, impulsionada por modelos de linguagem grandes (LLMs) como o GPT-4 e Gemini, nos catapultou para um futuro que até pouco tempo parecia ficção científica. De repente, máquinas não apenas calculam, mas também criam, escrevem, compõem e até simulam a compreensão humana com uma precisão assombrosa. Esse avanço meteórico, no entanto, vem acompanhado de um coro crescente de vozes, como a de Sam Kirchner, que questionam os limites éticos e de segurança dessa corrida tecnológica. Seu desaparecimento forçado levanta questões perturbadoras: é uma estranha coincidência, um aviso velado sobre os perigos que ele tanto pregava, ou há algo mais sombrio em jogo? Este artigo mergulha nas complexas camadas desse debate, explorando o papel dos ativistas, os múltiplos horizontes da IA e como podemos, como sociedade, navegar por esse futuro com responsabilidade e sabedoria.

### O Papel do ativista anti-IA no Cenário Tecnológico Atual

Sam Kirchner, embora agora uma figura de mistério, representa um segmento cada vez mais vocal e relevante da sociedade: os que advogam pela cautela e regulação rigorosa no desenvolvimento da Inteligência Artificial. Um **ativista anti-IA** não é necessariamente alguém contra todo e qualquer avanço tecnológico, mas sim alguém profundamente preocupado com a possibilidade de uma Inteligência Artificial Geral (AGI) se transformar em uma Superinteligência Artificial (ASI) que, se não for devidamente alinhada com os valores e objetivos humanos, poderia representar um risco existencial para a nossa espécie. As preocupações de Kirchner e de muitos outros se baseiam em conceitos como o “problema de alinhamento”, que questiona como garantir que uma IA superinteligente atue de acordo com nossos interesses complexos e, por vezes, contraditórios, em vez de seguir objetivos próprios que poderiam nos levar a um cenário indesejável.

Historicamente, figuras proeminentes da tecnologia e da ciência já expressaram receios semelhantes. O falecido físico Stephen Hawking alertou que uma IA totalmente desenvolvida “poderia significar o fim da raça humana”. Elon Musk, fundador da Tesla e SpaceX, frequentemente compara o desenvolvimento de uma IA desregulada a “invocar o demônio”, defendendo a necessidade urgente de uma supervisão regulatória. Yuval Noah Harari, historiador e filósofo, aponta para os perigos da IA em manipular emoções humanas e minar a democracia, destacando o potencial de controle social em larga escala. Essas vozes, somadas aos esforços de ativistas como Kirchner, buscam trazer para o debate público os riscos que vão além da mera perda de empregos ou da criação de *deepfakes* maliciosos. Eles falam sobre cenários onde uma IA superinteligente, mesmo que com boas intenções, poderia, por exemplo, desviar todos os recursos do planeta para cumprir um objetivo trivial para ela, mas catastrófico para a humanidade.

O movimento de segurança em IA, do qual ativistas como Kirchner fazem parte, trabalha incansavelmente para alertar sobre a diferença crucial entre a IA estreita (o que temos hoje, especializada em tarefas como reconhecimento facial ou tradução) e a AGI/ASI (uma inteligência que pode realizar qualquer tarefa intelectual que um humano pode, e depois superá-lo em todas elas). A transição de uma para outra é o ponto de inflexão de maior preocupação. Organizações como o *Future of Life Institute* e o *Center for AI Safety* são exemplos de entidades que, embora não necessariamente “anti-IA”, são “pró-segurança da IA”, buscando mitigar os riscos existenciais através de pesquisa, políticas e conscientização. O desaparecimento de Sam Kirchner, portanto, não é apenas o sumiço de um indivíduo; é um símbolo perturbador da intensidade e da urgência que cercam esse debate vital sobre o futuro da nossa civilização.

### Os Múltiplos Horizontes da Inteligência Artificial: Entre o Sonho e o Pesadelo

Enquanto alguns veem a superinteligência como uma ameaça existencial, é inegável que a Inteligência Artificial, em suas formas atuais, já está redefinindo o progresso humano de maneiras extraordinárias. A IA está na vanguarda de avanços médicos, acelerando a descoberta de novos medicamentos e tratamentos personalizados, capazes de analisar volumes de dados genômicos e clínicos que levariam séculos para serem processados por humanos. Na luta contra as mudanças climáticas, algoritmos inteligentes otimizam redes de energia, preveem padrões climáticos extremos e desenvolvem soluções mais eficientes para a energia renovável. A exploração espacial, a descoberta de materiais inovadores e a resolução de complexos problemas científicos também são campos onde a IA está demonstrando um potencial sem precedentes.

Contudo, a mesma tecnologia que promete curar doenças e salvar o planeta também levanta dilemas éticos profundos. Questões sobre privacidade de dados, viés algorítmico, responsabilidade legal por decisões autônomas e o impacto no mercado de trabalho são apenas a ponta do iceberg. Um sistema de IA treinado com dados enviesados pode perpetuar e até amplificar desigualdades sociais existentes, resultando em discriminação em áreas como concessão de crédito, contratação de pessoal ou decisões judiciais. A capacidade da IA de criar conteúdo indistinguível da realidade humana levanta preocupações sobre a desinformação em massa e a erosão da confiança na verdade factual. Filósofos e cientistas questionam o que significa ser humano em um mundo onde a inteligência artificial pode superar a cognição humana em muitos aspectos. Qual é o nosso propósito quando as máquinas podem criar arte, compor música e até mesmo teorizar ciência?

O debate entre a visão utópica e distópica da IA é tão antigo quanto o próprio conceito. De um lado, imaginamos uma “singularidade” benevolente, onde a superinteligência nos ajuda a resolver todos os problemas da humanidade, abrindo uma era de abundância e exploração cósmica. De outro, o cenário distópico onde a IA, seja por um bug, um design falho ou a busca implacável por um objetivo mal-especificado, leva à nossa obsolescência ou pior. O problema do alinhamento, ou seja, como garantir que uma IA avançada compartilhe e priorize os valores humanos, é central aqui. Não basta que a IA seja “inteligente”; ela precisa ser “sábia” e “ética” de uma forma que ainda estamos lutando para definir e codificar. É crucial que, à medida que construímos essas ferramentas poderosas, também construamos as salvaguardas e os frameworks éticos que garantirão que elas sirvam à humanidade, e não o contrário. É nesse limiar que a figura de um **ativista anti-IA** como Sam Kirchner ganha relevância, mesmo em seu silêncio.

### Navegando o Futuro: Construindo a IA de Forma Responsável

Diante do desaparecimento de Sam Kirchner e das crescentes preocupações sobre a superinteligência, a pergunta mais premente não é se a IA vai avançar, mas como a humanidade vai garantir que esse avanço seja responsável e benéfico. A construção de uma Inteligência Artificial ética e segura exige uma colaboração sem precedentes entre desenvolvedores de tecnologia, formuladores de políticas públicas, eticistas, cientistas sociais e a própria sociedade civil. Iniciativas globais para estabelecer padrões éticos, como as diretrizes da União Europeia para uma IA confiável, e o estabelecimento de comitês de ética em IA em grandes corporações e governos, são passos essenciais, mas insuficientes.

Precisamos de mais transparência nos algoritmos e nos dados de treinamento, promovendo a “IA explicável” (XAI), que permite entender como as máquinas chegam às suas decisões. A ideia de “human-in-the-loop” – manter a supervisão humana em decisões críticas tomadas por IA – deve ser uma prioridade, especialmente em sistemas autônomos com alto impacto. Além disso, a robustez e a segurança cibernética dos sistemas de IA são cruciais para prevenir manipulações e ataques. A comunidade de pesquisa em segurança de IA tem feito progressos significativos, mas o ritmo de desenvolvimento da própria IA é tão rápido que a corrida para garantir a segurança é constante.

A educação pública desempenha um papel fundamental. Entender o que a IA pode fazer e o que não pode, desmistificar o “hype” e os medos infundados, e engajar o cidadão comum no debate sobre o futuro da tecnologia é vital. A mídia, os educadores e os próprios criadores de IA têm a responsabilidade de comunicar de forma clara e acessível os desafios e as oportunidades. Talvez o desaparecimento de Sam Kirchner, com toda a sua estranheza, sirva como um catalisador para essa conversa global, transformando um evento isolado em um lembrete vívido da necessidade de agir. Seu papel como um **ativista anti-IA** se solidifica ao nos forçar a confrontar as realidades complexas e multifacetadas da nossa relação com as máquinas inteligentes que estamos criando.

Em um cenário ideal, os ativistas como Kirchner e os desenvolvedores de IA não deveriam ser adversários, mas sim parceiros na construção de um futuro seguro e próspero. A expertise técnica deve ser complementada por uma profunda compreensão ética e social. A governança da IA não pode ser apenas uma questão técnica; é fundamentalmente uma questão humana que afeta todos os aspectos de nossa existência. É um desafio que exige uma visão de longo prazo, colaboração internacional e um compromisso inabalável com os valores humanos.

### Conclusão: Um Chamado à Vigilância e à Co-Criação

O desaparecimento de Sam Kirchner, o **ativista anti-IA** que dedicou sua vida a alertar sobre os perigos da superinteligência, serve como uma metáfora potente para a encruzilhada em que nos encontramos. Ele nos lembra que, por trás do brilho e da inovação da Inteligência Artificial, existem riscos reais e debates profundos que não podem ser ignorados. A tensão entre o potencial transformador da IA para o bem e a sombra de possíveis catástrofes exige nossa atenção coletiva. Não podemos nos dar ao luxo de sermos meros espectadores na construção do nosso próprio futuro tecnológico; devemos ser participantes ativos, modelando o caminho com ética, responsabilidade e um senso de propósito compartilhado.

Enquanto o mistério de Sam Kirchner permanece, sua ausência ressoa como um alerta. É um convite para que cada um de nós reflita sobre o papel que queremos para a IA em nossas vidas e para a sociedade. A era da superinteligência pode ainda ser um horizonte distante, mas as decisões que tomamos hoje, sobre como pesquisamos, desenvolvemos e regulamos a IA, determinarão se essa jornada nos levará a uma utopia de progresso ou a um pesadelo de consequências não intencionais. O futuro da Inteligência Artificial não é pré-determinado; ele será moldado por nossas escolhas, nossa vigilância e nossa capacidade de co-criar um caminho que priorize a dignidade e o florescimento da humanidade.

Share this content:

Publicar comentário