Nvidia y Google: La Batalla de los Chips que Define el Futuro de la Inteligencia Artificial

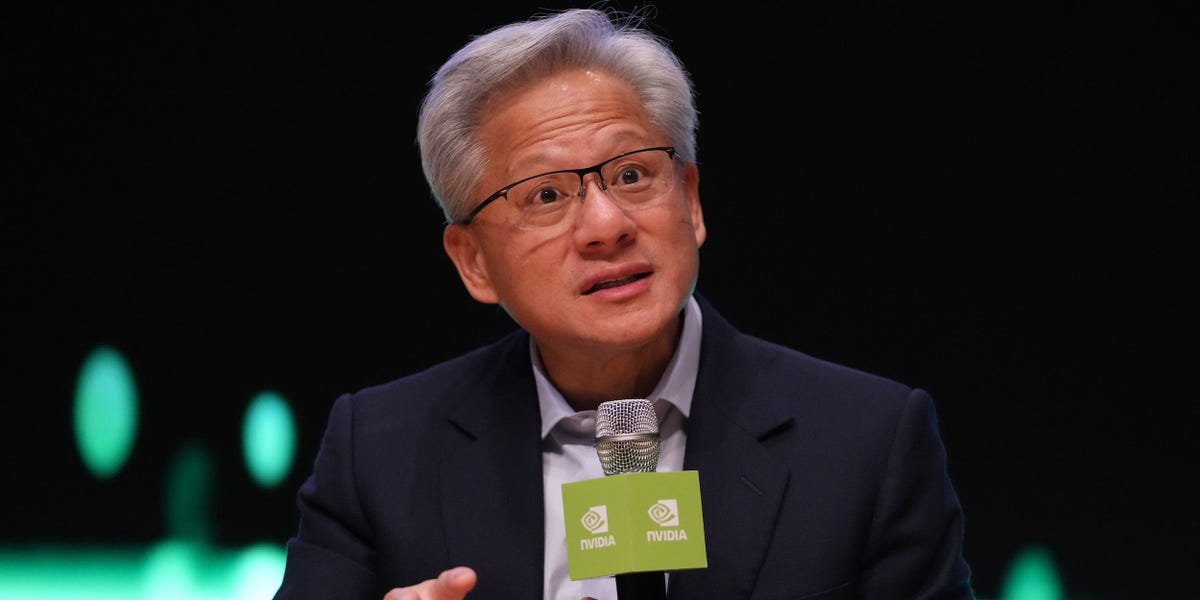

En el dinámico universo de la tecnología, pocas áreas evolucionan tan rápidamente como la Inteligencia Artificial. Y en el corazón de esta revolución, latiendo con la energía del procesamiento de datos, se encuentra la guerra silenciosa –pero cada vez más ruidosa– por los chips que la alimentan. Recientemente, un informe hizo tambalear las acciones de Nvidia, alimentando preocupaciones de que Google estaría avanzando en su territorio, el lucrativo negocio de los semiconductores para IA. Nvidia, por su parte, mantiene la postura de estar “encantada con el éxito de Google”, pero reafirma categóricamente que está “una generación por delante de la industria”.

Esta audaz declaración no es solo marketing; refleja la intensa competencia y las apuestas multimillonarias en juego. Mientras Nvidia ha consolidado su posición como líder indiscutible en el suministro de hardware para IA con sus GPUs (Unidades de Procesamiento Gráfico), gigantes como Google están invirtiendo fuertemente en la creación de silicio personalizado. La pregunta que flota en el aire es: ¿será sostenible la ventaja de Nvidia o estamos presenciando el preludio de un cambio de guardia en el panorama de la computación de alto rendimiento? Este artículo explora esta fascinante rivalidad, sumergiéndose en las tecnologías, estrategias y las profundas implicaciones de esta disputa para el futuro de la IA.

### **El Liderazgo de Nvidia en Inteligencia Artificial: ¿Una Generación de Ventaja?**

La historia de la **Nvidia en Inteligencia Artificial** es un verdadero caso de éxito, un ejemplo de visión estratégica y adaptación. Originalmente, la compañía se destacó en el mercado de tarjetas gráficas para juegos, ofreciendo gráficos de alta calidad a los entusiastas de los videojuegos. Sin embargo, lo que la diferenció fue la percepción temprana de que la arquitectura paralela de sus GPUs –diseñadas para renderizar millones de píxeles simultáneamente– era perfectamente adecuada para las demandas computacionales de los modelos de aprendizaje automático. La capacidad de ejecutar innumerables operaciones matemáticas en paralelo, característica intrínseca de las GPUs, las hizo ideales para entrenar redes neuronales complejas, que exigen exactamente este tipo de procesamiento masivo.

El gran punto de inflexión fue la plataforma CUDA (Compute Unified Device Architecture). Lanzada en 2006, CUDA no era solo hardware, sino un entorno de desarrollo completo que permitía a los programadores acceder directamente al poder de procesamiento paralelo de las GPUs de Nvidia. Esta plataforma se convirtió en el estándar de oro para la computación de alto rendimiento y, crucialmente, para el desarrollo de IA. Investigadores y desarrolladores de todo el mundo adoptaron CUDA, creando una vasta biblioteca de algoritmos y frameworks optimizados para las GPUs de Nvidia. Esta simbiosis entre hardware potente y un ecosistema de software robusto cimentó el dominio de Nvidia.

Hoy, Nvidia es sinónimo de hardware de IA, con sus GPUs H100 y la próxima Blackwell B200 siendo las opciones preferenciales para centros de datos (datacenters), empresas e instituciones de investigación que buscan el máximo rendimiento para entrenar e implementar modelos de IA. La empresa no solo vende chips; ofrece una solución completa, desde el hardware y el software hasta servicios y una comunidad de desarrolladores comprometida. Este enfoque integrado, que abarca desde la arquitectura de chips hasta bibliotecas de software optimizadas (como cuDNN y TensorRT) e incluso supercomputadoras prefabricadas (como el DGX), es lo que confiere a Nvidia su autoproclamada “ventaja de una generación”. No se trata solo de un chip más rápido, sino de un ecosistema completo que dificulta la migración a soluciones de la competencia.

### **El Desafío de Google: Gigantes en Busca de Silicio Propio**

Si Nvidia ha construido un imperio con sus GPUs, Google no se ha quedado de brazos cruzados. Como una de las mayores consumidoras de poder computacional del planeta, especialmente para sus propias operaciones de IA –piénsese en búsqueda, traducción, reconocimiento de voz y visión artificial– la gigante de Mountain View percibió la necesidad de optimizar su hardware internamente. En 2016, Google reveló su respuesta: las TPUs (Tensor Processing Units). A diferencia de las GPUs de propósito general de Nvidia, las TPUs son aceleradores de IA hechos a medida, diseñados específicamente para las cargas de trabajo de aprendizaje automático de Google.

La estrategia detrás de las TPUs es multifacética. En primer lugar, la optimización. Al diseñar chips específicamente para redes neuronales, Google puede lograr eficiencias energéticas y de rendimiento que serían difíciles de replicar con hardware de propósito general. Esto se traduce en menores costos operativos para sus vastas operaciones de IA. En segundo lugar, la independencia. Desarrollar su propio silicio reduce la dependencia de proveedores externos, otorgando a Google un mayor control sobre su cadena de suministro, costos y hoja de ruta tecnológica. Esto es crucial para una empresa que escala sus operaciones de IA a niveles sin precedentes.

Desde su primera generación, las TPUs han evolucionado significativamente, con Google lanzando versiones más potentes y eficientes, como las TPUs v4 y v5e, que son el corazón de la infraestructura de IA de Google Cloud. Estas unidades no solo impulsan servicios internos, sino que también están disponibles para clientes de la nube, ofreciendo una alternativa robusta a los aceleradores basados en GPU. Más recientemente, Google expandió su estrategia de silicio personalizado con el anuncio de los chips Axion, sus propias CPUs basadas en ARM, diseñadas para centros de datos (datacenters). Si bien las CPUs Axion no son aceleradores de IA en el mismo sentido que las TPUs o GPUs, complementan la estrategia, ofreciendo un control aún mayor sobre la infraestructura de computación general y potencialmente mejorando la sinergia con los aceleradores de IA de Google. La ambición es clara: dominar la pila de hardware del centro de datos, desde el procesamiento general hasta la aceleración de IA, garantizando eficiencia, rendimiento y control total sobre su destino digital.

### **Descifrando la “Generación por Delante”: Tecnología y Ecosistema de Nvidia**

Cuando Nvidia afirma estar “una generación por delante”, no se trata solo de velocidad de reloj o de transistores por centímetro cuadrado –aunque también destaca en estos aspectos. La esencia de su liderazgo reside en una combinación intrincada de innovaciones en hardware, una arquitectura de software unificada y un ecosistema de desarrolladores inigualable. Tomemos como ejemplo sus arquitecturas de chips más recientes. La generación Hopper, con la GPU H100, introdujo el Transformer Engine, optimizado para los grandes modelos de lenguaje (LLMs) que están impulsando la revolución de la IA generativa. Este motor es capaz de alternar dinámicamente entre diferentes formatos de precisión, acelerando el entrenamiento y la inferencia de LLMs con una eficiencia sin precedentes. Y el futuro promete aún más con la arquitectura Blackwell, que promete un salto aún mayor en rendimiento y eficiencia, con chips como el B200 y el superchip GB200, que integran GPUs y CPUs en una única unidad de alto rendimiento.

Pero el hardware es solo parte de la ecuación. La verdadera fuerza de Nvidia reside en su software. CUDA, como se mencionó, es el pilar fundamental, pero sobre él se ha construido una vasta pila de software que incluye bibliotecas como cuDNN (para redes neuronales profundas), TensorRT (para optimización de inferencia), y ecosistemas enteros como Nvidia AI Enterprise, que ofrece un conjunto de herramientas y frameworks para la implementación de IA a escala empresarial. Este enfoque de “pila completa” significa que Nvidia no solo proporciona el componente más rápido, sino también todas las herramientas necesarias para que los desarrolladores extraigan el máximo de dicho componente, acelerando el tiempo de lanzamiento al mercado y la productividad. Esto crea un “efecto de red” poderoso: cuantos más desarrolladores utilizan CUDA y el ecosistema Nvidia, más herramientas se crean para él, y más atractivo se vuelve para nuevos usuarios. Es un ciclo virtuoso de innovación y adopción.

Además, Nvidia invierte fuertemente en interconexión. Tecnologías como NVLink, que permite que múltiples GPUs se comuniquen a velocidades altísimas, y la arquitectura Grace Hopper Superchip, que combina una CPU Grace basada en ARM con una GPU Hopper, son ejemplos de cómo la empresa está pensando más allá del chip individual para crear soluciones de sistema completas. Estas innovaciones abordan los cuellos de botella de comunicación y memoria que surgen al escalar modelos de IA gigantescos, garantizando que el poder de procesamiento bruto sea efectivamente utilizado. Es esta combinación de vanguardia en hardware, un ecosistema de software maduro y ampliamente adoptado, y soluciones de sistema integradas lo que refuerza la confianza de Nvidia en su liderazgo de “una generación”.

### **El Escenario Competitivo y los Riesgos de la Batalla de los Chips de IA**

El campo de batalla de los chips de IA no es exclusivo de Nvidia y Google. Otros gigantes e innumerables startups están compitiendo por hacerse con una parte de este mercado en ebullición. AMD, por ejemplo, ha logrado avances notables con sus GPUs Instinct, e Intel, a pesar de algunos contratiempos, está invirtiendo fuertemente en sus GPUs Gaudi y en otras soluciones de IA. Además, otros hyperscalers, como Amazon (con sus chips Trainium e Inferentia) y Microsoft, también están desarrollando silicio personalizado para sus propias nubes, siguiendo la misma lógica de Google: optimización, costo y control. Este escenario, aunque desafiante, es extremadamente beneficioso para el avance de la IA en su conjunto, impulsando la innovación y la competencia.

Para Nvidia, el ascenso del silicio personalizado de los hyperscalers representa un riesgo estratégico significativo. Si los mayores clientes de Nvidia –las empresas de nube– comienzan a utilizar cada vez más sus propios chips, esto podría impactar las ventas y el dominio de la empresa. Nvidia necesita continuar innovando a un ritmo acelerado para garantizar que sus soluciones genéricas de GPU y su ecosistema sigan siendo superiores en rendimiento y relación costo-beneficio, incluso frente a chips optimizados para propósitos específicos. Otro riesgo es el llamado “bloqueo de proveedor” (vendor lock-in) asociado a CUDA. Si bien es una ventaja hoy, en el futuro, la industria podría buscar alternativas más abiertas y flexibles, en caso de que Nvidia no siga ofreciendo un valor superior.

Por otro lado, Google también enfrenta desafíos. El desarrollo de chips es una empresa extremadamente costosa y compleja, que exige inversiones masivas en I+D, fabricación y talento. Mantener la competitividad con el ritmo de innovación de una empresa dedicada exclusivamente a GPUs como Nvidia es una tarea hercúlea. Además, el ecosistema de software en torno a las TPUs no es tan vasto y maduro como el de CUDA, lo que puede limitar su adopción fuera del entorno de Google Cloud. La batalla no es solo sobre el chip más rápido, sino sobre qué ecosistema –hardware, software, herramientas y comunidad– puede ofrecer la mejor solución completa para la miríada de aplicaciones de IA que surgen cada día. Esta carrera impulsará avances notables, democratizando el acceso a un poder de procesamiento cada vez mayor y más eficiente, y, en última instancia, acelerando el progreso de la propia Inteligencia Artificial.

**Conclusión**

La rivalidad entre Nvidia y Google en el campo de los chips de IA es un reflejo vibrante de la importancia estratégica de la Inteligencia Artificial en el mundo contemporáneo. Nvidia, con su infraestructura robusta, su ecosistema CUDA consolidado y la promesa de arquitecturas innovadoras como Blackwell, tiene un argumento sólido para su liderazgo. Sin embargo, Google, con su capacidad de ingeniería masiva y su apuesta por silicio personalizado como las TPUs y los chips Axion, está posicionada para desafiar este dominio, optimizando sus propios recursos y ofreciendo alternativas poderosas en el escenario de la computación en la nube.

Independientemente de qué gigante prevalezca en qué segmento, una cosa es segura: esta feroz competencia es un motor inagotable para la innovación. Forzará a ambas empresas, y al mercado en su conjunto, a empujar los límites de lo posible en términos de rendimiento, eficiencia y accesibilidad para **Nvidia en Inteligencia Artificial**. Al final, quienes más ganamos somos nosotros, consumidores y desarrolladores, con acceso a herramientas cada vez más potentes y versátiles que seguirán moldeando el futuro de una era impulsada por la IA. La batalla de los chips apenas está comenzando, y promete ser un espectáculo fascinante de ingeniería y estrategia.

Share this content:

Publicar comentário