La Sostenibilidad de la IA en Jaque: El Desafío Energético de los Centros de Datos y el Futuro de la Innovación Verde

Desde la revolución industrial, cada gran salto tecnológico trajo consigo una sombra —un costo invisible, a menudo ambiental, que solo se revela con el tiempo—. La Inteligencia Artificial, la fuerza motriz de nuestra era digital, ¿sería diferente? ¿O estaríamos caminando hacia un escenario donde la promesa de un futuro brillante choca con la realidad de un planeta bajo presión?

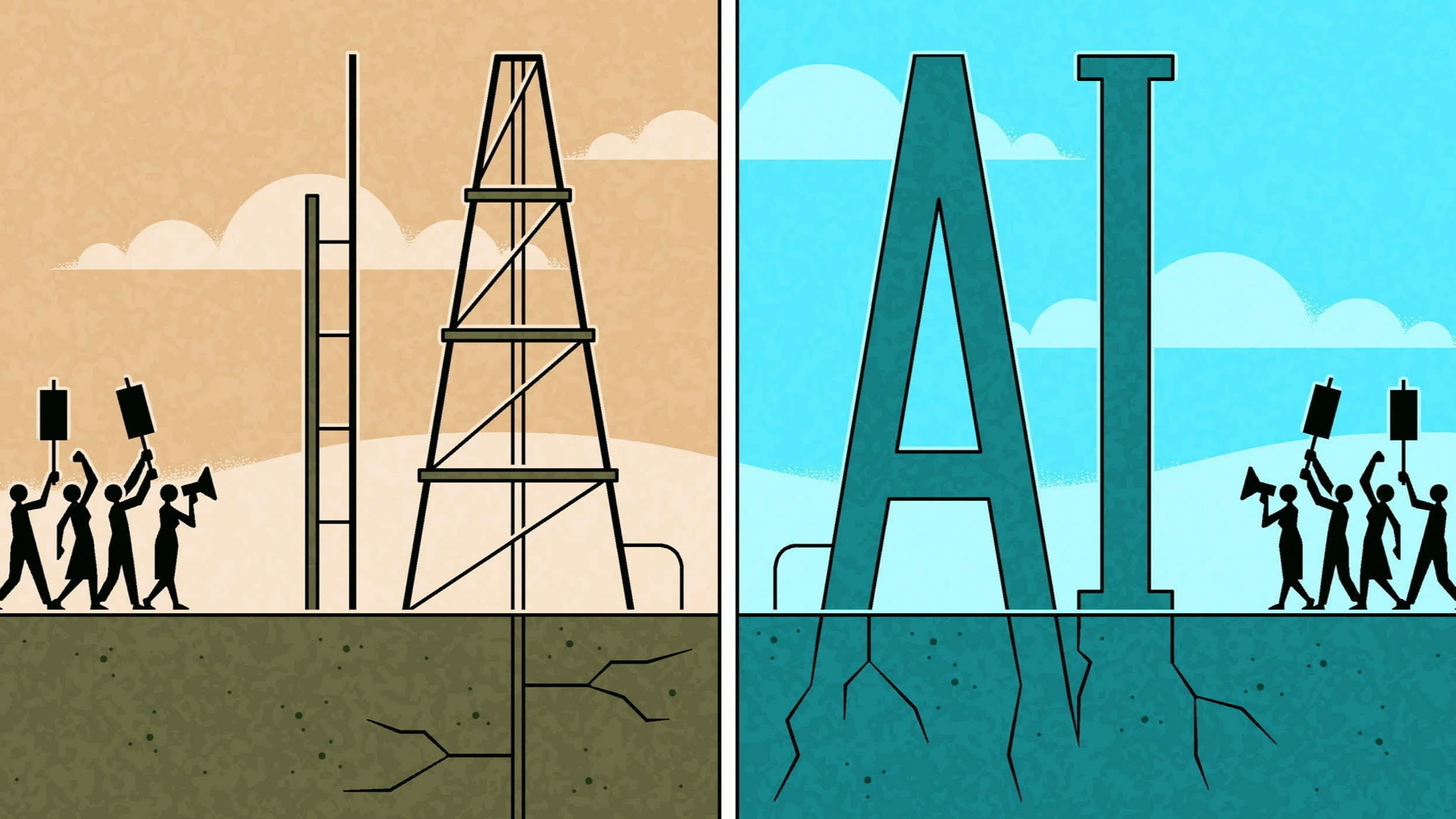

La pregunta ‘¿Es la IA el nuevo fracking?’ resuena con una urgencia creciente en los pasillos de la innovación y en las comunidades afectadas. Ya no se trata de explorar la tierra en busca de combustibles fósiles, sino de agotar recursos energéticos para alimentar los cerebros digitales que moldean nuestro mundo. El debate sobre el impacto ambiental de los centros de datos, infraestructuras gigantescas que albergan los motores de la IA, cobra fuerza, evocando el antiguo ‘Nimbyism’ —la resistencia local a proyectos considerados indeseables—. Pero, ¿esta analogía se sostiene? Y, más importante aún, ¿qué podemos hacer para asegurar que la innovación tecnológica no se convierta en una carga para el planeta?

En este artículo, vamos a profundizar en los desafíos energéticos de la inteligencia artificial, trazar paralelismos con debates ambientales del pasado y explorar las soluciones que pueden guiarnos hacia un futuro donde la tecnología y la sostenibilidad de la IA caminan de la mano.

Sostenibilidad de la IA: El Vínculo Olvidado entre Innovación e Impacto Ambiental

La analogía con el fracking, o fracturación hidráulica, puede parecer drástica a primera vista, pero sirve para subrayar una preocupación fundamental: toda tecnología, por más prometedora que sea, posee un costo inherente. El fracking emergió como una solución energética revolucionaria, prometiendo abundancia de gas y petróleo. Sin embargo, rápidamente se vio envuelto en controversias debido a su impacto ambiental —contaminación de acuíferos, sismos inducidos y una huella de carbono significativa—. La IA, en su ascenso meteórico, también conlleva una promesa de revolución, pero comienza a enfrentar su propio escrutinio ambiental, especialmente en lo que respecta al consumo masivo de energía y recursos hídricos por parte de los centros de datos que la alojan.

Los centros de datos son el pilar físico de la era digital. Son ellos los que procesan y almacenan los billones de datos que alimentan los algoritmos de inteligencia artificial. Y estos centros de datos no son solo ‘nubes’ etéreas; son edificios masivos, repletos de servidores, enrutadores y sistemas de refrigeración que operan las 24 horas del día, los 7 días de la semana. La demanda de electricidad para mantenerlos funcionando es colosal. Se estima que los centros de datos ya representan aproximadamente el 1-3% del consumo global de electricidad, y este porcentaje está proyectado a crecer exponencialmente con la proliferación de la IA generativa y otras aplicaciones intensivas.

El ‘síndrome NIMBY’ (Not In My Backyard – No en Mi Patio Trasero), antes asociado a centrales eléctricas, vertederos o infraestructuras industriales, ahora resuena en comunidades que se resisten a la construcción de nuevos centros de datos en sus proximidades. Aunque ‘silenciosos’ en su operación interna, la infraestructura externa es todo menos discreta. La construcción exige grandes extensiones de tierra, y la demanda de energía y agua puede sobrecargar las redes eléctricas locales y los sistemas hídricos, generando preocupaciones sobre ruido, impacto visual y el aumento de las tarifas de energía para los residentes de la región. En países como Irlanda, por ejemplo, el rápido crecimiento de los centros de datos ha generado debates sobre la capacidad de la red eléctrica nacional para satisfacer esta demanda sin comprometer el suministro para residencias y otras industrias. Esta es una faceta de la sostenibilidad de la IA que no puede ser ignorada.

La preocupación no se limita únicamente al consumo de electricidad. La refrigeración de los servidores, esencial para evitar el sobrecalentamiento, exige cantidades significativas de agua. En regiones ya afectadas por la escasez hídrica, la presencia de un gran centro de datos puede exacerbar aún más la situación. Además, la producción y el descarte de hardware especializado generan una creciente cantidad de basura electrónica (e-waste), a menudo conteniendo metales pesados y sustancias tóxicas, con impactos ambientales a largo plazo. Todo esto compone la compleja huella ambiental de la inteligencia artificial.

El Gigante Sediento: ¿Por Qué la IA Consume Tanta Energía?

Para comprender el desafío de la sostenibilidad de la IA, necesitamos profundizar en las razones técnicas detrás de su voraz apetito energético. La IA moderna, especialmente los modelos de aprendizaje profundo (deep learning) y los grandes modelos de lenguaje (LLMs) como ChatGPT, Gemini y otros, depende de una capacidad de procesamiento sin precedentes.

Entrenamiento e Inferencia: Dos Fases Intensivas

- Entrenamiento: Esta es la fase más intensiva en términos de energía. Para ‘enseñar’ a un modelo de IA a reconocer patrones, generar texto o imágenes, necesita ser expuesto a cantidades masivas de datos. Esto implica billones de cálculos, realizados por miles de procesadores gráficos (GPUs) operando en paralelo durante semanas o incluso meses. El entrenamiento del famoso GPT-3, por ejemplo, se estima que ha consumido energía equivalente a varios viajes en coche de ida y vuelta a la Luna, o el consumo anual de varias residencias. Modelos más recientes y aún más grandes superan estas estimaciones.

- Inferencia: Una vez entrenado, el modelo está listo para ser usado. Cada vez que haces una pregunta a un chatbot de IA, generas una imagen o utilizas una herramienta de traducción basada en IA, ocurre un proceso de ‘inferencia’. Aunque la inferencia es mucho menos intensiva en energía por operación que el entrenamiento, la escala de uso global —miles de millones de interacciones diariamente— acumula una demanda energética sustancial.

El Hardware de la IA: GPUs y Centros de Datos

Las GPUs (Graphics Processing Units), originalmente desarrolladas para procesar gráficos en juegos, resultaron ser excepcionalmente eficaces para las operaciones paralelas exigidas por el aprendizaje automático. Sin embargo, estas tarjetas son complejas, caras y consumen mucha energía. La carrera por chips cada vez más potentes y especializados para IA (como los ASICs – Application-Specific Integrated Circuits) intensifica la demanda de electricidad.

Detrás de cada GPU y servidor, existe un centro de datos. Y un centro de datos no es solo una sala con computadoras. Es una infraestructura compleja que incluye:

- Servidores y Procesadores: Que generan calor intenso.

- Sistemas de Refrigeración: Esenciales para evitar que los equipos se sobrecalienten y fallen. Estos pueden consumir casi tanta energía como los propios servidores, además de grandes volúmenes de agua para sistemas de enfriamiento evaporativo.

- Sistemas de Energía: Fuentes de alimentación ininterrumpida (UPS), generadores de respaldo y transformadores.

- Sistemas de Red: Enrutadores, switches y cables que conectan todo.

- Infraestructura Física: Iluminación, seguridad, sistemas de detección de incendios.

La optimización de cada uno de estos componentes es crucial para mitigar el impacto ambiental de la inteligencia artificial, y es ahí donde la búsqueda de la sostenibilidad de la IA se convierte en un imperativo.

Hacia una IA Verde: Soluciones y Caminos para el Futuro

La buena noticia es que la comunidad global de IA es consciente de estos desafíos y hay un movimiento creciente hacia la llamada ‘IA Verde’. La sostenibilidad de la IA no es solo un ideal, sino un área activa de investigación y desarrollo. Diversas estrategias están siendo exploradas para mitigar el impacto ambiental de la tecnología:

1. Optimización Algorítmica y Modelos Más Eficientes

No necesitamos modelos gigantescos para todas las tareas. Investigadores están desarrollando técnicas para:

- Cuantización: Reducir la precisión de los cálculos numéricos sin comprometer significativamente el rendimiento.

- Poda de Red (Pruning): Remover conexiones y neuronas menos importantes de una red neuronal entrenada.

- Modelos Más Pequeños y Especializados: Entrenar modelos más pequeños y eficientes para tareas específicas (TinyML), que pueden ejecutarse en dispositivos de borde con mucha menos energía.

- Aprendizaje Federado: Entrenar modelos en datos descentralizados, reduciendo la necesidad de mover grandes volúmenes de datos a un centro de datos central.

2. Hardware Innovador y Eficiencia Energética

La industria de semiconductores está invirtiendo fuertemente en hardware más eficiente. Además de los ASICs ya mencionados, nuevas arquitecturas están surgiendo:

- Computación Neuromórfica: Chips diseñados para imitar la estructura y el funcionamiento del cerebro humano, que es increíblemente eficiente en energía.

- Computación Cuántica: Aunque todavía en etapas iniciales, la computación cuántica promete resolver problemas complejos con una demanda energética potencialmente menor para ciertas clases de algoritmos, aunque su infraestructura de enfriamiento también sea intensiva.

- Materiales Semiconductores Avanzados: Investigaciones en nuevos materiales que puedan conducir electricidad de forma más eficiente.

3. Fuentes de Energía Renovable para Centros de Datos

Una de las estrategias más directas es alimentar los centros de datos con energía limpia. Grandes empresas de tecnología como Google, Microsoft y Amazon se han comprometido a operar sus infraestructuras con el 100% de energía renovable. Esto implica:

- Construcción de Centrales Propias: Inversión directa en granjas solares y eólicas.

- Acuerdos de Compra de Energía (PPAs): Contratos a largo plazo para comprar energía de fuentes renovables.

- Diseño de Centros de Datos: Ubicar centros de datos en regiones con abundancia de energía renovable (eólica, hidroeléctrica) o en climas fríos para reducir la necesidad de refrigeración.

4. Técnicas de Refrigeración Avanzadas y Uso Inteligente del Agua

La refrigeración es uno de los mayores consumidores de energía y agua en un centro de datos. Soluciones innovadoras incluyen:

- Refrigeración Líquida (Liquid Cooling): En lugar de aire, líquidos especializados se usan para enfriar los servidores, lo que es mucho más eficiente.

- Refrigeración por Inmersión: Los servidores se sumergen en un líquido dieléctrico no conductor, que absorbe el calor de forma extremadamente eficiente.

- Reúso de Agua: Tratar y reutilizar el agua en los sistemas de refrigeración, minimizando el desperdicio.

- Aprovechamiento del Calor Residual: En algunos casos, el calor generado por los centros de datos puede ser capturado y reutilizado para calentar edificios cercanos o para procesos industriales.

5. IA al Servicio de la Sostenibilidad

Paradójicamente, la propia IA puede ser una herramienta poderosa para combatir el cambio climático y promover la sostenibilidad de la IA. Los algoritmos de inteligencia artificial pueden aplicarse para:

- Optimización de Redes Eléctricas: Prever la demanda y la oferta de energía, integrando mejor las fuentes renovables.

- Eficiencia Energética en Edificios e Industrias: Controlar sistemas de calefacción, ventilación y aire acondicionado de forma más inteligente.

- Previsión Climática y Modelado Ambiental: Mejorar la comprensión del cambio climático.

- Desarrollo de Materiales Sostenibles: Acelerar el descubrimiento de nuevos materiales para baterías, paneles solares y otros.

- Gestión de Residuos y Recursos: Optimizar rutas de recolección de basura, monitorear la calidad del aire y del agua.

Este enfoque demuestra el potencial de la IA de ser parte de la solución, no solo del problema, siempre y cuando su propio desarrollo sea guiado por principios de responsabilidad y eficiencia.

Conclusión: Construyendo un Futuro Inteligente y Sostenible

La analogía entre la inteligencia artificial y el fracking, aunque provocativa, sirve como una poderosa advertencia. Ambas las tecnologías prometen transformar nuestro mundo, pero exigen una evaluación cuidadosa de sus costos ocultos. Así como aprendimos la lección de que el progreso no puede venir a cualquier costo ambiental, la era de la IA nos desafía a construir un futuro digital que sea no solo inteligente, sino también sostenible. Ignorar el impacto energético y ambiental de la IA sería repetir los errores del pasado, cambiando una crisis por otra.

El camino hacia la sostenibilidad de la IA es complejo, exigiendo colaboración continua entre científicos, ingenieros, formuladores de políticas, la industria y la sociedad civil. No basta solo con innovar; es preciso innovar con conciencia, incorporando principios de eficiencia y responsabilidad desde la concepción de nuevos modelos e infraestructuras. Al abrazar soluciones como la optimización de algoritmos, el desarrollo de hardware verde y el uso de energías renovables, podemos garantizar que la inteligencia artificial cumpla su promesa de mejorar la vida humana e impulsar el progreso, sin comprometer la salud y el bienestar de nuestro planeta. El futuro de la tecnología y del medio ambiente está intrínsecamente ligado, y la responsabilidad de equilibrar esta ecuación es nuestra.

Share this content:

Publicar comentário