El Ascenso Silencioso: SK Hynix y la Explosión del Mercado de Memoria para IA hasta 2030

La Inteligencia Artificial (IA) ha dominado los titulares, impulsando innovaciones que remodelan industrias y transforman nuestra interacción con la tecnología. Modelos de lenguaje generativo, vehículos autónomos y sistemas de recomendación complejos son solo la punta del iceberg de un futuro cada vez más inteligente. Sin embargo, detrás del brillo de los algoritmos y las proezas computacionales, reside un componente esencial, pero a menudo invisible, que es el verdadero motor de esta revolución: la memoria.

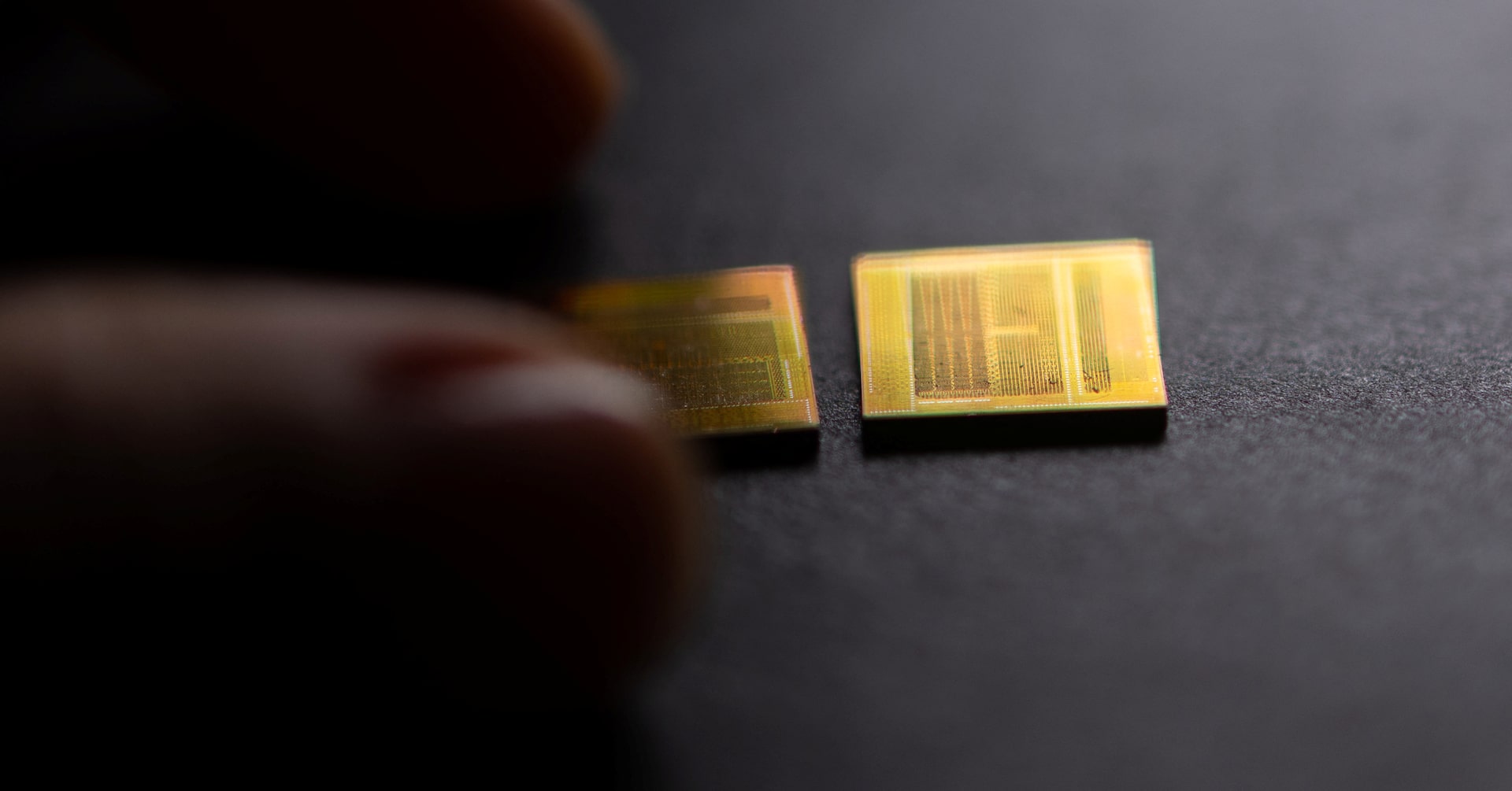

Recientemente, SK Hynix, una de las gigantes globales en el sector de semiconductores y principal proveedora de chips de memoria, realizó una audaz predicción que resuena en todo el ecosistema tecnológico. En una entrevista exclusiva con Reuters, un ejecutivo sénior de la empresa surcoreana reveló que el mercado de memoria para IA especializada se proyecta que crecerá un impresionante 30% anual hasta 2030. Esta proyección no es solo un número; es un faro que ilumina la creciente demanda de soluciones de memoria de alto rendimiento, confirmando que la infraestructura subyacente es tan crítica como los algoritmos en sí mismos para el avance de la inteligencia artificial.

Esta expectativa de SK Hynix no solo valida la urgencia de inversiones masivas en investigación y desarrollo, sino que también subraya la transición de un paradigma donde la CPU y la GPU eran los únicos protagonistas, a un escenario donde la memoria se consolida como un pilar fundamental de la innovación en IA. Es un reconocimiento de que, sin la capacidad de alimentar rápidamente los procesadores con vastas cantidades de datos, las promesas de la IA de próxima generación permanecerían inalcanzables.

Mercado de memoria para IA: El Motor Oculto de la Revolución

La predicción de SK Hynix sobre el crecimiento del mercado de memoria para IA no es solo optimista; es un reflejo de las demandas insaciables de las aplicaciones modernas de inteligencia artificial. Para entender el impacto de esta proyección, es fundamental sumergirse en lo que constituye esta “memoria especializada”. Estamos hablando, en gran parte, de la Memoria de Alto Ancho de Banda, o HBM (High Bandwidth Memory).

A diferencia de la memoria DRAM convencional, que se conecta al procesador mediante pistas relativamente largas en el PCB, la HBM se construye sobre una innovadora arquitectura tridimensional. Múltiples chips de memoria se apilan verticalmente y se interconectan mediante miles de “vías a través de silicio” (TSVs – Through-Silicon Vias), pequeños túneles que atraviesan el silicio. Este apilamiento resulta en una interfaz de comunicación significativamente más amplia y corta, que se conecta a un interposer –una capa intermedia de silicio– que, a su vez, se comunica directamente con el procesador, como una GPU o un acelerador de IA. Esta proximidad y el vasto número de conexiones permiten que la HBM alcance anchos de banda de memoria exponencialmente mayores que las soluciones DDR o GDDR, comunes en computadoras personales y tarjetas de video de consumo.

¿Por qué este ancho de banda es tan crucial para la IA? El cuello de botella principal en muchas cargas de trabajo de inteligencia artificial no es la capacidad de procesamiento bruto (los FLOPs de las GPUs), sino la velocidad con la que los datos pueden ser movidos hacia y desde estos procesadores. Piensa en un modelo de lenguaje grande (LLM), como GPT-4, que puede tener miles de millones o incluso billones de parámetros. Para entrenar o ejecutar inferencia con un modelo de estos, el procesador necesita acceder y procesar terabytes de datos por segundo. La memoria tradicional simplemente no puede seguir este ritmo, creando lo que se conoce como “el muro de la memoria” o “memory wall”, limitando severamente el rendimiento.

La HBM resuelve este problema, actuando como un reservorio de datos de alta velocidad, capaz de volcar información en las unidades de procesamiento (TPUs, GPUs, ASICs) a una tasa sin precedentes. Esta capacidad es indispensable para algoritmos complejos de aprendizaje profundo, que exigen operaciones matriciales masivas y el acceso simultáneo a un vasto conjunto de datos y parámetros. El crecimiento del 30% anual en el mercado de memoria para IA hasta 2030, por lo tanto, es una validación directa de cuán intrínseca se ha vuelto la HBM para el avance continuo y la democratización de la inteligencia artificial, desde los centros de datos de hiperescala hasta las aplicaciones de IA de vanguardia.

¿Por Qué la Memoria es la Clave para la IA de Próxima Generación?

La demanda de chips de memoria de alto rendimiento no es un capricho, sino una necesidad técnica fundamental impulsada por las características inherentes de la IA moderna. El entrenamiento de modelos de aprendizaje profundo, especialmente los modelos de lenguaje grandes (LLMs) y modelos de visión por computadora, exige el procesamiento de petabytes de datos. Esta escala de datos no puede ser efectivamente manipulada sin una arquitectura de memoria que pueda seguir la velocidad de procesadores cada vez más potentes.

El ancho de banda de memoria es, quizás, el factor más crítico. Las GPUs, diseñadas para paralelismo masivo, son el caballo de batalla de la IA. Sin embargo, su eficacia está directamente limitada por la capacidad de acceder a los datos necesarios. Si la memoria no puede proporcionar datos a la velocidad que la GPU puede consumirlos, el procesador permanece inactivo, esperando –un desperdicio de miles de millones de dólares en poder computacional. La HBM, con su arquitectura apilada e interfaz de bus ampliada (2048 bits o más, comparado con los 256 o 384 bits de la GDDR6), ofrece un ancho de banda que puede ser varias veces mayor que la memoria convencional, permitiendo que las GPUs operen a su capacidad máxima.

Además del ancho de banda, la eficiencia energética es un factor crucial. Los centros de datos de IA consumen cantidades colosales de energía. La HBM, debido a su proximidad física con el procesador y a las pistas de señal más cortas, logra transferir datos con mucha menos energía por bit que las interfaces de memoria más distantes. Esto no solo reduce los costos operativos, sino que también minimiza la generación de calor, un desafío significativo en sistemas de IA de alta densidad. La capacidad de empaquetar más memoria y procesamiento en un espacio más pequeño, con menor consumo de energía, es vital para el desarrollo de sistemas de IA más sostenibles y escalables.

Los modelos de IA se están volviendo cada vez más grandes y complejos, con un número creciente de parámetros y capas. La memoria no es solo un repositorio temporal; almacena los pesos y los datos de activación del modelo durante el entrenamiento y la inferencia. Para modelos de gigabytes o terabytes, es inviable cargarlos y descargarlos constantemente del almacenamiento secundario. Necesitan residir en la memoria de acceso rápido. La HBM ofrece la capacidad y la velocidad necesarias para mantener estos modelos “vivos” y accesibles, permitiendo que la IA no solo funcione, sino que también evolucione hacia nuevas arquitecturas y aplicaciones. La HBM, por lo tanto, es la espina dorsal invisible que soporta la arquitectura de procesamiento paralelo, permitiendo que la IA alcance sus niveles más ambiciosos.

Implicaciones y el Futuro de la Industria

La predicción de SK Hynix para el mercado de memoria para IA tiene implicaciones profundas que se extienden mucho más allá de las fábricas de chips. Delinea un escenario de inversiones masivas, innovación acelerada y una carrera estratégica entre los principales fabricantes de semiconductores. Empresas como SK Hynix, Samsung y Micron están a la vanguardia de esta batalla por el dominio en el mercado de HBM, invirtiendo miles de millones de dólares en nuevas líneas de producción, investigación y desarrollo para mejorar la tecnología y aumentar la capacidad de fabricación.

La complejidad de la producción de HBM es un desafío notable. El proceso de apilamiento de chips, la creación de TSVs y la integración con el interposer exigen precisión microscópica y tecnologías de empaquetado avanzadas, resultando en rendimientos de producción que son notoriamente difíciles de optimizar. Esta complejidad crea barreras de entrada significativas, concentrando el conocimiento y la capacidad de producción en pocas empresas. Consecuentemente, la resiliencia de la cadena de suministro de HBM se ha convertido en una preocupación estratégica para empresas de tecnología en todo el mundo, incluyendo gigantes como NVIDIA, AMD e Intel, que dependen de estos componentes para sus aceleradores de IA de última generación.

El crecimiento proyectado también impulsa una carrera por la innovación. Ya estamos viendo la evolución de HBM2e a HBM3, y ahora a HBM3e (Extended), con la promesa de HBM4 en el horizonte. Cada nueva generación busca no solo mayor ancho de banda y capacidad, sino también mejor eficiencia energética y menor latencia. Estas mejoras son cruciales para permitir modelos de IA aún más grandes y eficientes, que podrán abordar tareas más complejas y adaptarse a escenarios diversos, desde centros de datos de hiperescala hasta dispositivos de borde con capacidad de inferencia en tiempo real.

Además, el impacto del mercado de memoria para IA resuena en todo el ecosistema tecnológico. Los proveedores de servicios en la nube, como AWS, Google Cloud y Microsoft Azure, están expandiendo sus infraestructuras de IA y dependen críticamente de la disponibilidad de memoria de alto rendimiento. El crecimiento de este sector también puede catalizar la innovación en materiales avanzados, técnicas de fabricación y diseño de chips, generando un efecto multiplicador en toda la industria de semiconductores. En última instancia, la capacidad de satisfacer esta creciente demanda de memoria especializada no solo determinará la velocidad del avance de la IA, sino que también moldeará el panorama competitivo global de la tecnología para las próximas décadas.

Conclusión

La predicción de SK Hynix de un crecimiento anual del 30% para el mercado de memoria para IA hasta 2030 es más que una estadística económica; es un testimonio de la redefinición fundamental de lo que impulsa la Inteligencia Artificial. La memoria, antes un componente secundario en las discusiones sobre supercomputación, ha emergido como un elemento tan estratégico como los propios procesadores. Es el canal vital que permite a los algoritmos de IA acceder, procesar y aprender de volúmenes de datos que antes eran inimaginables, desbloqueando capacidades que continúan sorprendiéndonos y moldeando nuestro mundo.

Mientras André Lacerda, apasionado por la IA y la tecnología, observamos esta tendencia, queda claro que la colaboración entre fabricantes de memoria, desarrolladores de procesadores y empresas de software será esencial para sostener esta trayectoria de crecimiento. Los desafíos de la producción, la optimización energética y la constante innovación exigirán un esfuerzo conjunto sin precedentes. Sin embargo, la recompensa –un futuro donde la inteligencia artificial puede alcanzar su pleno potencial, impulsando avances en la medicina, ciencia, entretenimiento y mucho más– es un incentivo poderoso. El futuro de la IA es brillante, y la memoria, en sus formas más avanzadas y especializadas, será el pilar silencioso que sostendrá esta revolución.

Share this content:

Publicar comentário