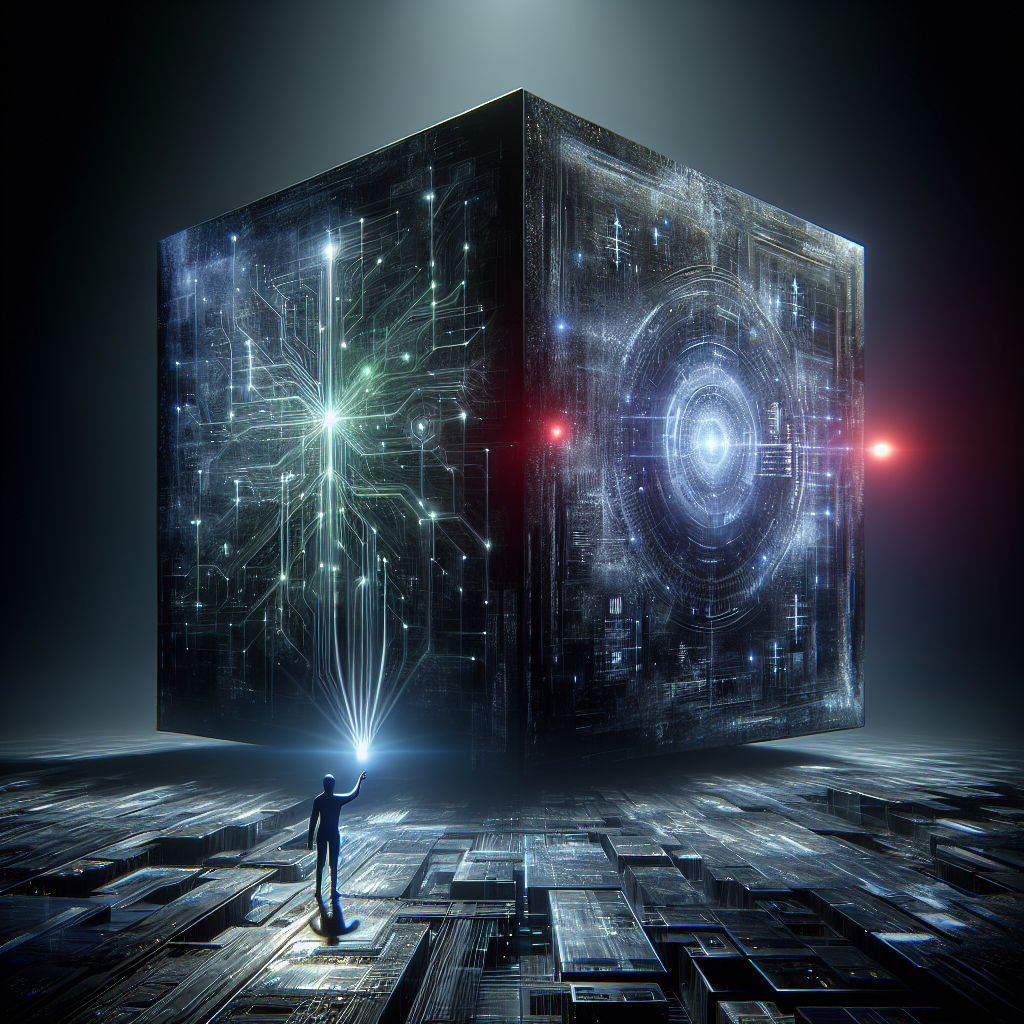

IA Explicable (XAI): ¿Por qué necesitamos entender la “caja negra”?

La inteligencia artificial se ha infiltrado en casi todos los aspectos de nuestras vidas, desde la sugerencia de películas y música hasta la optimización de rutas de tráfico, el diagnóstico médico y la toma de decisiones financieras. Con el avance exponencial de la capacidad de procesamiento y la sofisticación de los algoritmos, la IA dejó de ser una promesa futurista para convertirse en una realidad omnipresente. Sin embargo, mientras celebramos los triunfos de la IA, surge una pregunta fundamental y cada vez más urgente: ¿_cómo_ llegan estas máquinas a sus conclusiones? Detrás de los impresionantes resultados de muchos modelos de IA modernos, reside una enigmática “caja negra”, cuyos mecanismos internos permanecen opacos incluso para sus creadores.

Esta opacidad genera no solo escepticismo, sino también preocupaciones éticas, sociales y de seguridad, especialmente cuando la IA actúa en dominios críticos como la salud, la justicia y las finanzas. ¿Cómo podemos confiar plenamente en un sistema que no puede explicar sus decisiones? ¿Cómo podemos corregir errores o identificar sesgos si no comprendemos la lógica subyacente? Es en este escenario donde surge la necesidad apremiante de la **IA Explicable (XAI)** – un campo de investigación y desarrollo dedicado a hacer que los sistemas de inteligencia artificial sean más transparentes y comprensibles. Comprender la “caja negra” no es solo un desafío técnico; es un imperativo para construir una IA más responsable, confiable y aceptada por la sociedad. Este artículo se sumergirá profundamente en el universo de la XAI, explorando por qué es tan crucial y cómo podemos empezar a desvelar los misterios detrás de las decisiones de las máquinas.

IA Explicable XAI: Desvelando la “Caja Negra” de la Inteligencia Artificial

La inteligencia artificial, en su esencia, busca replicar e incluso superar la cognición humana para realizar tareas complejas. Con el advenimiento del aprendizaje automático y, más notablemente, del aprendizaje profundo (deep learning), hemos sido testigos de un salto cualitativo en el rendimiento de los modelos de IA. Las redes neuronales profundas, por ejemplo, han demostrado una capacidad extraordinaria para identificar patrones en datos masivos, lo que ha resultado en avances sin precedentes en áreas como el reconocimiento de imágenes, el procesamiento del lenguaje natural y la medicina diagnóstica. Sin embargo, este rendimiento a menudo tiene un costo: la falta de interpretabilidad. La complejidad intrínseca de estos modelos –con millones, o incluso miles de millones, de parámetros y capas ocultas de procesamiento– los convierte intrínsecamente en “cajas negras”. No podemos entender de forma clara e intuitiva por qué una determinada entrada lleva a una determinada salida.

La **IA explicable XAI** surge como la disciplina que busca precisamente abordar esta brecha. Su objetivo primordial es desarrollar métodos y técnicas que permitan a los seres humanos comprender, confiar y gestionar los modelos de IA, especialmente aquellos que operan como cajas negras. No se trata solo de saber _qué_ predijo el modelo, sino _por qué_ hizo esa predicción. En otras palabras, la XAI busca transformar un sistema opaco e impenetrable en un socio colaborativo, capaz de comunicar su lógica de razonamiento de manera comprensible.

¿Qué es la “Caja Negra” de la IA y Por Qué es un Problema?

Para entender la XAI, es fundamental comprender el concepto de la “caja negra”. Imagine un dispositivo electrónico sofisticado: sabes lo que hace, pero no tienes idea de cómo opera internamente. En el contexto de la IA, esta “caja negra” se refiere a modelos de aprendizaje automático cuyos procesos internos de decisión son tan complejos que se vuelven ininteligibles para un observador humano. Esto es particularmente cierto para modelos de aprendizaje profundo (deep learning), como las redes neuronales convolucionales (CNNs) para visión artificial o los _transformers_ para procesamiento del lenguaje natural.

Estos modelos aprenden jerarquías de características directamente de los datos, a menudo sin la intervención humana para la ingeniería de características. Cada capa de una red neuronal profunda puede aprender representaciones cada vez más abstractas de los datos de entrada. Por ejemplo, en una CNN que detecta rostros, las primeras capas pueden identificar bordes y texturas, las capas intermedias pueden combinar esta información para reconocer características faciales (ojos, nariz), y las últimas capas pueden ensamblar estas características para identificar un rostro completo. El desafío es que las transformaciones que ocurren entre estas capas se realizan mediante operaciones matemáticas complejas y no lineales, cuyos pesos y sesgos se ajustan durante el entrenamiento de forma empírica, resultando en millones de interacciones que no se traducen fácilmente en reglas lógicas o comprensibles para un ser humano.

La opacidad de esta “caja negra” genera una serie de problemas críticos:

* **Falta de Confianza:** Si un sistema de IA no puede explicar sus decisiones, ¿cómo podemos confiar en él, especialmente en escenarios de alto riesgo?

* **Dificultad de Depuración:** Cuando un modelo de IA falla o comete un error, la ausencia de explicabilidad hace extremadamente difícil identificar la causa raíz del problema y corregirlo.

* **Identificación de Sesgos:** Los modelos entrenados con datos sesgados pueden perpetuar y amplificar prejuicios sociales existentes. Sin la capacidad de inspeccionar cómo se toman las decisiones, estos sesgos pueden pasar desapercibidos, lo que lleva a resultados injustos o discriminatorios.

* **Cumplimiento Normativo:** En muchas jurisdicciones, existen requisitos legales y éticos para que las decisiones que afectan a los individuos sean explicables y justas. El Reglamento General de Protección de Datos (RGPD) de la Unión Europea, por ejemplo, establece un “derecho a la explicación” para decisiones automatizadas. La Ley General de Protección de Datos (LGPD) en Brasil también refuerza la necesidad de transparencia.

* **Responsabilidad:** ¿Quién es responsable cuando un sistema de IA comete un error grave – el desarrollador, el operador, o el propio algoritmo? La falta de explicabilidad complica la atribución de responsabilidad.

Ante estos desafíos, la IA explicable XAI no es solo un avance tecnológico; es una necesidad fundamental para la integración ética y eficaz de la IA en la sociedad.

Por Qué la Explicabilidad es Crucial para un Futuro Confiable de la IA

La necesidad de comprender la “caja negra” de los algoritmos va mucho más allá de la curiosidad académica. Toca pilares esenciales de nuestra sociedad: confianza, ética, justicia y seguridad. La explicabilidad actúa como el puente entre el rendimiento técnico y la aceptación humana, transformando modelos de IA de herramientas misteriosas en colaboradores transparentes. Exploremos las principales razones por las que la XAI es innegablemente crucial.

Confianza y Aceptación Pública

Cuando un sistema de IA influye en la vida de las personas –ya sea otorgando un préstamo, determinando un diagnóstico médico o aprobando una solicitud de visa– la confianza es primordial. Si el sistema no puede justificar sus decisiones, la confianza se erosiona. La XAI permite que los usuarios, sean ellos expertos o legos, comprendan la base de las recomendaciones o predicciones de la IA, lo que es fundamental para construir y mantener la confianza. Una IA que explica el porqué de un diagnóstico o una denegación es mucho más propensa a ser aceptada y utilizada que una que opera de forma enigmática.

Reglamentación y Cumplimiento

Con el aumento de la utilización de la IA en sectores regulados, crece la demanda de transparencia y responsabilidad. Legislaciones como el RGPD en Europa y la LGPD en Brasil ya establecen el “derecho a la explicación” para decisiones automatizadas que afectan a los individuos. Además, el _AI Act_ propuesto por la Unión Europea busca categorizar y regular sistemas de IA basados en el riesgo, exigiendo mayor explicabilidad para aquellos considerados de “alto riesgo”. La XAI es esencial para que las organizaciones puedan demostrar el cumplimiento de estas regulaciones, garantizando que sus IAs operen de forma justa, transparente y auditable.

Identificación y Mitigación de Sesgos

Uno de los mayores peligros de los sistemas de IA es su capacidad de internalizar y amplificar sesgos presentes en los datos de entrenamiento. Si los datos reflejan desigualdades sociales, prejuicios históricos o representaciones distorsionadas, el modelo de IA puede aprender estos sesgos e incorporarlos en sus decisiones, resultando en discriminación injusta (por ejemplo, en contrataciones, aprobación de crédito o sistemas de justicia penal). La explicabilidad de la IA permite identificar qué características de los datos están influyendo desproporcionadamente en una decisión, revelando posibles sesgos. Con esta información, los desarrolladores pueden intervenir para mitigar o eliminar estos sesgos, haciendo el sistema más equitativo y justo.

Mejora del Rendimiento y Depuración de Modelos

La XAI no sirve solo para satisfacer requisitos éticos o legales; es una herramienta poderosa para los propios desarrolladores de IA. Al entender cómo y por qué un modelo toma una decisión específica, los ingenieros y científicos de datos pueden:

- Identificar y corregir errores de manera más eficiente.

- Optimizar el modelo, entendiendo qué _features_ son realmente importantes y cuáles están causando ruido.

- Comprender la robustez del modelo y su sensibilidad a diferentes tipos de entrada.

- Mejorar la ingeniería de _features_ y el diseño del modelo para futuras iteraciones.

La explicabilidad transforma la depuración de un proceso de prueba y error ciego en un análisis dirigido e informado.

Responsabilidad y Atribución de Fallas

Cuando un sistema de IA comete un error con consecuencias graves –un diagnóstico médico incorrecto, una falla en un vehículo autónomo, una decisión financiera perjudicial– es fundamental determinar la responsabilidad. Sin la XAI, es casi imposible rastrear el origen de la falla: ¿fue un problema en los datos de entrenamiento, una falla en la arquitectura del modelo, un error de implementación, o una interacción inesperada en el entorno operativo? La capacidad de explicar el razonamiento del modelo facilita la atribución de responsabilidad y ayuda a establecer los mecanismos de rendición de cuentas.

Toma de Decisión Crítica

En campos como medicina, defensa, transporte y justicia, las decisiones de IA tienen un impacto directo y profundo en la vida humana. Los médicos necesitan entender por qué un sistema de IA sugiere un tratamiento específico, los jueces necesitan saber por qué un algoritmo predice un riesgo de reincidencia, y los ingenieros de vehículos autónomos necesitan asegurarse de que el coche entiende por qué frenó o aceleró. La explicabilidad en estas áreas no es un lujo, sino una necesidad para garantizar seguridad, eficacia y aceptación.

Mejora del Aprendizaje e Investigación

La XAI también contribuye al avance de la propia ciencia de la IA. Al entender mejor cómo funcionan los modelos complejos, los investigadores pueden desarrollar teorías más robustas sobre el aprendizaje, crear nuevas arquitecturas de modelos que son intrínsecamente más explicables, y descubrir _insights_ sobre el propio proceso de toma de decisiones. Esto acelera el ciclo de investigación y desarrollo, llevando a innovaciones más rápidas e impactantes.

En resumen, la XAI es el eslabón perdido que permite que la IA no sea solo poderosa, sino también transparente, justa y, sobre todo, humana en su interacción e impacto. Es la clave para desbloquear un futuro donde la inteligencia artificial no solo asiste, sino que también comprende y es comprendida por los seres humanos.

Técnicas y Enfoques de la IA Explicable (XAI)

La búsqueda por desvelar la “caja negra” de la IA ha dado origen a una rica variedad de técnicas y enfoques, cada una con sus propias fortalezas y aplicaciones. Estas técnicas pueden ser clasificadas de manera general de diversas maneras, pero una distinción común es entre modelos intrínsecamente explicables (transparentes por diseño) y métodos de explicación _post-hoc_ (aplicados después del entrenamiento del modelo).

Modelos Intrinsecamente Explicables (Transparencia por Diseño)

Algunos modelos de aprendizaje automático son, por su propia naturaleza, más fáciles de entender. Están diseñados para ser transparentes, incluso si pueden sacrificar un poco de rendimiento en comparación con sus equivalentes de caja negra en tareas muy complejas.

- Árboles de Decisión: Son modelos que representan decisiones como un flujo de preguntas y respuestas, similar a un diagrama de flujo. Cada nodo en el árbol representa una característica, y cada rama representa una decisión basada en esa característica. Son intuitivas y fáciles de visualizar.

- Reglas de Asociación y Sistemas Basados en Reglas: Modelos que operan con un conjunto de reglas lógicas “SI-ENTONCES”. Por ejemplo, “SI el cliente tiene altos ingresos Y buen historial crediticio ENTONCES aprobar préstamo”. Su lógica es directa y verificable.

- Modelos Lineales (Regresión Lineal, Regresión Logística): En estos modelos, la salida es una combinación lineal de las entradas. La importancia de cada característica está dada directamente por el peso del coeficiente asociado a ella, haciendo que su contribución a la decisión sea muy clara.

- Modelos Aditivos Generalizados (GAMs): Son una extensión de los modelos lineales que permiten funciones no lineales para cada predictor, manteniendo la aditividad. Esto significa que la contribución de cada característica aún puede ser visualizada y comprendida individualmente.

La principal ventaja de estos modelos es que la explicación ya está incrustada en su estructura. Sin embargo, su capacidad para modelar relaciones muy complejas puede ser limitada.

Explicaciones _Post-Hoc_ (Post-Entrenamiento)

Para la mayoría de los modelos de aprendizaje profundo (deep learning) y otros algoritmos complejos de caja negra, la explicabilidad necesita ser extraída después de que el modelo ha sido entrenado. Las técnicas _post-hoc_ intentan “abrir” la caja negra de alguna manera, proporcionando _insights_ sobre cómo se toman las decisiones, sin alterar la estructura interna del modelo. Se pueden dividir en:

- **Model-Agnostic (Independientes del Modelo):** Pueden aplicarse a cualquier modelo de aprendizaje automático, independientemente de su arquitectura interna. Esto los hace extremadamente versátiles.

- **LIME (_Local Interpretable Model-agnostic Explanations_):** LIME genera explicaciones locales, es decir, explica una única predicción del modelo. Funciona perturbando la entrada de un modelo complejo, observando cómo cambian las predicciones y, luego, entrenando un modelo localmente interpretable (como una regresión lineal o un árbol de decisión simple) sobre estas perturbaciones y sus respectivas predicciones. Este modelo simple local se utiliza para explicar la predicción original. Para una imagen, por ejemplo, LIME puede resaltar qué superpíxeles son más relevantes para la clasificación.

- **SHAP (_SHapley Additive exPlanations_):** Basado en la teoría de juegos cooperativos, SHAP asigna a cada característica una “contribución” para la predicción de una instancia, en comparación con la predicción base promedio. Los valores SHAP son la única solución para asignar las contribuciones de forma justa y consistente, satisfaciendo propiedades deseables de explicabilidad. Pueden explicar tanto predicciones individuales (explicación local) como la importancia general de las características para el modelo (explicación global).

- **ANCHOR:** Similar a LIME, ANCHOR produce reglas de “cobertura” de alto nivel que son anclas para una predicción. Es decir, encuentra un conjunto mínimo de características que, si están presentes, garantizarán la predicción del modelo con alta probabilidad, independientemente de las otras características.

- **Model-Specific (Específicas del Modelo):** Diseñadas para trabajar con tipos específicos de modelos, generalmente redes neuronales, aprovechando su arquitectura para extraer _insights_.

- **Saliency Maps (Mapas de Salience):** Muy comunes en visión artificial, los mapas de salience resaltan las regiones de una imagen que más contribuyeron a la decisión del modelo (por ejemplo, en la clasificación de un objeto). Esto se hace generalmente calculando los gradientes de la función de pérdida en relación con los píxeles de entrada. Técnicas como Grad-CAM son variaciones populares que generan mapas de salience de alta resolución.

- **Attention Mechanisms (Mecanismos de Atención):** Aunque no son estrictamente una técnica _post-hoc_, los mecanismos de atención, ampliamente utilizados en modelos de procesamiento del lenguaje natural (como los _Transformers_), pueden ser vistos como una forma intrínseca de explicabilidad. Permiten que el modelo “preste atención” a diferentes partes de la entrada al generar una salida, y estos pesos de atención pueden ser visualizados para entender qué palabras o partes del texto fueron más relevantes para una determinada predicción o generación.

- **Análisis de Activación de Neuronas:** Implica la visualización de lo que cada neurona o capa dentro de una red neuronal profunda está “aprendiendo” o respondiendo. Por ejemplo, se pueden generar imágenes que maximizan la activación de una neurona específica para entender el tipo de patrón que detecta.

Visualización e Interacción

Una parte crucial de la XAI es la presentación de las explicaciones de manera que sean comprendidas por los usuarios humanos. Esto frecuentemente implica:

- Visualización de Datos y Modelos: Gráficos interactivos, _heatmaps_, diagramas de flujos de decisión e interfaces gráficas que permiten a los usuarios explorar las decisiones del modelo.

- Ejemplos y Contraejemplos: Presentar ejemplos de datos que son similares a la entrada actual, pero que llevaron a una decisión diferente, puede ayudar al usuario a entender los límites de decisión del modelo.

- Interfaces Conversacionales: Desarrollar sistemas que permitan a los usuarios hacer preguntas sobre las decisiones del modelo en lenguaje natural y recibir explicaciones claras.

La elección de la técnica de XAI más adecuada depende del contexto, del tipo de modelo, del tipo de explicación necesaria (local o global) y del público objetivo de la explicación. La investigación en XAI es un campo vibrante, con nuevos enfoques surgiendo continuamente para hacer la inteligencia artificial cada vez más transparente y comprensible.

Desafíos en la Implementación de la XAI

A pesar del ímpetu y la importancia de la IA explicable XAI, su implementación no está exenta de desafíos complejos. La jornada para desvelar la “caja negra” está pavimentada con dilemas técnicos, éticos y prácticos que exigen una cuidadosa consideración.

Compensación entre Explicabilidad y Rendimiento/Complejidad

Quizás el desafío más fundamental sea la aparente compensación entre la explicabilidad de un modelo y su rendimiento predictivo o su complejidad. Los modelos de IA de alto rendimiento, como las redes neuronales profundas, son inherentemente complejos y, por ello, difíciles de explicar. Por otro lado, los modelos intrínsecamente explicables, como los árboles de decisión simples, pueden no alcanzar el mismo nivel de precisión en tareas complejas. El dilema es: ¿estamos dispuestos a sacrificar un poco de precisión para obtener más explicabilidad? La XAI busca desarrollar métodos que minimicen esta compensación, pero sigue siendo una consideración importante.

Dificultad de Estandarización y Evaluación

A diferencia de la precisión o el _recall_, que poseen métricas bien establecidas, la “explicabilidad” es un concepto subjetivo y multifacético. Lo que constituye una buena explicación para un especialista en IA puede ser incomprensible para un usuario final. No existe una métrica universalmente aceptada para cuantificar la explicabilidad de un modelo o la calidad de una explicación. Esto dificulta la comparación entre diferentes técnicas de XAI y la evaluación de la eficacia de las soluciones implementadas. La falta de estandarización también impide la creación de _benchmarks_ claros para el campo.

Interpretación Humana de las Explicaciones

Incluso cuando un sistema de XAI genera una explicación, la forma en que los humanos interpretan y utilizan esa explicación puede variar. La capacidad de un ser humano para entender una explicación depende de su nivel de conocimiento, contexto y sesgos cognitivos. Una explicación excesivamente técnica puede ser inútil para un lego, mientras que una explicación muy simplificada puede carecer de la profundidad necesaria para un especialista. Desarrollar interfaces y formatos de explicación que sean eficaces para diversos públicos es un desafío significativo. Además, la confianza excesiva en explicaciones parciales o mal interpretadas puede llevar a decisiones erróneas.

Costo Computacional y de Desarrollo

La aplicación de técnicas de XAI, especialmente los métodos _post-hoc_ como SHAP y LIME, puede ser computacionalmente intensiva. Generar explicaciones para cada predicción puede exigir un tiempo de procesamiento significativo, lo que puede ser prohibitivo en aplicaciones en tiempo real o con grandes volúmenes de datos. Además, el desarrollo y la integración de herramientas de XAI en _pipelines_ de IA existentes requieren _expertise_ y recursos adicionales, aumentando el costo total de desarrollo y mantenimiento.

Robustez y Fidelidad de las Explicaciones

Otro desafío es garantizar que las explicaciones generadas sean robustas y fieles al comportamiento subyacente del modelo. Técnicas como LIME y ANCHOR entrenan modelos _proxy_ locales, y la calidad de sus explicaciones depende de la fidelidad de esos modelos _proxy_. Pequeñas perturbaciones en la entrada pueden, en algunos casos, llevar a explicaciones inconsistentes, generando dudas sobre la fiabilidad de esas explicaciones. Garantizar que la explicación refleje fielmente el proceso de decisión de la “caja negra” es crucial.

Explicabilidad y Privacidad

En ciertos contextos, la explicabilidad puede entrar en conflicto con la privacidad de los datos. Para explicar una decisión, el sistema XAI puede necesitar exponer características sensibles de los datos de entrenamiento o de entrada que fueron cruciales para la predicción. En sectores como salud o finanzas, donde la privacidad es primordial, encontrar un equilibrio entre la necesidad de explicación y la protección de datos sensibles es un desafío complejo.

Superar estos desafíos exige no solo avances técnicos, sino también una colaboración multidisciplinar que involucre a científicos de datos, especialistas en ética, legisladores y diseñadores de interacción. La XAI es un campo en evolución, y la investigación y la innovación continuas son esenciales para abordar estas complejidades y realizar plenamente el potencial de una inteligencia artificial transparente y responsable.

XAI en la Práctica: Casos de Uso e Impacto Real

La IA explicable XAI no es solo un área de investigación teórica; se está aplicando en diversos sectores, transformando la forma en que interactuamos con la IA y garantizando que sus aplicaciones sean más seguras, justas y eficaces. La capacidad de desvelar la “caja negra” tiene un impacto real y tangible en varias áreas críticas.

Medicina y Salud

En medicina, la IA es cada vez más utilizada para diagnóstico, descubrimiento de fármacos y planificación de tratamientos personalizados. Sin embargo, un médico nunca aceptará una recomendación ciega de una máquina. La XAI es vital para:

- Diagnóstico Mejorado: Un sistema de IA que diagnostica una enfermedad puede usar XAI para resaltar las regiones específicas en una imagen médica (rayos X, resonancia magnética) que llevaron al diagnóstico. Por ejemplo, en oncología, la IA puede identificar patrones sutiles en biopsias, y la XAI puede señalar qué células o texturas contribuyeron a la detección de un tumor, permitiendo que el patólogo valide y entienda la decisión.

- Tratamiento Personalizado: Al recomendar un plan de tratamiento, la XAI puede explicar por qué ciertas características del paciente (edad, historial familiar, comorbilidades) fueron más influyentes en la sugerencia de un determinado medicamento o terapia. Esto ayuda a los médicos a tomar decisiones informadas y a justificar el tratamiento a los pacientes.

- Descubrimiento de Medicamentos: La XAI puede ayudar a identificar qué propiedades moleculares son más relevantes para la eficacia de un nuevo fármaco, acelerando la investigación y reduciendo costos.

Finanzas y Servicios Bancarios

El sector financiero depende en gran medida de algoritmos de IA para la detección de fraudes, la evaluación crediticia y la negociación algorítmica. La explicabilidad es esencial para la confianza y el cumplimiento:

- Evaluación Crediticia: Cuando una solicitud de préstamo es denegada, la XAI puede explicar los factores que llevaron a la decisión, como un bajo puntaje de crédito, una alta tasa de endeudamiento o un historial de pagos atrasados. Esto no solo cumple requisitos regulatorios (como el derecho a una explicación) sino que también permite que el solicitante entienda cómo mejorar su elegibilidad.

- Detección de Fraude: Un sistema de IA que señala una transacción como fraudulenta puede usar XAI para mostrar por qué esa transacción es atípica – por ejemplo, un valor muy alto para el historial del cliente, una ubicación inusual o un tipo de compra no habitual. Esto ayuda a los analistas de fraude a investigar casos específicos con mayor eficiencia.

- Cumplimiento Normativo: Las instituciones financieras necesitan justificar sus decisiones ante auditores y organismos reguladores. La XAI proporciona la pista de auditoría y la transparencia necesarias.

Justicia y Derecho

La aplicación de la IA en sistemas de justicia penal (predicción de reincidencia, recomendación de sentencias) plantea serias preocupaciones éticas sobre sesgos y justicia. La XAI busca mitigar estos riesgos:

- Predicción de Riesgo de Reincidencia: Los algoritmos pueden ser utilizados para predecir la probabilidad de que un acusado reincida. La XAI puede indicar qué factores (edad, historial criminal, estado laboral) influyeron en esa predicción, permitiendo que jueces y asistentes sociales consideren la información con una comprensión crítica y eviten sesgos sistémicos. Es crucial que la decisión final sea humana y que la IA sirva como un apoyo comprensible.

- Análisis de Evidencia: En casos complejos, la IA puede ayudar a analizar grandes volúmenes de evidencia. La XAI puede resaltar qué fragmentos de texto, imágenes o datos son más relevantes para una conclusión, ayudando a abogados e investigadores.

Vehículos Autónomos

La seguridad es la preocupación primordial en los vehículos autónomos. Cuando un coche autónomo toma una decisión crítica (frenar, desviarse, acelerar), es imperativo entender el porqué:

- Decisiones de Conducción: Si un vehículo autónomo frena bruscamente, la XAI puede explicar que el sistema de visión detectó a un niño entrando en la calzada, mientras otros sensores confirmaron la proximidad del peligro. Esto es crucial para la depuración (_debugging_), validación y, en caso de accidentes, para la atribución de responsabilidad.

- Detección de Obstáculos: La XAI puede mostrar qué píxeles en la imagen de la cámara fueron interpretados como un peatón o un obstáculo, validando la percepción del sistema.

Recursos Humanos

La IA se utiliza en reclutamiento y selección, pero el riesgo de perpetuar sesgos de género, raza o edad es alto:

- Selección de Candidatos: Si un algoritmo de IA sugiere un candidato para una vacante, la XAI puede explicar por qué ese perfil fue seleccionado, resaltando habilidades, experiencia y calificaciones relevantes, en lugar de características irrelevantes que podrían introducir sesgos. Esto ayuda a garantizar procesos de contratación más justos y transparentes.

Estos ejemplos ilustran cómo la IA explicable XAI se está convirtiendo en una herramienta indispensable para construir sistemas de IA que no son solo poderosos y eficientes, sino también confiables, justos y aceptables por la sociedad. Al desmitificar la “caja negra”, la XAI permite que la inteligencia artificial alcance su potencial máximo de forma ética y responsable.

El Futuro de la XAI: Tendencias y Perspectivas

El campo de la IA explicable XAI está en constante evolución, impulsado por la creciente demanda de transparencia y responsabilidad en los sistemas de inteligencia artificial. El futuro de la XAI promete ser vibrante, con nuevos enfoques y una integración cada vez mayor con el ciclo de vida del desarrollo de la IA.

Una de las principales tendencias es el desarrollo de **modelos intrínsecamente más explicables**. En lugar de solo aplicar técnicas _post-hoc_ a modelos complejos, la investigación se está concentrando en construir arquitecturas de IA que son transparentes desde el diseño, sin comprometer significativamente el rendimiento. Esto incluye redes neuronales que incorporan módulos interpretables o que se basan en mecanismos de atención que son más fácilmente visualizables. La idea es que la explicabilidad no sea una “característica” añadida al final, sino una propiedad fundamental del sistema.

Otra área de foco es la **XAI centrada en el usuario**. Reconociendo que diferentes públicos (desarrolladores, reguladores, usuarios finales) tienen diferentes necesidades de explicación, el futuro de la XAI implicará la creación de interfaces y herramientas que adapten las explicaciones al nivel de conocimiento y al contexto del usuario. Esto puede incluir explicaciones interactivas, visualizaciones personalizables e incluso sistemas de diálogo que permitan a los usuarios hacer preguntas sobre las decisiones de la IA y recibir respuestas comprensibles. La calidad de la explicación será evaluada no solo por su precisión técnica, sino por su utilidad y comprensibilidad para el público objetivo.

La **integración de la XAI con el ciclo de vida de MLOps (_Machine Learning Operations_)** también es crucial. La explicabilidad no debe ser un proceso aislado, sino parte integrante de cada etapa, desde la recopilación y el preprocesamiento de datos (para identificar sesgos), pasando por el entrenamiento y validación del modelo, hasta la implementación y el monitoreo continuo. Las herramientas que automatizan la generación de explicaciones y las incorporan en paneles de monitoreo permitirán a los equipos de MLOps identificar rápidamente problemas de rendimiento o de sesgo en producción.

Además, habrá un avance en la **formalización y estandarización de las métricas de explicabilidad**. A medida que la investigación madure, surgirán métodos más robustos para cuantificar y comparar la calidad de las explicaciones, permitiendo que los desarrolladores elijan los mejores enfoques para sus casos de uso y que los reguladores evalúen el cumplimiento.

La investigación en XAI también se profundizará en la **comprensión de la intersección entre explicabilidad, robustez y seguridad**. Los modelos explicables son, en muchos casos, más fáciles de auditar y, por lo tanto, potencialmente más seguros contra ataques adversariales. La XAI puede ser una herramienta poderosa para entender las vulnerabilidades de un modelo y desarrollar defensas más eficaces.

Finalmente, la **colaboración multidisciplinar** seguirá siendo un pilar fundamental. El futuro de la XAI no está solo en manos de científicos de la computación, sino también de psicólogos cognitivos (para entender cómo los humanos interpretan las explicaciones), especialistas en ética (para definir qué es una explicación “justa” o “responsable”), sociólogos y legisladores. Este enfoque holístico garantizará que la XAI se desarrolle de manera que sirva verdaderamente a la sociedad.

En resumen, el futuro de la XAI es el futuro de una inteligencia artificial más responsable, transparente y alineada con los valores humanos. Al esforzarnos por construir IAs que puedan explicarse a sí mismas, no solo estamos haciendo que las máquinas sean más comprensibles, sino también construyendo un ecosistema tecnológico más confiable y ético para todos.

La jornada para desvelar la “caja negra” de la inteligencia artificial es, sin duda, uno de los mayores desafíos y, al mismo tiempo, una de las mayores oportunidades de la era digital. Conforme explorado en este artículo, la necesidad de la IA explicable (XAI) trasciende la mera curiosidad técnica; es un pilar fundamental para la construcción de un futuro donde la inteligencia artificial pueda ser plenamente confiable, ética y aceptada por la sociedad. Desde la garantía del cumplimiento normativo y la mitigación de sesgos hasta la mejora del rendimiento de los modelos y la facilitación de la toma de decisiones críticas en sectores como la salud y las finanzas, la XAI demuestra ser indispensable. No se trata solo de entender _qué_ hace la IA, sino, crucialmente, _por qué_ lo hace, transformando un sistema enigmático en un socio comprensible y responsable.

Los avances en técnicas de XAI, ya sean basadas en modelos intrínsecamente explicables o en enfoques _post-hoc_ como LIME y SHAP, están allanando el camino para una nueva generación de sistemas de IA. Sin embargo, los desafíos persisten, desde la compensación entre explicabilidad y rendimiento hasta la estandarización y la interpretación humana de las explicaciones. Superar estas barreras exigirá un esfuerzo continuo de investigación, desarrollo y un enfoque multidisciplinar que integre conocimientos de ciencia de la computación, ética, psicología y derecho. La buena noticia es que el compromiso global con una IA responsable está fortaleciendo la investigación en XAI, prometiendo soluciones innovadoras que harán los sistemas de IA cada vez más transparentes y accesibles. Para profundizar su conocimiento sobre el papel de la explicabilidad en la ética de la IA, puede consultar estudios y publicaciones sobre el tema, como el análisis de la importancia de la XAI para la confianza y la ética en documentos como el “Libro Blanco sobre la Inteligencia Artificial – Un enfoque europeo de la excelencia y la confianza” de la Comisión Europea, disponible en el sitio web oficial de la Unión Europea sobre el futuro de la IA.

El futuro de la inteligencia artificial es inseparable de la XAI. A medida que la IA se vuelve más omnipresente e influyente, la capacidad de explicar sus decisiones no será solo un diferenciador, sino un requisito esencial. Desarrolladores, empresas, reguladores y el público en general tienen un papel crucial que desempeñar en la promoción de una cultura de explicabilidad y transparencia. Al invertir en IA explicable XAI, estamos invirtiendo no solo en tecnología, sino en la confianza, la justicia y la integridad de un futuro impulsado por la inteligencia artificial. La “caja negra” está siendo abierta, y lo que encontremos dentro de ella definirá la próxima era de la innovación en IA, garantizando que las máquinas sirvan a la humanidad de manera más inteligente y comprensible. Para una visión técnica detallada sobre las últimas tendencias en algoritmos de XAI y sus aplicaciones, artículos académicos en plataformas como arXiv, frecuentemente citados en investigaciones de vanguardia, ofrecen _insights_ valiosos sobre el estado actual del arte.

Share this content:

Publicar comentário