IA y el Poder Central: Desentrañando la Propuesta de Regulación Nacional Única en EE. UU.

La Inteligencia Artificial (IA) ya no es una ciencia ficción distante; está intrínsecamente tejida en el tejido de nuestra sociedad, desde algoritmos que recomiendan películas hasta sistemas complejos que guían vehículos autónomos y diagnostican enfermedades. Con su ascenso meteórico, surge una pregunta fundamental: ¿cómo debemos gobernar esta fuerza transformadora? El debate sobre la regulación de la Inteligencia Artificial está encendido en todo el mundo, y en Estados Unidos, esta discusión adquiere contornos específicos con la histórica tensión entre el poder federal y la autonomía de los estados.

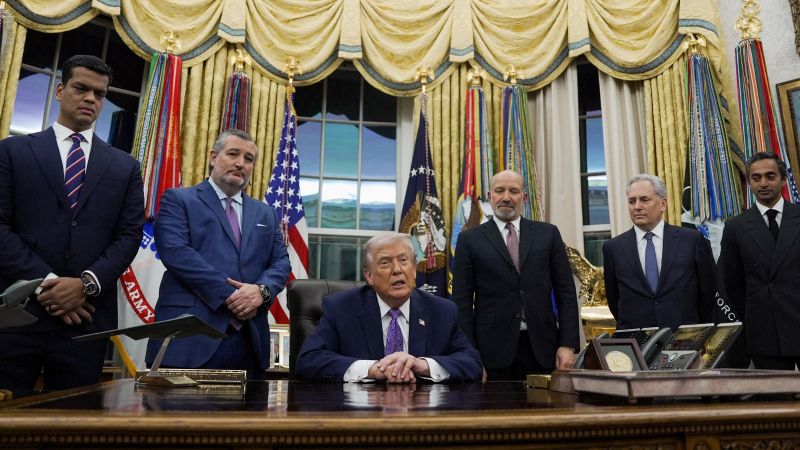

Imagine el escenario: el 11 de diciembre de 2025, un anuncio que reverberó por los pasillos del poder y por los centros de innovación tecnológica. El entonces presidente Donald Trump firma una orden ejecutiva que no solo buscaba impedir que los estados implementaran sus propias regulaciones sobre Inteligencia Artificial, sino que también tenía como objetivo crear un “marco nacional único” para la IA en todo el país. Aunque estamos en un momento diferente, la propuesta hipotética de 2025 nos ofrece una lente poderosa para examinar uno de los dilemas más apremiantes de la era digital: ¿quién debe dictar las reglas para la tecnología que moldea nuestro futuro?

Esta medida hipotética, en su esencia, busca centralizar el enfoque regulatorio de una tecnología compleja y multifacética. Por un lado, promete claridad y uniformidad; por otro, plantea cuestiones críticas sobre la adaptabilidad, la especificidad regional y la propia esencia de la innovación. En este artículo, vamos a sumergirnos en las profundidades de esta propuesta, explorando el impacto potencial de un modelo de regulación de la Inteligencia Artificial nacional en Estados Unidos, sus desafíos, sus promesas y lo que podemos aprender de esta discusión para Brasil y el mundo.

Regulación de la Inteligencia Artificial: El Impasse Federal vs. Estatal

La idea de una orden ejecutiva federal para anular las regulaciones estatales sobre IA no es solo un movimiento político audaz; es un reflejo de un dilema inherente al sistema federativo estadounidense y un punto de inflexión crucial en la gobernanza tecnológica. Históricamente, los estados estadounidenses han desempeñado un papel vital en la experimentación e implementación de leyes que responden a las necesidades locales y a las preocupaciones de los ciudadanos. Esto es evidente en áreas como la privacidad de datos (con la Ley de Privacidad del Consumidor de California, CCPA, como un ejemplo prominente), la seguridad de datos e incluso en regulaciones sobre vehículos autónomos.

La lógica detrás de la autonomía estatal es que diferentes regiones pueden tener diferentes prioridades, economías y sensibilidades culturales que exigen enfoques regulatorios distintos. Por ejemplo, un estado con una fuerte base agrícola puede tener preocupaciones diferentes sobre el uso de la IA en la agricultura que un estado con un ecosistema tecnológico robusto enfocado en software y servicios. Esta diversidad permite que los estados actúen como “laboratorios de democracia”, probando nuevos enfoques antes de que sean potencialmente adoptados a nivel nacional.

Sin embargo, la fragmentación regulatoria tiene su talón de Aquiles. Para las empresas que operan en múltiples estados –o, de hecho, a nivel nacional–, navegar por un entramado de reglas distintas puede ser una pesadilla logística y financiera. Imagine una startup de IA desarrollando una nueva herramienta de diagnóstico médico: tendría que adaptarse a 50 conjuntos diferentes de directrices de privacidad, seguridad, sesgo y responsabilidad, añadiendo una capa abrumadora de complejidad y costo. Esta es la principal argumentación a favor de un “marco nacional único” para la regulación de la Inteligencia Artificial.

Los defensores del enfoque federal argumentan que una estructura única no solo simplificaría el cumplimiento para las empresas, sino que también impulsaría la innovación, crearía un campo de juego equitativo y garantizaría que EE. UU. pudiera competir efectivamente en el escenario global de la IA. Al evitar la creación de “islas regulatorias”, el país podría consolidar sus recursos, establecer estándares nacionales de seguridad y ética, y presentar un frente unificado en discusiones internacionales sobre la gobernanza de la IA. La cuestión central, entonces, no es si la IA necesita regulación, sino qué nivel de gobierno está más apto para proveerla de forma eficaz y justa.

Los Desafíos y Oportunidades de un Marco Regulatorio Nacional Único

La centralización de la regulación de la Inteligencia Artificial por medio de un marco nacional único presenta tanto oportunidades como desafíos significativos. Comprender ambos lados es crucial para evaluar el impacto real de tal política.

Oportunidades de un Enfoque Unificado:

1. **Claridad y Simplificación:** Para las empresas, especialmente startups y Pequeñas y Medianas Empresas (PYMES), un conjunto único de reglas significa menos complejidad, costos reducidos de cumplimiento y mayor previsibilidad jurídica. Esto puede liberar recursos que se gastarían en burocracia para ser invertidos en investigación, desarrollo e innovación.

2. **Competitividad Nacional y Global:** Un estándar regulatorio unificado puede fortalecer la posición de EE. UU. como líder global en IA. Permite que las empresas escalen más rápidamente, atrae inversiones extranjeras y facilita la colaboración en proyectos de gran envergadura que benefician a la nación en su conjunto, como la IA para la defensa o la infraestructura crítica.

3. **Seguridad y Ética Coherentes:** Cuestiones como los sesgos algorítmicos, la privacidad de datos y la ciberseguridad en sistemas de IA son universales. Un marco federal puede establecer directrices robustas y consistentes para auditoría, pruebas y mitigación de riesgos, protegiendo a los ciudadanos de forma uniforme en todo el país. Además, puede acelerar el desarrollo de estándares técnicos, como los propuestos por el NIST (National Institute of Standards and Technology).

4. **Asignación de Recursos:** El gobierno federal tiene la capacidad de movilizar recursos significativamente mayores para investigación, desarrollo de políticas y fiscalización que cualquier estado individualmente. Esto puede llevar a una implementación más eficaz y a un monitoreo más riguroso del cumplimiento.

Desafíos Inherentes a la Centralización:

1. **Riesgo de “Talla Única”:** La IA es un campo vasto y diversificado. Una regulación única puede no ser capaz de abordar los matices de sectores específicos (salud, finanzas, transporte, militar) o las particularidades regionales. Lo que funciona para la IA en vehículos autónomos puede ser inadecuado para la IA en el reclutamiento de personal, por ejemplo. Esto puede llevar a una regulación excesivamente laxa en algunas áreas críticas o excesivamente restrictiva en otras, sofocando la innovación.

2. **Lentitud y Burocracia Federal:** El proceso legislativo y regulatorio a nivel federal es notoriamente lento y sujeto a influencias políticas. En un campo tan dinámico como la IA, donde las tecnologías evolucionan cada mes, una estructura regulatoria rígida y demorada corre el riesgo de volverse obsoleta incluso antes de ser totalmente implementada. La agilidad de los estados permite respuestas más rápidas a las innovaciones.

3. **Pérdida de Experimentación Estatal:** Al bloquear las regulaciones estatales, se pierde la valiosa oportunidad de probar diferentes enfoques regulatorios a menor escala. Los estados pueden actuar como incubadoras de políticas, permitiendo que el gobierno federal observe lo que funciona y lo que no funciona antes de implementar una ley en todo el país.

4. **Concentración de Poder e Influencia:** Una estructura regulatoria federal única puede ser más susceptible a la influencia de grandes empresas de tecnología, que poseen los recursos para hacer lobby en Washington. Esto puede resultar en leyes que favorecen a los actores establecidos en detrimento de startups e innovadores más pequeños, que pueden no tener voz en la capital federal.

En última instancia, la creación de un marco nacional para la regulación de la Inteligencia Artificial es un acto de equilibrio delicado. Requiere una visión que sea lo suficientemente robusta para proteger a los ciudadanos y promover la confianza, pero lo suficientemente flexible para no sofocar la innovación y adaptarse a un futuro tecnológico en constante cambio.

Más Allá de las Fronteras: La Gobernanza de la IA en un Escenario Global

La discusión sobre la regulación de la Inteligencia Artificial en Estados Unidos no ocurre en un vacío. Por el contrario, se inserta en un contexto global donde diferentes bloques económicos y países están adoptando enfoques variados para gobernar la IA. Comprender estos modelos internacionales es fundamental para contextualizar la propuesta estadounidense de un marco nacional único y para entender las implicaciones en el escenario mundial.

Unión Europea: El Enfoque Basado en Riesgo

La Unión Europea está a la vanguardia de la regulación de la IA con su propuesta de AI Act (Ley de IA). Este es un marco regulatorio integral que adopta un enfoque basado en riesgo, categorizando los sistemas de IA de acuerdo con el nivel de riesgo que representan para los derechos fundamentales y la seguridad de los ciudadanos. Los sistemas de IA de “alto riesgo” (como aquellos utilizados en reclutamiento, aplicación de la ley o infraestructura crítica) enfrentan requisitos rigurosos de evaluación de cumplimiento, transparencia, supervisión humana y gobernanza de datos. La UE busca establecer un estándar de oro global, promoviendo una IA confiable y centrada en el ser humano, aunque enfrenta críticas sobre el potencial de sofocar la innovación debido a su rigidez.

China: Control Estatal y Desarrollo Impulsado

En contraste, China adopta un enfoque más pragmático y orientado al control estatal. Aunque ha implementado regulaciones para áreas específicas como algoritmos de recomendación, reconocimiento facial y deepfakes, el enfoque principal es aprovechar el poder de la IA para la prosperidad económica, la seguridad nacional y la vigilancia social. La regulación de la Inteligencia Artificial en China es frecuentemente interpretada como un medio para mantener el control sobre la sociedad e impulsar el liderazgo tecnológico global, con menor énfasis en libertades individuales en comparación con las preocupaciones occidentales.

El Escenario Global y la Necesidad de Cooperación

Estos enfoques dispares destacan la complejidad de establecer normas globales para la IA. La propuesta estadounidense de un marco nacional único se alinea con el deseo de simplificación y promoción de la innovación, haciendo eco en parte de la preocupación de China por la competitividad, pero también de la búsqueda de la UE por seguridad y ética, aunque con una metodología diferente.

Sin embargo, la IA es una tecnología sin fronteras. Un modelo de IA entrenado en un país puede ser fácilmente implementado en otro. Los datos de usuarios pueden transitar por diversas jurisdicciones. Esto subraya la necesidad crítica de cooperación internacional. Organizaciones como la UNESCO, la OCDE y el G7/G20 están activamente involucradas en la elaboración de principios éticos y directrices para la IA, buscando un terreno común que pueda harmonizar, en cierta medida, los diferentes enfoques regulatorios. La falta de coordinación global puede llevar a un “parche regulatorio”, dificultando la innovación responsable y la protección efectiva de los derechos humanos a escala global.

El Papel de la Ética y la Transparencia

Además de las cuestiones geográficas, la gobernanza de la IA está intrínsecamente ligada a imperativos éticos. ¿Qué significa una IA justa? ¿Cómo garantizamos que los algoritmos sean transparentes y explicables? ¿Cómo abordamos el sesgo algorítmico, que puede perpetuar o amplificar prejuicios existentes en la sociedad? ¿Y cómo responsabilizamos a los desarrolladores y usuarios por sistemas de IA que causan daños?

Una estructura de regulación de la Inteligencia Artificial, ya sea federal o regional, necesita incorporar principios de responsabilidad, transparencia, auditabilidad, justicia y seguridad. Solo así podremos construir la confianza pública necesaria para la adopción generalizada y beneficiosa de la IA, garantizando que el progreso tecnológico esté alineado con los valores humanos fundamentales.

Impacto en el Ecosistema de Innovación y el Futuro de la IA

Una orden ejecutiva federal para la regulación de la Inteligencia Artificial tendría un impacto profundo y multifacético en el vibrante ecosistema de innovación de Estados Unidos. Para las grandes corporaciones de tecnología, con sus ejércitos de abogados y cabilderos, un marco regulatorio federal puede ser incluso bienvenido, pues ofrece una única “puerta de entrada” para influir y navegar. Esto podría, paradójicamente, solidificar el poder de gigantes como Google, Microsoft, Amazon y Meta, que tienen los recursos para adaptarse rápidamente y quizás incluso moldear las nuevas reglas a su favor, creando barreras de entrada para competidores más pequeños.

Para las startups, sin embargo, el escenario es más complejo. Aunque la simplificación de las reglas pueda parecer una bendición, la rigidez de una regulación federal única, si está mal concebida, podría sofocar la experimentación y la agilidad que son el oxígeno del sector tecnológico. Las pequeñas empresas prosperan con la capacidad de innovar rápidamente e iterar sus productos. Un proceso de cumplimiento demorado u oneroso puede desviar recursos preciosos de I+D, dificultando el surgimiento de la próxima gran idea en IA.

Es vital que cualquier marco regulatorio nacional incorpore mecanismos de flexibilidad, como los “sandboxes” regulatorios. Estos son entornos controlados donde las empresas pueden probar innovaciones de IA bajo supervisión, pero con menos restricciones que las reglas generales. Esto permitiría que las nuevas tecnologías maduraran sin el peso total del cumplimiento inicial, al mismo tiempo que ofrece a los reguladores valiosos insights sobre cómo la IA está evolucionando y qué reglas son realmente necesarias.

Además, el debate sobre la regulación de la Inteligencia Artificial no se reduce solo a gobiernos y empresas. La sociedad civil, académicos y especialistas en ética de la IA desempeñan un papel crucial. La inclusión de diversas perspectivas en el proceso de elaboración de políticas es fundamental para garantizar que las regulaciones sean equilibradas, justas y representen los intereses de todos los ciudadanos, no solo los de grandes actores de la industria.

El futuro de la IA, tanto en EE. UU. como globalmente, dependerá mucho de cómo se resuelvan estas complejas cuestiones regulatorias. Necesitamos un equilibrio delicado: reglas que protejan a los individuos, promuevan la innovación responsable y garanticen que la IA sirva al bien común. La lección de una orden ejecutiva de 2025, hipotética o no, es que la gobernanza de la IA es un campo de batalla para las ideas y un desafío constante para la diplomacia y la sabiduría política.

Conclusión: Construyendo Puentes en un Futuro Impulsado por la IA

La discusión hipotética en torno a una orden ejecutiva federal de 2025 para unificar la regulación de la Inteligencia Artificial en Estados Unidos, bloqueando las leyes estatales, sirve como un poderoso catalizador para un debate más amplio y urgente. Nos fuerza a confrontar la intrincada danza entre el avance tecnológico y la necesidad de gobernanza. Si bien la promesa de un marco nacional único ofrece la seducción de la simplicidad y la eficiencia para impulsar la innovación y la competitividad global, también plantea preocupaciones legítimas sobre la pérdida de flexibilidad, la especificidad regional y el riesgo de un enfoque de “talla única” en un campo tan diverso y dinámico.

El futuro de la IA no será moldeado por una sola nación o por un solo conjunto de reglas, sino por un diálogo continuo y adaptativo que trasciende fronteras geográficas y políticas. La experiencia global nos muestra que no hay una solución única para la regulación de la Inteligencia Artificial; en cambio, existen múltiples caminos, cada uno con sus propios méritos y desafíos. Para Brasil y otras naciones, la lección es clara: al desarrollar nuestros propios enfoques, debemos aprender de las experiencias ajenas, buscar el equilibrio entre la protección de los ciudadanos y la promoción de la innovación, y, sobre todo, garantizar que la IA sea una fuerza para el bien, guiada por principios éticos y centrada en el ser humano. El gran desafío ahora es construir esos puentes de entendimiento y colaboración para un futuro donde la inteligencia artificial pueda prosperar de forma responsable y equitativa.

Share this content:

Publicar comentário