La Verdad Detrás de OpenAI: Lo que Elon Musk Omitió Contar

La inteligencia artificial (IA) es, sin duda, uno de los temas más candentes e impactantes de nuestra era. Desde asistentes virtuales hasta sistemas complejos de reconocimiento de patrones, la IA está redefiniendo lo que es posible. En el centro de esta revolución, OpenAI, la empresa detrás de ChatGPT y DALL-E, ha emergido como un gigante. Pero su historia, especialmente su génesis y evolución, es más compleja de lo que muchos imaginan, y las recientes disputas legales han sacado a la luz narrativas conflictivas.

Recientemente, Elon Musk, una figura prominente en el panorama tecnológico y uno de los cofundadores de OpenAI, interpuso una demanda contra la empresa, alegando que esta se desvió de su misión original sin fines de lucro. Sin embargo, la “verdad” en cualquier disputa rara vez es unilateral, y los documentos y correos electrónicos que salieron a la luz en respuesta a la demanda de Musk pintan un cuadro más matizado – revelando aspectos que, convenientemente, fueron omitidos en su petición judicial. Sumerjámonos en la historia y desvelemos La Verdad sobre OpenAI, desde sus ideales altruistas hasta los desafíos pragmáticos de construir el futuro de la IA.

La Verdad sobre OpenAI: La Génesis Idealista y la Misión Altruista

En 2015, la fundación de OpenAI fue un hito ambicioso. Nombres como Elon Musk, Sam Altman, Greg Brockman, Ilya Sutskever, Wojciech Zaremba y John Schulman unieron fuerzas con un objetivo singular y audaz: desarrollar la inteligencia artificial general (AGI) de forma segura y para el beneficio de toda la humanidad, no solo de unos pocos. En aquel entonces, existía una creciente preocupación de que gigantes tecnológicos, como Google y Facebook, pudieran monopolizar el desarrollo de la IA, creando sistemas potentes sin la debida supervisión o consideración por los riesgos sociales. OpenAI nació como un contrapeso, una fuerza para democratizar el acceso a la IA avanzada y asegurar que su poder se distribuyera de forma equitativa.

La visión original era utópica en su esencia. La organización fue establecida como una entidad sin fines de lucro, con la promesa de que sus investigaciones y tecnologías serían “abiertas” – de ahí el nombre “OpenAI” – para que la comunidad global pudiera inspeccionar, aprender y contribuir a su desarrollo. El objetivo era prevenir escenarios distópicos donde la IA pudiera ser utilizada para beneficio privado o, peor aún, para control. Elon Musk, uno de los principales donantes y el primer CEO, invirtió decenas de millones de dólares y aportó su reputación de visionario, con la convicción expresa de que la AGI era demasiado potente para ser controlada por una única entidad con fines de lucro. Él creía firmemente que la IA debería ser una herramienta para elevar la civilización, no para enriquecer corporaciones.

Los primeros años de OpenAI estuvieron marcados por un espíritu de colaboración e investigación pura. Científicos e ingenieros renombrados fueron atraídos por la misión, trabajando en proyectos innovadores que impulsarían la frontera de la IA. La comunidad esperaba que la organización establecería un precedente para el desarrollo ético y transparente de la tecnología más transformadora de la historia. Sin embargo, la realidad del costo astronómico de investigación y desarrollo en IA pronto comenzaría a desafiar esta visión idealista.

El Giro Lucrativo: Del Idealismo al Pragmatismo con Microsoft

A medida que la investigación en inteligencia artificial avanzaba, especialmente en el campo del aprendizaje automático y las redes neuronales profundas, los costos involucrados escalaron exponencialmente. Entrenar modelos de IA de vanguardia requiere una cantidad colosal de poder computacional, lo que se traduce en millones de dólares en hardware y electricidad. Además, para atraer y retener a los mejores talentos en un mercado competitivo dominado por empresas como Google y Meta, OpenAI necesitaba recursos que una estructura puramente sin fines de lucro no podía sostener. Los salarios de los principales investigadores en IA pueden alcanzar fácilmente los siete dígitos anuales, y la batalla por estos profesionales es feroz.

Fue en este contexto que, en 2018, Elon Musk dejó el consejo de OpenAI. En documentos posteriores, OpenAI alegó que Musk había propuesto que la empresa se convirtiera en una entidad con fines de lucro bajo su control mayoritario, algo que no se alineaba con la visión de los otros fundadores de una organización más distribuida y centrada en la misión. Con la salida de Musk y la creciente necesidad de capital, el liderazgo de OpenAI, incluido Sam Altman, tomó una decisión pragmática y controvertida en 2019: crear una nueva entidad, OpenAI LP, con una estructura de “lucro limitado” (capped-profit). Esta estructura permitía que la empresa recaudara miles de millones de dólares en inversiones, pero con un límite en los retornos que los inversores podían recibir, manteniendo parte del espíritu original de que el lucro no sería el objetivo final e ilimitado.

Este cambio fue crucial y abrió las puertas a una asociación estratégica con Microsoft. Microsoft invirtió miles de millones de dólares en OpenAI, proporcionando no solo capital, sino también acceso a sus vastos recursos de computación en la nube (Azure), que se convirtieron en la columna vertebral para el entrenamiento de modelos masivos como GPT-3 y, posteriormente, ChatGPT. Esta colaboración permitió a OpenAI lograr hazañas que serían imposibles como una pequeña organización sin fines de lucro. ChatGPT, lanzado en 2022, no solo demostró el poder transformador de la IA generativa para millones de personas, sino que también validó el modelo de negocio híbrido de OpenAI, demostrando que la inversión en investigación de vanguardia puede llevar a productos exitosos que impactan el mundo.

La asociación con Microsoft, aunque vital para el crecimiento de OpenAI, también se convirtió en uno de los puntos centrales de la disputa de Elon Musk. Él argumenta que esta asociación transformó a OpenAI en una “subsidiaria de facto” de Microsoft, traicionando su misión original de ser una organización independiente sin fines de lucro. Sin embargo, OpenAI defiende que esta colaboración fue una necesidad estratégica para cumplir su misión de forma efectiva, dadas las realidades financieras y tecnológicas del desarrollo de la AGI.

La Demanda de Elon Musk y los Desafíos de la AGI Segura

La demanda legal interpuesta por Elon Musk en marzo de 2024 contra OpenAI, Sam Altman y Greg Brockman es un capítulo intrigante en la saga de la empresa. Musk alega una “violación de contrato” y una “traición a la misión fundacional”, afirmando que OpenAI abandonó su compromiso de desarrollar la AGI para el beneficio de la humanidad, priorizando el lucro y la colaboración con Microsoft. Él argumenta que el modelo de “código cerrado” adoptado para muchos de los avances de OpenAI es antitético a su promesa de ser “abierta”.

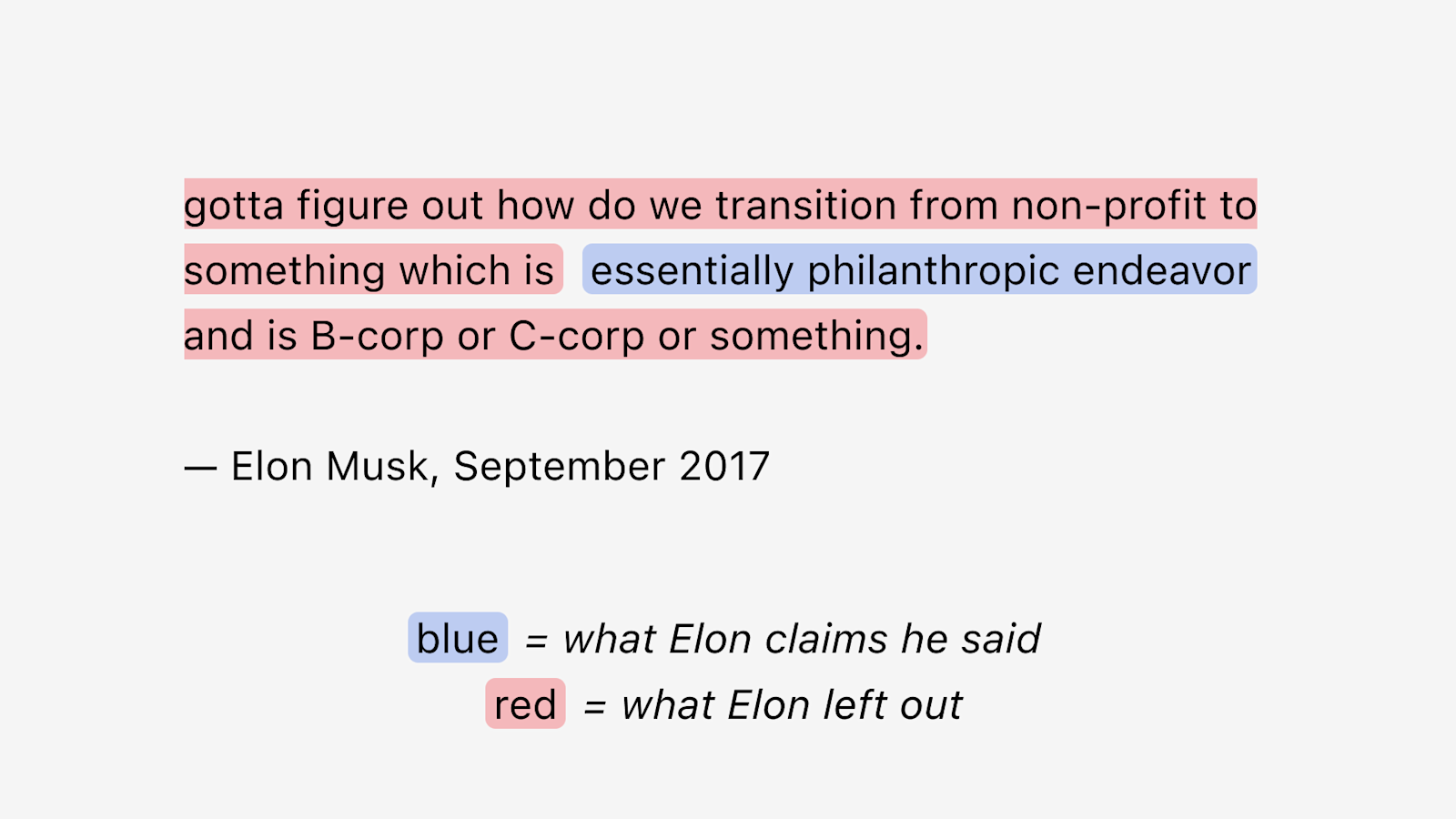

Sin embargo, la respuesta de OpenAI sacó a la luz correos electrónicos y conversaciones que sugieren que las propias visiones de Musk sobre la estructura y la financiación de la organización eran fluidas y, a veces, contradictorias a su discurso actual. OpenAI divulgó comunicaciones internas que indican que Musk, en varios momentos, propuso la fusión de OpenAI con Tesla, la obtención de una participación mayoritaria en OpenAI, e incluso la creación de una entidad con fines de lucro mucho antes de la formación de OpenAI LP en 2019. Estas revelaciones son el núcleo de la “verdad que Elon omitió” – una narrativa que sugiere que el deseo de comercialización y el reconocimiento de los desafíos financieros no eran ajenos al propio Musk.

Este enfrentamiento legal no es solo sobre dinero o control; toca cuestiones fundamentales sobre el futuro de la inteligencia artificial. ¿Cómo podemos garantizar que la AGI, una vez alcanzada, sea desarrollada y utilizada de forma ética y segura? ¿Quién debe tener el control sobre esta tecnología transformadora? La tensión entre el desarrollo “abierto” versus “cerrado” es central. Aunque OpenAI ha mantenido algunas de sus investigaciones abiertas, la naturaleza competitiva y los riesgos de uso indebido de modelos superinteligentes llevaron a un enfoque más cauteloso en relación con la apertura total de algunos de sus sistemas más avanzados.

La preocupación por la seguridad de la IA es un tema legítimo y ampliamente discutido en la comunidad. La idea de que la AGI debe ser desarrollada con extrema cautela, con mecanismos de seguridad robustos y principios éticos claros, es compartida por muchos, incluida la propia OpenAI e incluso Musk. El desafío es cómo equilibrar esta cautela con la presión incesante por la innovación y el costo prohibitivo de la investigación a gran escala. El caso Musk vs. OpenAI sirve como un recordatorio contundente de las complejidades involucradas en la gobernanza de la IA y en la búsqueda de un equilibrio entre idealismo, pragmatismo y responsabilidad.

El Futuro de la Inteligencia Artificial: Entre el Lucro y el Propósito

La disputa entre Elon Musk y OpenAI trasciende las cuestiones legales y financieras, poniendo en evidencia un debate mayor sobre el futuro de la inteligencia artificial. ¿Qué significa desarrollar la AGI “para el beneficio de la humanidad” en un mundo movido por intereses comerciales y presiones competitivas? El ascenso de la IA generativa, ejemplificado por el éxito de ChatGPT, demuestra el inmenso potencial de la tecnología para revolucionar industrias, mejorar la educación e incluso democratizar el acceso al conocimiento. Sin embargo, también plantea serias preocupaciones sobre desinformación, sesgos algorítmicos y el impacto en el mercado laboral.

Empresas como OpenAI, Google DeepMind y Anthropic están a la vanguardia de esta carrera tecnológica. Cada una de ellas enfrenta el dilema de cómo financiar la investigación intensiva en IA mientras se adhiere a principios éticos y de seguridad. El enfoque de “lucro limitado” de OpenAI fue un intento de navegar por este terreno complejo, permitiendo la inversión masiva necesaria para la AGI sin ceder totalmente a los imperativos del lucro ilimitado. Es una experiencia en curso, y su éxito o fracaso tendrá implicaciones duraderas para el modelo de desarrollo de la IA.

El debate sobre la apertura de la IA también es crucial. Mientras Musk defiende un desarrollo de código abierto, OpenAI y otros argumentan que modelos extremadamente potentes pueden representar riesgos de seguridad si se abren totalmente sin salvaguardas adecuadas. La inteligencia artificial, en su forma más avanzada, puede tener capacidades impredecibles, y la responsabilidad de gestionar su desarrollo es colosal. La colaboración entre el sector privado, gobiernos y la academia será esencial para establecer directrices y regulaciones que garanticen que la IA se desarrolle de forma segura, transparente y en alineación con los valores humanos.

El episodio reciente con Elon Musk subraya que, más allá de la tecnología en sí, la gobernanza y la filosofía detrás de las organizaciones que la desarrollan son tan importantes como los algoritmos. El público, los reguladores y los propios desarrolladores de IA tienen un papel que desempeñar en la configuración de ese futuro. La transparencia sobre las intenciones, los modelos de negocio y los enfoques de seguridad será cada vez más vital para construir la confianza y asegurar que la IA sirva genuinamente al propósito de mejorar la vida humana.

Conclusión: Una Mirada Integral sobre la IA y sus Dilemas

La historia de OpenAI es un microcosmos de los dilemas enfrentados por toda la industria de inteligencia artificial. Comenzando con una visión noble de desarrollar la AGI para el bien de la humanidad, la organización tuvo que adaptarse a las duras realidades financieras y competitivas del sector. La transición a un modelo de “lucro limitado” y la asociación con Microsoft, aunque controvertidas, fueron pasos pragmáticos que permitieron a OpenAI alcanzar el nivel de innovación que vemos hoy, con productos como ChatGPT transformando el panorama tecnológico global.

La “verdad que Elon omitió” nos recuerda que las narrativas son frecuentemente más complejas de lo que parecen. La evolución de una empresa, especialmente una tan ambiciosa como OpenAI, es un camino sinuoso, repleto de compromisos y decisiones difíciles. La demanda de Elon Musk, independientemente de su resultado, ya sirve como un catalizador para una discusión muy necesaria sobre la ética, la gobernanza y el propósito de la inteligencia artificial. Es un recordatorio de que, mientras construimos el futuro con la IA, debemos estar vigilantes para asegurar que los ideales iniciales de beneficio humano no se pierdan en medio de la búsqueda de innovación y lucro. El debate sobre cómo debe desarrollarse la IA – abierta o cerrada, con fines de lucro o sin fines de lucro – continuará configurando nuestro futuro digital.

Share this content:

Publicar comentário