Mega Acuerdo de US$ 100 Mil Millones entre OpenAI y Nvidia Se Enfría: ¿Qué Significa Esto para el Futuro de la IA?

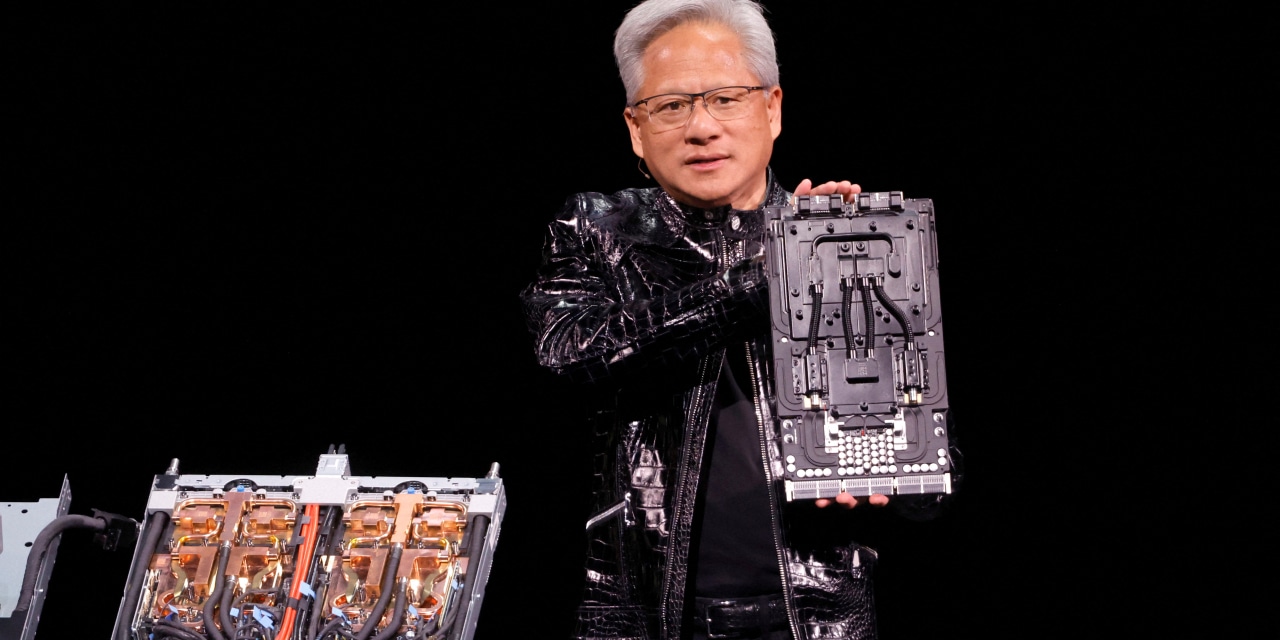

En el universo dinámico y electrizante de la inteligencia artificial, cada movimiento de gigantes como OpenAI y Nvidia resuena en todo el ecosistema tecnológico. Recientemente, una noticia importante agitó el sector: el potencial mega acuerdo de US$ 100 mil millones entre la creadora de ChatGPT y la reina de los chips de IA está, por ahora, ‘en suspenso’. El propio CEO de Nvidia, Jensen Huang, habría minimizado, en privado, la probabilidad de que el acuerdo original se concrete, aunque ha reiterado que ambas empresas seguirán manteniendo una estrecha colaboración.

Pero, ¿qué significa exactamente este “enfriamiento” de un pacto tan ambicioso? ¿Y cuáles son las ramificaciones para el futuro de la IA, un campo que devora poder computacional como ningún otro? Prepárese para adentrarse en los entresijos de la carrera por la supremacía de la inteligencia artificial, donde los chips son el nuevo oro y la estrategia de hardware moldea el mañana.

### La colaboración OpenAI Nvidia y la demanda insaciable de poder computacional

El ascenso meteórico de la Inteligencia Artificial Generativa, impulsado en gran parte por modelos como el GPT de OpenAI, reveló una verdad innegable: la IA es una fuerza que exige una cantidad colosal de poder computacional. Entrenar un modelo de lenguaje grande (LLM) como el GPT-4, por ejemplo, costó decenas de millones de dólares y consumió vastas cantidades de tiempo de procesamiento en algunas de las GPUs más avanzadas del mundo. Y no es solo el entrenamiento; la inferencia —es decir, la ejecución de esos modelos para generar respuestas— también demanda una infraestructura robusta y constantemente escalable. Es aquí donde entra Nvidia, una empresa que se ha convertido, sin exageración, en la columna vertebral de la revolución de la IA.

Con una cuota de mercado superior al 90% en chips para IA —las Unidades de Procesamiento Gráfico (GPUs)—, Nvidia no es solo una proveedora, sino una socia estratégica indispensable para cualquier organización seria en IA. Sus aceleradores, como los renombrados H100 y A100, son la joya de la corona de la computación de IA, ofreciendo una capacidad de procesamiento paralelo inigualable, esencial para las complejas operaciones matriciales que requieren los algoritmos de aprendizaje profundo. Más que el hardware en sí, Nvidia ha construido un ecosistema completo con la plataforma CUDA, un entorno de programación que ha facilitado enormemente el desarrollo y la optimización de aplicaciones de IA, convirtiendo sus chips en la opción preferente y, para muchos, la única viable a corto plazo.

Dado este escenario, no es sorpresa que OpenAI, con su ambición de construir la Inteligencia Artificial General (AGI), estuviera en negociaciones para un acuerdo masivo, valorado en impresionantes US$ 100 mil millones. Dicho monto no se referiría solo a la compra de chips, sino que probablemente abarcaría una asociación a largo plazo para el suministro, desarrollo de infraestructura, optimización de software e incluso colaboración en chips personalizados. Sería una inversión que compraría no solo miles de centros de datos y millones de chips, sino que también garantizaría un flujo constante de innovación y capacidad para las futuras generaciones de modelos de IA de OpenAI. Para Nvidia, sería la máxima validación de su liderazgo y un contrato de ingresos monumental. La potencial colaboración OpenAI Nvidia a este nivel sería un punto de inflexión, estableciendo un nuevo estándar para la industria.

### Por Qué un Acuerdo Multimillonario Podría Haberse Enfriado: Desafíos y Estrategias Detrás de la Megapartenariado

Si la necesidad es tan clara y la alineación estratégica parece tan perfecta, ¿por qué un acuerdo de US$ 100 mil millones entre OpenAI y Nvidia estaría ahora ‘en suspenso’? La respuesta reside en la complejidad del mercado de IA, en las estrategias de negocio de ambas empresas y en las dinámicas de poder que moldean la vanguardia tecnológica. La declaración de Jensen Huang de que el “acuerdo original” no se concretaría es particularmente reveladora. Esto sugiere que, aunque la colaboración continúe, la estructura o la escala previamente imaginada no se materializarán en la forma esperada.

Desde el punto de vista de Nvidia, la demanda de sus chips H100 y A100 es universal y abrumadora. Gigantes como Microsoft, Google, Amazon y Meta, además de innumerables startups, están buscando desesperadamente acceso a su tecnología. En un escenario de escasez global de chips de IA, comprometer una porción tan grande de su producción y recursos con un único cliente, incluso si es OpenAI, podría ser un riesgo estratégico. Nvidia puede preferir mantener su flexibilidad, vendiendo a una gama diversa de clientes y maximizando sus ingresos a corto y medio plazo, en lugar de atarse a un único megacontrato que podría, eventualmente, generar preocupaciones antimonopolio o limitar futuras oportunidades de mercado. La empresa de Huang tiene un historial de habilidad para equilibrar la demanda y optimizar la distribución de sus recursos.

Por su parte, OpenAI podría tener sus propios motivos para reconsiderar la naturaleza del acuerdo. Uno de los desafíos más apremiantes para cualquier empresa de IA es el costo y la dependencia del hardware de terceros. A largo plazo, la soberanía tecnológica sobre la infraestructura de computación es un objetivo codiciado. Rumores sobre el “Proyecto Athena” de OpenAI —una iniciativa para desarrollar sus propios chips de IA— indican un deseo claro de reducir la dependencia de proveedores externos. Aunque construir un chip desde cero es una tarea monumental y extremadamente cara, la capacidad de personalizar el hardware para sus cargas de trabajo específicas puede generar ganancias de eficiencia y reducir los costos operativos a largo plazo.

Además, no podemos ignorar la influencia de Microsoft. Como principal inversora y socia de OpenAI, Microsoft ya está invirtiendo fuertemente en sus propios chips de IA (como Maia para inferencia y Cobalt para cargas de trabajo generales), buscando optimizar los costos y el rendimiento de sus propios servicios en la nube Azure, que alojan la mayor parte de las operaciones de OpenAI. Es posible que Microsoft prefiera que OpenAI no se vincule tan rígidamente a un único proveedor, buscando una estrategia de diversificación de hardware que involucre tanto chips de Nvidia como los propios chips desarrollados internamente, o incluso de otros fabricantes como AMD. La complejidad logística y los enormes compromisos financieros de un acuerdo de US$ 100 mil millones también podrían haber levantado señales de alerta, llevando a una reevaluación de las condiciones y de la estructura original.

### El Futuro de la Infraestructura de IA: Diversificación y la Búsqueda de Soberanía Tecnológica

El “enfriamiento” del mega acuerdo entre OpenAI y Nvidia es un síntoma de una tendencia mayor en la industria de IA: la búsqueda de diversificación y soberanía tecnológica en hardware. Aunque Nvidia continúa siendo el rey indiscutible de los chips de IA, las grandes empresas están invirtiendo cada vez más en el desarrollo de sus propias soluciones personalizadas. Google, con sus Tensor Processing Units (TPUs); Amazon, con los chips Inferentia y Trainium; y ahora Microsoft, con Maia y Cobalt, son ejemplos claros de esta estrategia. El objetivo es doble: optimizar el rendimiento para sus cargas de trabajo específicas y reducir los costos operativos que se vuelven prohibitivos a medida que la demanda de IA explota.

Esta tendencia no significa que Nvidia perderá su relevancia. Lejos de ello. Significa que el mercado está madurando y volviéndose más competitivo. Otros actores, como AMD, están invirtiendo fuertemente en sus propias GPUs de IA, como la serie MI300X, buscando hacerse con una parte de este pastel creciente. La innovación no se detiene; investigadores están explorando nuevas arquitecturas de chips, como la computación óptica y los chips neuromórficos, que prometen revolucionar aún más la eficiencia y la velocidad del procesamiento de IA. La colaboración OpenAI Nvidia puede, por lo tanto, evolucionar hacia un modelo más flexible, donde OpenAI continúa siendo una cliente importante de Nvidia, comprando miles de GPUs para sus necesidades inmediatas, mientras simultáneamente invierte en sus propias capacidades de hardware y explora otras asociaciones.

En el largo plazo, la infraestructura de IA se caracterizará por un mosaico de soluciones: GPUs altamente optimizadas de empresas como Nvidia, chips personalizados desarrollados internamente por gigantes de la tecnología y quizás incluso nuevas arquitecturas emergentes. Esta diversificación es saludable para el ecosistema, ya que fomenta la innovación, reduce la dependencia de un único proveedor y, en última instancia, puede conducir a una IA más accesible y potente. El escenario no es de ruptura total, sino de redefinición de prioridades y estrategias para garantizar la sostenibilidad y la escalabilidad de la IA en un futuro donde las demandas computacionales solo tenderán a crecer.

### Conclusión: Una Colaboración que se Adapta, un Futuro que se Acelera

El anuncio del “enfriamiento” de un posible acuerdo de US$ 100 mil millones entre OpenAI y Nvidia no es el fin de una relación, sino un indicativo de su evolución en un mercado de IA en constante ebullición. La complejidad del desarrollo de la inteligencia artificial general y la voracidad por poder computacional exigen que las empresas líderes reevalúen constantemente sus estrategias de hardware y asociaciones. Mientras Nvidia mantiene su posición de destaque como proveedora esencial, OpenAI y otras gigantes buscan cada vez más un enfoque híbrido, combinando lo mejor del hardware comercial con el desarrollo de soluciones internas personalizadas.

Lo que emerge de esta noticia es un atisbo del futuro de la infraestructura de IA: un ecosistema más diversificado, resiliente y enfocado en la optimización de costos y rendimiento. La colaboración OpenAI Nvidia continuará, sin duda, pero probablemente bajo un nuevo modelo que refleja las crecientes ambiciones y las complejas dinámicas del sector. La carrera por la AGI está lejos de terminar, y la forma en que el hardware se diseña, adquiere e implementa será, más que nunca, el motor de esta incesante búsqueda de inteligencia.

Share this content:

Publicar comentário