Tesla y el Giro Estratégico en la IA: El Enfoque en los Chips de Inferencia

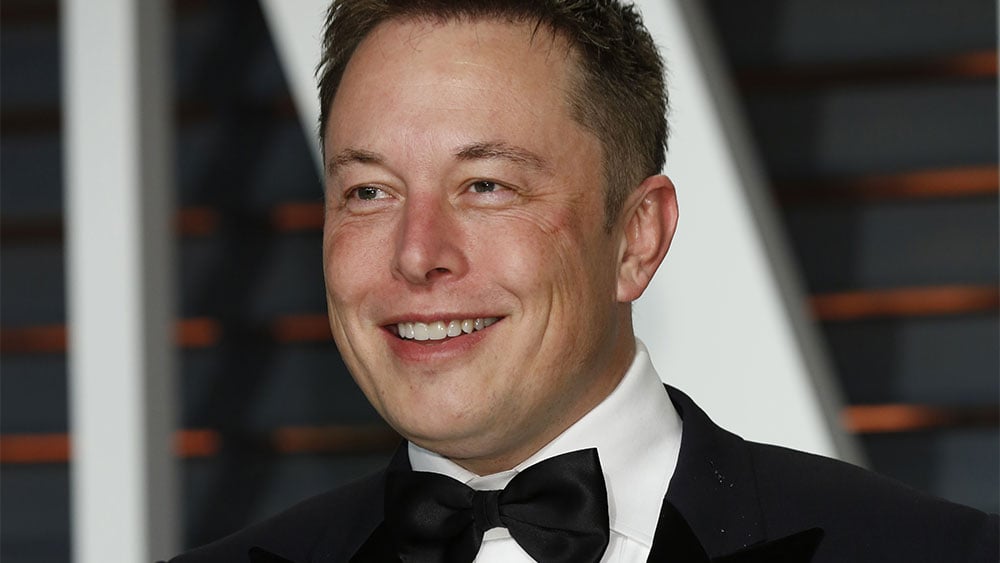

Tesla, empresa que históricamente desafía convenciones y redefine industrias, está nuevamente en el centro de las discusiones tecnológicas, pero esta vez, no por un nuevo vehículo eléctrico o una batería revolucionaria. El foco actual está en la inteligencia artificial y, más específicamente, en los semiconductores que la impulsan. En una revelación que reverberó rápidamente por la comunidad tecnológica global, Elon Musk, figura central y visionaria de la compañía, anunció un cambio estratégico significativo: Tesla está dirigiendo sus esfuerzos al desarrollo e implementación de chips de inferencia, cruciales para la toma de decisiones de IA en tiempo real.

Este giro, expresado en un breve pero impactante mensaje en su plataforma social, señala una reevaluación de las prioridades dentro de la ambiciosa arquitectura de IA de Tesla. Históricamente, gran parte de la atención se centró en el proyecto Dojo, una supercomputadora de IA concebida para revolucionar el entrenamiento de modelos de aprendizaje automático a escala masiva. Sin embargo, el anuncio de Musk sugiere una recalibración, enfocándose en la fase de inferencia – es decir, en la aplicación práctica e instantánea de los modelos de IA ya entrenados. Este artículo profundizará en las implicaciones de este cambio, explorando qué son los chips de inferencia, el papel de Dojo hasta ahora y qué significa esta nueva dirección para el futuro de Tesla como potencia de IA.

### La Revolución de los **Chips de Inferencia** y la Estrategia de Tesla

Para comprender la magnitud de la decisión de Tesla, es fundamental diferenciar dos pilares de la inteligencia artificial: entrenamiento e inferencia. El entrenamiento de un modelo de IA es el proceso intensivo y prolongado en el cual los algoritmos son expuestos a vastos volúmenes de datos para aprender patrones, tomar decisiones y mejorar sus capacidades. Es la fase donde un modelo, como una red neuronal para visión por computadora, aprende a identificar objetos, personas y escenarios en millones de videos de cámaras de vehículos. Esta etapa exige una capacidad computacional bruta y masiva, típicamente proporcionada por GPUs de alto rendimiento o supercomputadoras especializadas, como el prometido Dojo.

Por otro lado, la inferencia es la fase de aplicación. Una vez que el modelo es entrenado, es entonces implementado para usar el conocimiento adquirido y hacer predicciones o tomar decisiones en tiempo real con nuevos datos. Piense en un vehículo autónomo que, al encontrarse con una encrucijada, necesita identificar peatones, otros autos, semáforos y señales de tráfico instantáneamente para decidir acelerar, frenar o girar. Esta capacidad de procesar información y actuar en milisegundos es donde los `chips de inferencia` se vuelven absolutamente indispensables.

Los `chips de inferencia` están diseñados para una eficiencia máxima en la ejecución de modelos de IA, no para su entrenamiento. Esto significa que están optimizados para bajo consumo de energía, latencia mínima y alta tasa de transferencia para operaciones específicas de redes neuronales. Mientras que un chip de entrenamiento puede tener miles de núcleos de procesamiento genéricos y un alto ancho de banda de memoria para manipular enormes datasets, un chip de inferencia es más especializado, a menudo con arquitecturas personalizadas (como unidades de procesamiento tensorial – TPUs) que ejecutan operaciones matriciales de forma extremadamente rápida y eficiente. Son el cerebro que opera *dentro* del auto, del robot o de cualquier dispositivo de borde que necesita inteligencia artificial instantánea.

Para Tesla, cuyo objetivo primordial es alcanzar la autonomía plena de sus vehículos (Full Self-Driving – FSD), el foco en los `chips de inferencia` es un movimiento lógico y vital. Cada auto Tesla en la carretera es, esencialmente, un robot sobre ruedas que necesita capacidades de inferencia de vanguardia para navegar en el mundo real. La capacidad de procesar información visual y sensorial en fracciones de segundo y tomar decisiones de conducción seguras y precisas es la esencia del FSD. Al priorizar el desarrollo y la implementación de estos chips, Tesla está garantizando que la tecnología de IA que entrena en sus centros de datos pueda ser efectivamente ejecutada y escalada a millones de vehículos en todo el mundo. Esta estrategia no solo mejora el rendimiento de los vehículos existentes, sino que también abre el camino para la expansión de su flota de robotaxis y el avance de proyectos como el robot humanoide Optimus, ambos dependientes de una inferencia de IA robusta y en tiempo real.

### El Legado del Proyecto Dojo: Ambición y Realidad

El Proyecto Dojo, cuya concepción fue revelada en 2019 y detallada más profundamente en el Tesla AI Day en 2021, representó la audaz visión de Tesla de construir una supercomputadora de IA desde cero, optimizada específicamente para el entrenamiento de su vasta y creciente colección de datos de video. La idea era crear una “fábrica de IA” capaz de procesar petabytes de datos brutos de sus vehículos, transformándolos en modelos de conducción autónoma cada vez más capaces. Dojo fue diseñado para ser fundamental para la ambición de Tesla de resolver la autonomía a gran escala, ofreciendo una alternativa interna y potencialmente más eficiente a las GPUs de propósito general de empresas como NVIDIA, que dominan el mercado de hardware para entrenamiento de IA.

Los arquitectos de Dojo concibieron un sistema con el chip D1 en el corazón, una pieza de silicio altamente especializada diseñada para computación de IA de alto rendimiento. Múltiples chips D1 serían conectados para formar “bloques de entrenamiento Dojo”, que, a su vez, serían combinados en nodos mayores para crear la supercomputadora masiva. El objetivo era alcanzar velocidades de procesamiento que permitieran iteraciones de entrenamiento de modelos de IA a una escala y velocidad sin precedentes, acelerando significativamente el desarrollo del FSD. Su promesa era de exaFLOPS de rendimiento, colocándolo entre las supercomputadoras más potentes del mundo.

Sin embargo, como ocurre con muchos proyectos de ingeniería ambiciosos, la realidad puede presentar desafíos complejos. Aunque Dojo sigue siendo una pieza crucial en la infraestructura de IA de Tesla, el cambio de enfoque anunciado por Musk sugiere una reevaluación de dónde la mayor parte de la inversión y el esfuerzo de ingeniería deben asignarse en este momento. Esto no significa que Dojo haya sido “descartado” o que haya fallado en su propósito. Por el contrario, la supercomputadora sigue siendo vital para el entrenamiento continuo y la mejora de los modelos de IA de Tesla. El cambio de prioridad hacia los `chips de inferencia` indica, más bien, una comprensión de que, aunque entrenar los modelos es esencial, la capacidad de implementarlos y ejecutarlos de forma eficiente en millones de unidades es el cuello de botella más inmediato para la expansión y monetización de sus tecnologías de IA.

Es posible que Tesla haya evaluado que la dependencia de GPUs externas para algunas tareas de entrenamiento, combinada con la necesidad apremiante de dominar la inferencia en el vehículo, llevó a esta reasignación de recursos. La inversión en `chips de inferencia` puede ofrecer un retorno más rápido en términos de funcionalidad y seguridad para el FSD, además de ser un componente directo para la expansión a otros mercados de IA. La decisión refleja una pragmática adaptación estratégica en el camino hacia la inteligencia artificial generalizada, reconociendo que la cadena de valor de la IA es compleja y exige optimización en todas sus etapas, desde el dato bruto hasta la decisión final en el punto de uso.

### Tesla como Empresa de IA: El Futuro de la Autonomía y Robótica

A pesar de ser ampliamente conocida por sus vehículos eléctricos, Tesla se ha posicionado, de forma cada vez más explícita, como una empresa de inteligencia artificial. Elon Musk reitera frecuentemente que el valor a largo plazo de Tesla reside en su liderazgo en IA y robótica. La flota masiva de vehículos de Tesla no es solo una línea de productos, sino una vasta red de recopilación de datos y, más importante aún, una plataforma para el desarrollo y la implementación de IA a escala. Cada auto es un sensor en movimiento, un laboratorio ambulante y, crucialmente, una terminal de inferencia para la IA.

Esta visión se extiende mucho más allá de los automóviles. El proyecto Optimus, el robot humanoide de Tesla, es una clara demostración de la ambición de la empresa en aplicar su experiencia en IA y hardware a la robótica de propósito general. Así como los autos, Optimus dependerá masivamente de `chips de inferencia` para procesar información del entorno, entender comandos y ejecutar tareas complejas en tiempo real. La capacidad de fabricar, optimizar e implementar estos chips en masa será un diferencial competitivo no solo para el FSD, sino para cualquier aplicación de IA que exija inteligencia en el “borde” – es decir, directamente en el dispositivo, sin depender de una conexión constante con la nube.

El ecosistema de hardware y software de IA de Tesla se está volviendo cada vez más verticalizado. Desde la recopilación de datos brutos con sus cámaras de vehículos hasta el entrenamiento en sistemas como Dojo (o con GPUs de terceros, dependiendo de la tarea), y finalmente la inferencia en sus vehículos y robots, la empresa busca controlar cada etapa para optimizar el rendimiento y el costo. Este control vertical permite a Tesla iterar más rápidamente, ajustar la arquitectura de sus chips para las necesidades específicas de sus algoritmos y garantizar una integración perfecta entre hardware y software – algo que pocos competidores pueden replicar con la misma profundidad.

En el escenario competitivo global de la IA, donde gigantes como NVIDIA, Google y Amazon están invirtiendo fuertemente en chips e infraestructura, el enfoque de Tesla es notable. Mientras que NVIDIA domina con sus GPUs versátiles para entrenamiento, y Google ofrece sus TPUs para inferencia y entrenamiento en la nube, Tesla opta por desarrollar su propio silicio, adaptado a sus necesidades únicas. El giro estratégico hacia los `chips de inferencia` solidifica este enfoque, indicando que la empresa se está concentrando donde la teoría se vuelve práctica – literalmente – en la ejecución práctica de su IA. Esto no es solo una decisión técnica, sino un movimiento estratégico de negocios que busca acelerar el camino hacia los ingresos a través de la entrega de capacidades de IA funcionales y escalables al consumidor.

### Conclusión

El cambio de énfasis de Tesla en su estrategia de IA, priorizando los chips de inferencia para la toma de decisiones en tiempo real, es una señal clara de la madurez y la dirección pragmática que la empresa está tomando en su viaje de inteligencia artificial. Lejos de ser un retroceso en el desarrollo de Dojo, esta decisión representa una reasignación estratégica de recursos al punto más crítico de la implementación de la IA: la capacidad de ejecutar modelos complejos de forma eficiente e instantánea en los millones de vehículos y, futuramente, robots que Tesla pretende poner en el mundo. Es un reconocimiento de que, para que la visión de la autonomía plena y de la robótica de uso general se haga realidad, la inferencia debe ser tan robusta y accesible como el entrenamiento.

Este giro no solo refuerza la posición de Tesla como una empresa de tecnología de vanguardia, sino que también ilumina el futuro de la IA en dispositivos de borde. A medida que la inteligencia artificial se integra cada vez más a nuestro día a día – en autos, hogares e incluso en robots personales – la demanda de chips de inferencia eficientes y potentes solo aumentará. La decisión de Tesla de concentrarse en esta área es un testimonio de su visión a largo plazo y de su compromiso de ser una fuerza transformadora no solo en la industria automotriz, sino en el panorama más amplio de la inteligencia artificial. Seguiremos de cerca los próximos capítulos de esta fascinante evolución, que promete moldear el futuro de la interacción humana con la tecnología.

Share this content:

Publicar comentário